Come NVIDIA affronta il problema del Deep Learning: Digits Devbox

Al GPU Techonology Conference, il CEO di NVIDIA ha parlato di Digits Devbox, un sistema di training gestito tramite GPU e rivolto all'elaborazione di dati scientifici.

di Rosario Grasso pubblicata il 17 Marzo 2015, alle 18:49 nel canale Schede VideoNVIDIA

Il keynote di Jen-Hsun Huang al GTC è stato quasi completamente incentrato sul Deep Learning. Il CEO di NVIDIA vuole far capire che l'hardware NVIDIA può adesso essere alla base di un altro passo in avanti di enorme importanza, contribuendo a migliorare i sistemi di Deep Learning. Nel corso degli anni i ricercatori e gli scienziati di intelligenza artificiale hanno fatto continui tentativi per fare in modo che i sistemi informatici apprendano come l'essere umano e gestiscano la loro acquisizione di informazioni come fa il cervello umano. Ma c'è sempre stato un limite legato alla capacità di elaborazione dell'hardware.

Ci sono varie sottoaree nell'apprendimento automatico e una di queste è il riconoscimento di pattern, che può portare la macchina a riconoscere l'uomo solamente inquadrando il suo volto. Viviamo oggi in una realtà fatta di dati e di immagini provenienti dai dispositivi di cui siamo dotati: ed è per questo che tecnologie come il GPGPU computing e Cuda possono venire in soccorso per processare questa enorme mole di dati.

Il punto è gestire grossi volumi di dati e prevedere il futuro sulla base di queste informazioni. Il Deep Learning può essere utilizzato anche nel settore della ricerca medica, ad esempio per prevedere gli sviluppi di certe ricerche.

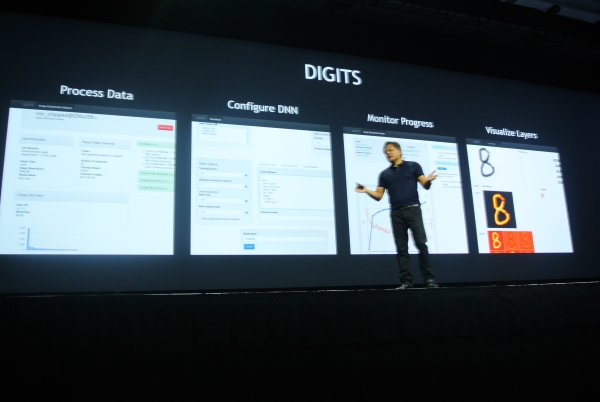

Il middleware di Deep Learning su cui NVIDIA sta lavorando si chiama Digits, e si tratta di un training system accelerato tramite GPU ottimizzato per l'elaborazione di dati scientifici. Utilizza le reti neurali per addestrare il sistema informatico a riconoscere il contenuto delle immagini che gli vengono sottoposte.

Sul palco del Convention Center Jensen e i tecnici NVIDIA hanno mostrato delle immagini e lasciato che il network di Deep Learning che stanno sviluppando riuscisse a descriverle. Il sistema suddivide le immagini che gli vengono date in pasto in strati e analizza ciascuno strato.

Digist inoltre è basato su AlexNet, un software per reti neurali accelerato dalla GPU. È uno dei primi in grado di sfruttare la GPU, mentre altre soluzioni di questo tipo sono basate sulla CPU. Questi nuovi strumenti per la ricerca scientifica saranno accompagnati da un ambiente di facile utilizzo con un'interfaccia utente web-based.

E ci sarà un nuovo hardware pensato appositamente per i nuovi software, che Jensen definisce Digits Devbox. Dentro questo sistema, ottimizzato per il middlware Digits, abbiamo quattro GPU. Costa 15 mila dollari e sarà disponibile da maggio. Ovviamente indirizzato agli sviluppatori delle nuove tecnologie di Deep Learning e non all'utente finale.

Recensione Vivo X300 Ultra: fotocamera eccezionale, ma prezzo proibitivo

Recensione Vivo X300 Ultra: fotocamera eccezionale, ma prezzo proibitivo Xiaomi 17T Pro recensione: zoom Leica 5x e batteria silicio-carbonio per l'alternativa ai top

Xiaomi 17T Pro recensione: zoom Leica 5x e batteria silicio-carbonio per l'alternativa ai top Il sistema nervoso centrale delle aziende: Confluent all'incrocio tra IA e dati in tempo reale

Il sistema nervoso centrale delle aziende: Confluent all'incrocio tra IA e dati in tempo reale_160.jpg) I nuovi iPhone 18 Pro potrebbero essere più costosi, anche per colpa della fotocamera

I nuovi iPhone 18 Pro potrebbero essere più costosi, anche per colpa della fotocamera_160.jpg) Il taglio di prezzo del Game Pass inizia a dare i primi frutti: il rilancio di Xbox è iniziato?

Il taglio di prezzo del Game Pass inizia a dare i primi frutti: il rilancio di Xbox è iniziato? LG non venderà la sua divisione TV: rumor smentiti con una dichiarazione ufficiale

LG non venderà la sua divisione TV: rumor smentiti con una dichiarazione ufficiale Top 12 del weekend, i nuovi sconti infiammano Amazon: lavatrice Candy 1600 giri, Apple Watch, Amazfit, Smart TV e altre super promo

Top 12 del weekend, i nuovi sconti infiammano Amazon: lavatrice Candy 1600 giri, Apple Watch, Amazfit, Smart TV e altre super promo La Commissione Ue blocca la cessione di MediaWorld ai cinesi di JD.com: l'operazione è stata finanziata dalla Cina?

La Commissione Ue blocca la cessione di MediaWorld ai cinesi di JD.com: l'operazione è stata finanziata dalla Cina? Samsung Galaxy S26 Ultra a 999 su Amazon con tablet da 750 in omaggio: sconto di 219 sul top di gamma

Samsung Galaxy S26 Ultra a 999 su Amazon con tablet da 750 in omaggio: sconto di 219 sul top di gamma Amazfit Active 2 a 81, Bip 6 a 57, T-Rex 3 a 179 e Cheetah 2 Pro a 368 su Amazon: 4 smartwatch per usi diversi, a ottimi prezzi

Amazfit Active 2 a 81, Bip 6 a 57, T-Rex 3 a 179 e Cheetah 2 Pro a 368 su Amazon: 4 smartwatch per usi diversi, a ottimi prezzi Un ottimo pulitore per tappeti e divani a 85,49 su Amazon: vapore a 100°C, 1650W e 13.000 Pa di aspirazione per imbottiti impeccabili

Un ottimo pulitore per tappeti e divani a 85,49 su Amazon: vapore a 100°C, 1650W e 13.000 Pa di aspirazione per imbottiti impeccabili Apple Watch Series 11 GPS + Cellular a 539 e Watch SE 3 da 219 su Amazon: due smartwatch Apple con sconti fino al 22%

Apple Watch Series 11 GPS + Cellular a 539 e Watch SE 3 da 219 su Amazon: due smartwatch Apple con sconti fino al 22% Super lavatrice in offerta Amazon: Candy Smart Pro Inverter è classe A, 10Kg e ha persino i 1600 giri di centrifuga solo 379

Super lavatrice in offerta Amazon: Candy Smart Pro Inverter è classe A, 10Kg e ha persino i 1600 giri di centrifuga solo 379 Schede video GeForce RTX 50, Ryzen 9000, RAM DDR5 e monitor gaming fino a 360Hz: le migliori offerte hardware PC su Amazon

Schede video GeForce RTX 50, Ryzen 9000, RAM DDR5 e monitor gaming fino a 360Hz: le migliori offerte hardware PC su Amazon La GeForce RTX 5060 oggi costa poco più di 300: la scheda grafica compatta con GDDR7 e DLSS 4 per il gaming 1080p e 1440p

La GeForce RTX 5060 oggi costa poco più di 300: la scheda grafica compatta con GDDR7 e DLSS 4 per il gaming 1080p e 1440p Acer espande la gamma QD-OLED: debuttano i monitor professionali ProDesigner PE320QK G0 e CE320QK G

Acer espande la gamma QD-OLED: debuttano i monitor professionali ProDesigner PE320QK G0 e CE320QK G Acer TravelMate P6 14 AI: meno di un chilogrammo, processore Intel Core Ultra Series 3 con vPro e fino a 30 ore di autonomia

Acer TravelMate P6 14 AI: meno di un chilogrammo, processore Intel Core Ultra Series 3 con vPro e fino a 30 ore di autonomia

0 Commenti

Gli autori dei commenti, e non la redazione, sono responsabili dei contenuti da loro inseriti - infoDevi effettuare il login per poter commentare

Se non sei ancora registrato, puoi farlo attraverso questo form.

Se sei già registrato e loggato nel sito, puoi inserire il tuo commento.

Si tenga presente quanto letto nel regolamento, nel rispetto del "quieto vivere".