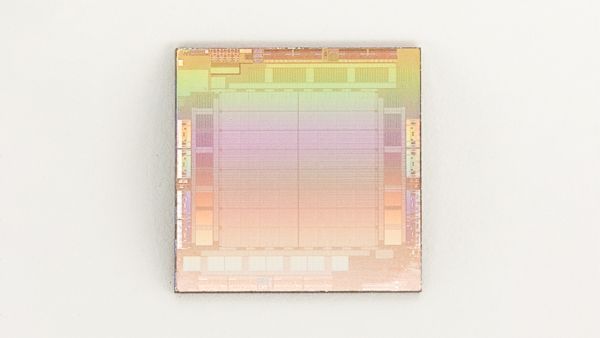

Meta anticipa 'Artemis', un nuovo chip custom per l'IA in arrivo quest'anno

Meta e Reuters confermano l'arrivo di una seconda generazione di MTIA (Meta Training and Inference Accelerator), nome in codice Artemis. La soluzione custom, pensata per i carichi di inferenza, lavorerà di concerto con le GPU di NVIDIA e non solo nei datacenter della società.

di Manolo De Agostini pubblicata il 02 Febbraio 2024, alle 08:01 nel canale Schede VideoMeta

Nel corso dell'anno Meta ha intenzione di installare nei propri datacenter un nuovo acceleratore custom per l'intelligenza artificiale chiamato "Artemis", probabilmente un'evoluzione dell'attuale MTIA (Meta Training and Inference Accelerator) annunciato lo scorso anno.

La notizia è stata rilanciata da Reuters, entrata in possesso di alcuni documenti interni, e confermata da un portavoce della società. Ridurre la propria dipendenza da NVIDIA e controllare meglio i costi sono certamente tra gli obiettivi a lungo termine di questo impegno, ma allo stato attuale Meta e NVIDIA hanno un rapporto di ferro.

Circa due settimane fa, infatti, Mark Zuckerberg annunciava l'intenzione di comprare centinaia di migliaia di acceleratori basati su GPU. In ogni caso, data la scala delle operazioni di operazioni di Meta, iniziare a installare hardware proprietario potrebbe consentirle di risparmiare centinaia di milioni di dollari nell'acquisto di chip e nei costi energetici associati.

Interrogato in merito, un portavoce di Meta ha confermato l'intenzione di adottare un chip aggiornato quest'anno, spiegando che funzionerà di concerto alle centinaia di migliaia di GPU acquistate. Meta conta di avere entro l'anno qualcosa come 350.000 acceleratori NVIDIA H100 e, aggiungendo forniture di altre realtà (come AMD), punta ad avere una capacità di calcolo equivalente a 600.000 NVIDIA H100.

"Riteniamo che i nostri acceleratori sviluppati internamente siano altamente complementari alle GPU disponibili in commercio nel fornire il mix ottimale di prestazioni ed efficienza su carichi di lavoro specifici di Meta", ha affermato il portavoce.

La soluzione di Meta si occupa solo di carichi di inferenza, ma il piano a lungo termine è realizzare soluzioni che, al pari delle GPU, possano farsi carico tanto dell'inferenza quanto dell'addestramento dei modelli di IA.

La rivoluzione dei dati in tempo reale è in arrivo. Un assaggio a Confluent Current 2025

La rivoluzione dei dati in tempo reale è in arrivo. Un assaggio a Confluent Current 2025 SAP Sapphire 2025: con Joule l'intelligenza artificiale guida app, dati e decisioni

SAP Sapphire 2025: con Joule l'intelligenza artificiale guida app, dati e decisioni Dalle radio a transistor ai Micro LED: il viaggio di Hisense da Qingdao al mondo intero

Dalle radio a transistor ai Micro LED: il viaggio di Hisense da Qingdao al mondo intero Una domenica bestiale Amazon: LG OLED, super portatile Lenovo, iPhone 16 Pro e Pro Max, robot e altri super sconti

Una domenica bestiale Amazon: LG OLED, super portatile Lenovo, iPhone 16 Pro e Pro Max, robot e altri super sconti DJI Mini 4 Pro Fly More Combo: drone leggero che non richiede il patentino oggi in offerta super su Amazon

DJI Mini 4 Pro Fly More Combo: drone leggero che non richiede il patentino oggi in offerta super su Amazon realme GT 7T: display da 6000 nit, potentissimo, 7000 mAh, quasi un top di gamma a metà del prezzo che ti aspetti

realme GT 7T: display da 6000 nit, potentissimo, 7000 mAh, quasi un top di gamma a metà del prezzo che ti aspetti Ancora qualche pezzo per il portatile Lenovo con Core i7, 40GB RAM e 1TB SSD: va sempre a ruba

Ancora qualche pezzo per il portatile Lenovo con Core i7, 40GB RAM e 1TB SSD: va sempre a ruba TV OLED LG Serie C4 2024: immagini da cinema e 4K a 144Hz in sconto su Amazon

TV OLED LG Serie C4 2024: immagini da cinema e 4K a 144Hz in sconto su Amazon Smartwatch Amazfit in sconto: Active 2 a 97, ma ci sono offerte su tutta la gamma

Smartwatch Amazfit in sconto: Active 2 a 97, ma ci sono offerte su tutta la gamma Router e ripetitori AVM FRITZ! da 30 su Amazon: ecco tutte le offerte da non perdere

Router e ripetitori AVM FRITZ! da 30 su Amazon: ecco tutte le offerte da non perdere Adulting 101: i corsi per imparare come era la vita fino a qualche anno fa

Adulting 101: i corsi per imparare come era la vita fino a qualche anno fa Blue Origin ha lanciato con successo la missione suborbitale NS-32 con New Shepard

Blue Origin ha lanciato con successo la missione suborbitale NS-32 con New Shepard L'amministrazione Trump ha ritirato la candidatura di Jared Isaacman come amministratore della NASA

L'amministrazione Trump ha ritirato la candidatura di Jared Isaacman come amministratore della NASA La NASA potrebbe chiudere le missioni OSIRIS-APEX, New Horizons e Juno cancellandone altre per risparmiare soldi

La NASA potrebbe chiudere le missioni OSIRIS-APEX, New Horizons e Juno cancellandone altre per risparmiare soldi Trump vieta anche la vendita di software per la progettazione di chip alle società cinesi

Trump vieta anche la vendita di software per la progettazione di chip alle società cinesi Le migliori offerte del weekend Amazon: portatili, robot, iPhone, Kindle ai prezzi più bassi di sempre

Le migliori offerte del weekend Amazon: portatili, robot, iPhone, Kindle ai prezzi più bassi di sempre Dreame L40 Ultra a 699, prezzo shock: vale quasi quanto lX40 Ultra da 999 (ma costa 300 in meno!)

Dreame L40 Ultra a 699, prezzo shock: vale quasi quanto lX40 Ultra da 999 (ma costa 300 in meno!)

3 Commenti

Gli autori dei commenti, e non la redazione, sono responsabili dei contenuti da loro inseriti - infoPiù che tanti e agguerriti il problema è che i grossi clienti cercheranno di sviluppare le soluzioni in casa ottimizzandoli per i propri scenari

Con la possibilità dei clienti medio piccoli di rivolgersi a soluzioni custum ( come gia offre AMD in altri settori)

Devi effettuare il login per poter commentare

Se non sei ancora registrato, puoi farlo attraverso questo form.

Se sei già registrato e loggato nel sito, puoi inserire il tuo commento.

Si tenga presente quanto letto nel regolamento, nel rispetto del "quieto vivere".