Intel Xeon Scalable di 5a generazione: Emerald Rapids tra HPC e IA

Con la quinta generazione di processori della famiglia Xeon Scalable, nome in codice Emeral Rapids, Intel non cambia piattaforma e punta a offrire maggiore capacità di calcolo tanto in ambito HPC come con le sempre più diffuse elaborazioni di intelligenza artificiale. La risultante è una famiglia di CPU molto articolata, con versioni sino a 64 core e un abbinamento ideale con gli acceleratori Gaudi 2.

di Paolo Corsini pubblicato il 14 Dicembre 2023 nel canale ProcessoriAIGaudiXeonIntelIntelligenza Artificiale

Se c'è un tema che ha messo d'accordo tutti gli operatori nel settore dell'IT nel corso del 2023 è quello legato all'intelligenza artificiale. Nel corso di tutto l'anno, infatti, i produttori di hardware hanno puntato alle proprie soluzioni, nella forma di CPU, GPU e acceleratori vari, per velocizzare le numerose elaborazioni di intelligenza artificiale.

Del resto l'intelligenza artificiale sta interessando un po' tutti gli ambiti nei quali ci troviamo immersi: dalla necessità di rispondere a domande sempre più complesse servendosi di modelli di dimensione sempre più elevata, passando all'utilizzo pratico di modelli di più ridotte dimensioni che sono utilizzati per ambiti specifici e molto spesso legati ad una elaborazione in locale. L'approccio si è venuto a modificare radicalmente nel corso degli ultimi 12 mesi, spostando molte delle elaborazioni dal tradizionale ambiente d'uso del datacenter e del cloud trasformando l'elaborazione dell'intelligenza artificiale con un approccio ibrido.

Da un approccio che ha visto le elaborazioni dell'IA legate al calcolo via CPU si sta passando a una modalità di elaborazione bilanciata, nella quale CPU, GPU e acceleratori dedicati vengono utilizzati alternativamente tra di loro a seconda del tipo di elaborazione che si vuole ottenere.

È a questi scenari di utilizzo, sempre più diffusi non solo in datacenter ma anche nell'edge e nei client più potenti, che Intel guarda con il debutto della quinta generazione di processori Xeon Scalable appartenenti alla famiglia Emerald Rapids. Si tratta di proposte che mantengono la compatibilità a livello di socket con le CPU Sapphire Rapids già in commercio, facilitando l'aggiornamento dei sistemi e la loro disponibilità sul mercato, portando in dote prestazioni incrementate tanto nei tradizionali ambiti di utilizzo quanto nelle elaborazioni di intelligenza artificiale.

Intel Gaudi 2

Quello a cui stiamo assistendo in questi mesi è una diffusione delle elaborazioni AI che non solo sta diventando prioritaria, quanto a risorse di calcolo richieste, rispetto a qualsiasi altra, ma che sta anche replicando nella diffusione quanto avvenuto negli scorsi anni con la diffusione del cloud. Se inizialmente tutto è stato veicolato nei datacenter siamo ora in una fase per la quale le necessità di calcolo sono diventate di fatto ibride, e richiedono di essere gestite anche su modelli di dimensioni più ridotte e che quindi possano essere elaborati in locale o nell'edge.

A chiamare verso elaborazioni dell'IA in locale varie considerazioni legate all'efficienza ma più di tutto c'è la volontà di mantenere lontano dal cloud, e quindi da potenziali occhi indiscreti, i propri dati: il tema della sicurezza è sempre più al centro anche dei calcoli della IA.

L'elaborazione è quindi sempre più bilanciata su diverse risorse, che nel caso specifico si concretizzano in processori, GPU e acceleratori. Il loro numero complessivo e la loro combinazione definisce nello specifico quale sia la tipologia di sistema richiesto: per Intel sono le differenti versioni di processori Xeon Scalable di quinta generazione al debutto che si adattano al meglio a questi nuovi scenari, in abbinamento alle GPU e agli acceleratori della famiglia Gaudi 2.

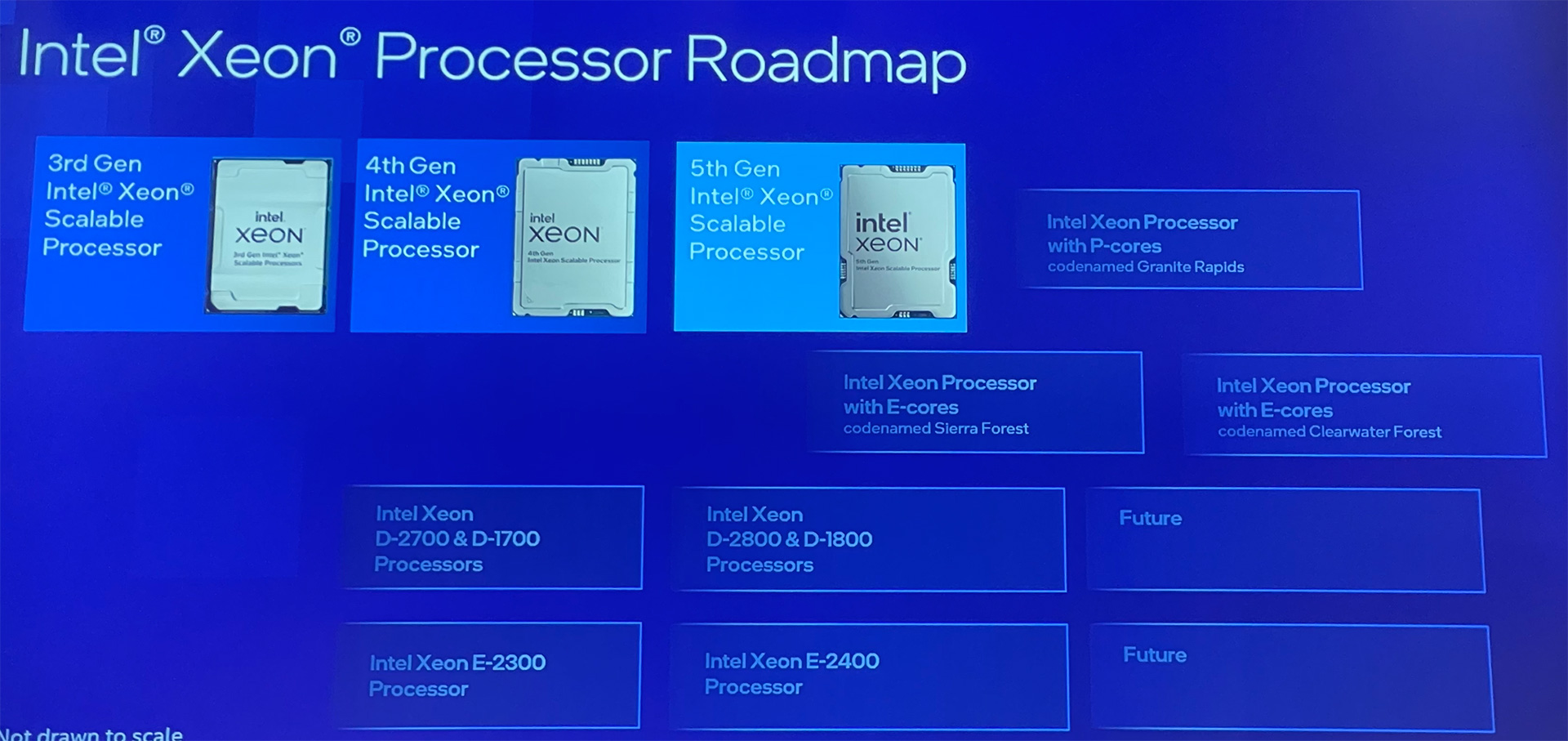

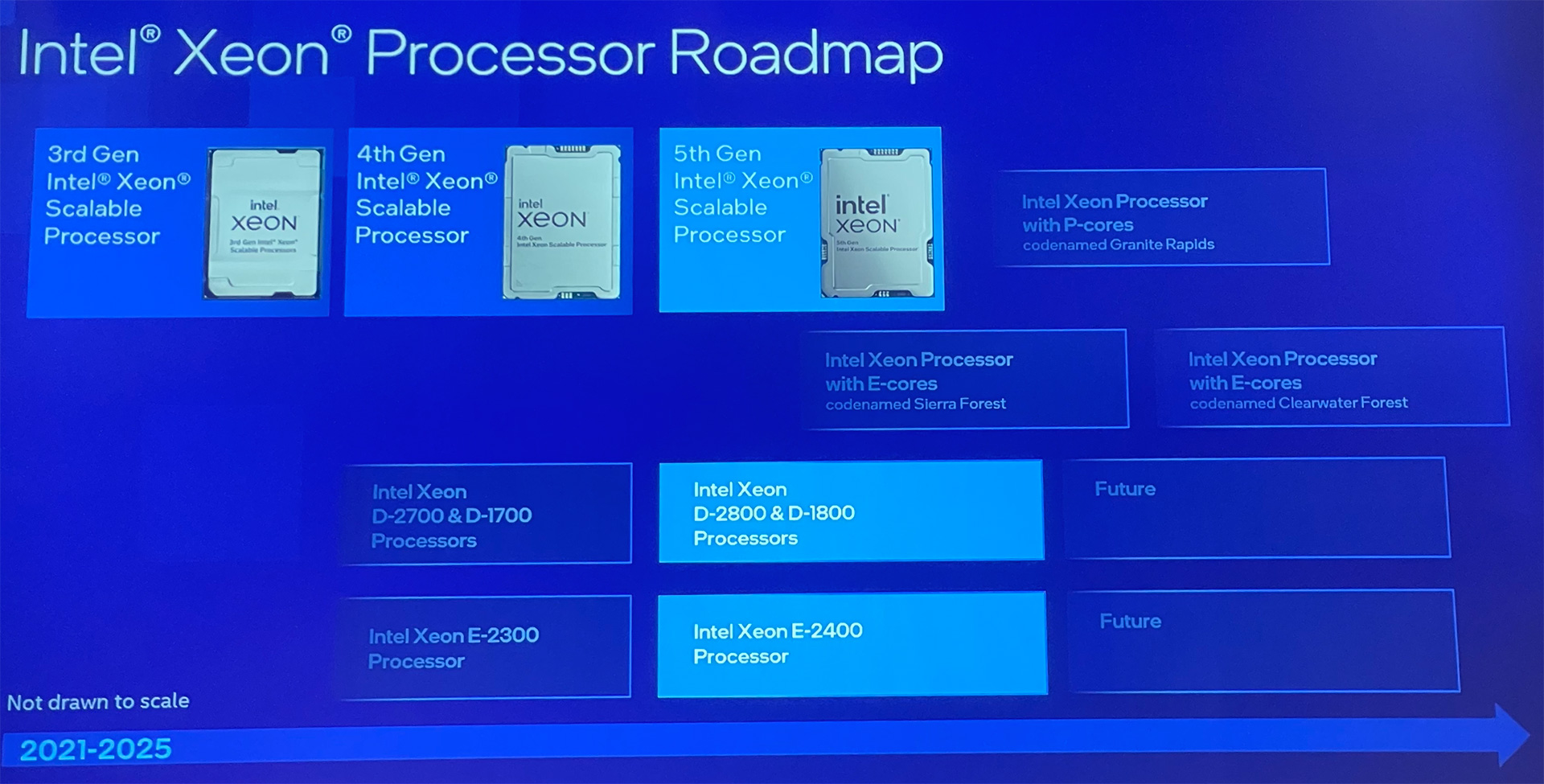

La roadmap dei processori Intel Xeon Scalable vede le soluzioni di quinta generazione, note con il nome in codice di Emeral Rapids, arrivare a circa 1 anno dal debutto delle proposte di quarta generazione Sapphire Rapids. Le due proposte condividono la stessa piattaforma hardware pertanto è possibile per i partner, previo aggiornamento del BIOS, sostituire nei propri sistemi le CPU Xeon di quarta generazione con le nuove arrivate.

La prossima evoluzione vedrà al debutto i processori Xeon della famiglia Granite Rapids con P-Core quale proposte top di gamma dal punto di vista delle pure prestazioni velocistiche, affiancati da quelli Xeon della famiglia Sierra Forest basati su E-Core che puntano a offrire un'elevata densità di elaborazione con consumi contenuti grazie all'utilizzo degli E-Core basati su architettura Crestmont. Di questi processori sentiremo parlare dalla metà del 2024 in avanti.

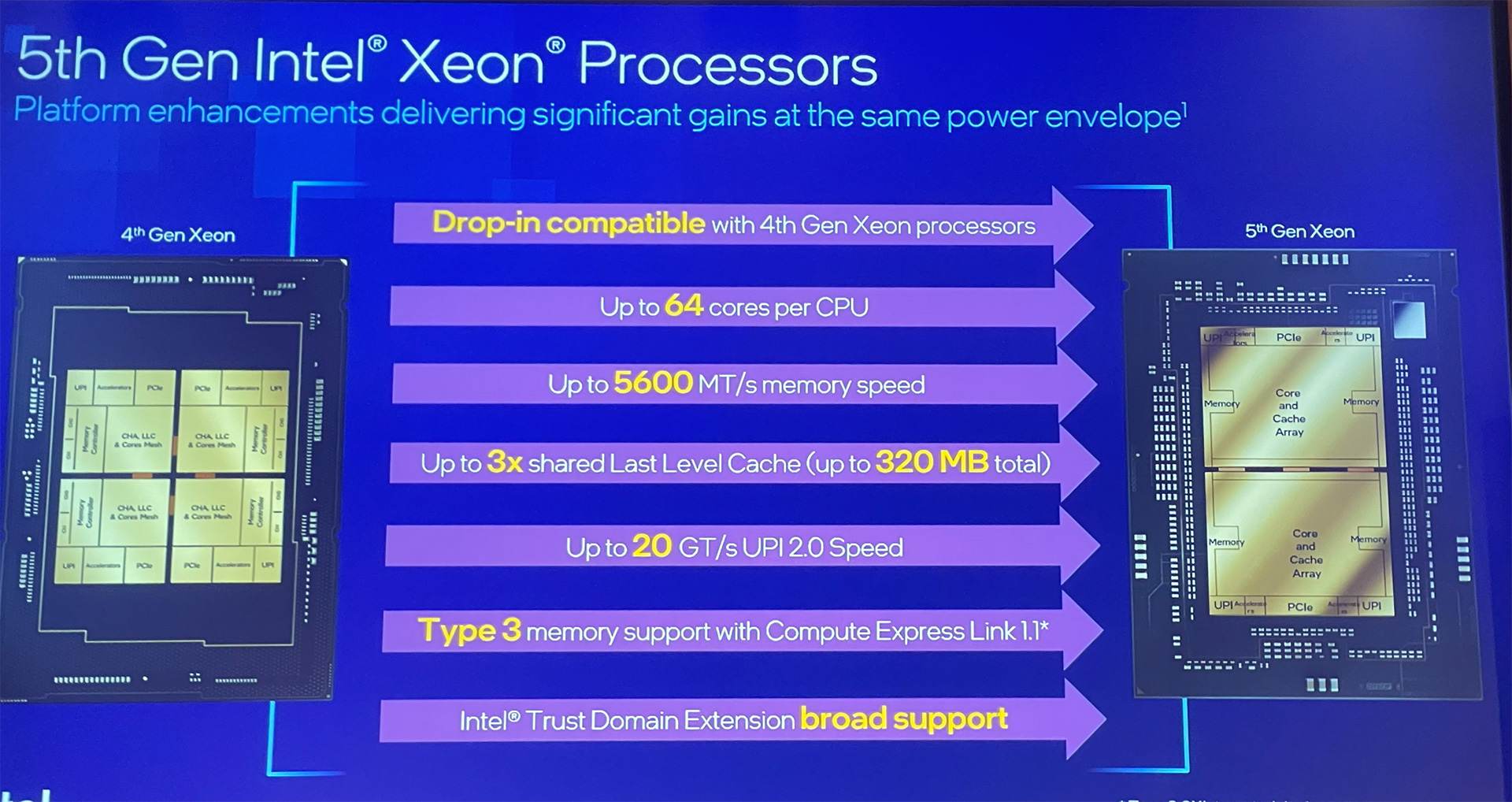

Con la quinta generazione di processori Xeon della famiglia Emerald Rapids Intel ha introdotto alcune importanti novità, mantenendo però piena compatibilità con le piattaforme pensate per i processori Xeon di precedente generazione. È necessario solo un aggiornamento dei BIOS delle schede madri per assicurare la piena compatibilità con le nuove soluzioni, senza altri accorgimenti anche legati al sistema di raffreddamento.

Aumenta il numero massimo di core, che passa dai precedenti 60 agli attuali 64, mentre la memoria DDR5 è ora in grado di operare sino a una frequenza massima di 5600 MT/s. La cache di tipo LLC (Last Level Cache) è stata incrementata, raggiungendo un quantitativo massimo di 320 MB, mentre la velocità della connessione UPI 2.0 per il collegamento tra socket sulla scheda madre è sempre a 20 GT/s. La tecnologia Compute eXpress Link 1.1 è ora compatibile anche nella modalità Type 3: viene utilizzata per mantenere coerenza di accesso alla memoria da parte di differenti dispositivi come CPU, GPU e acceleratori. A completare le novità implementate segnaliamo anche il supporto alla tecnologia Intel Trust Domain Extension.

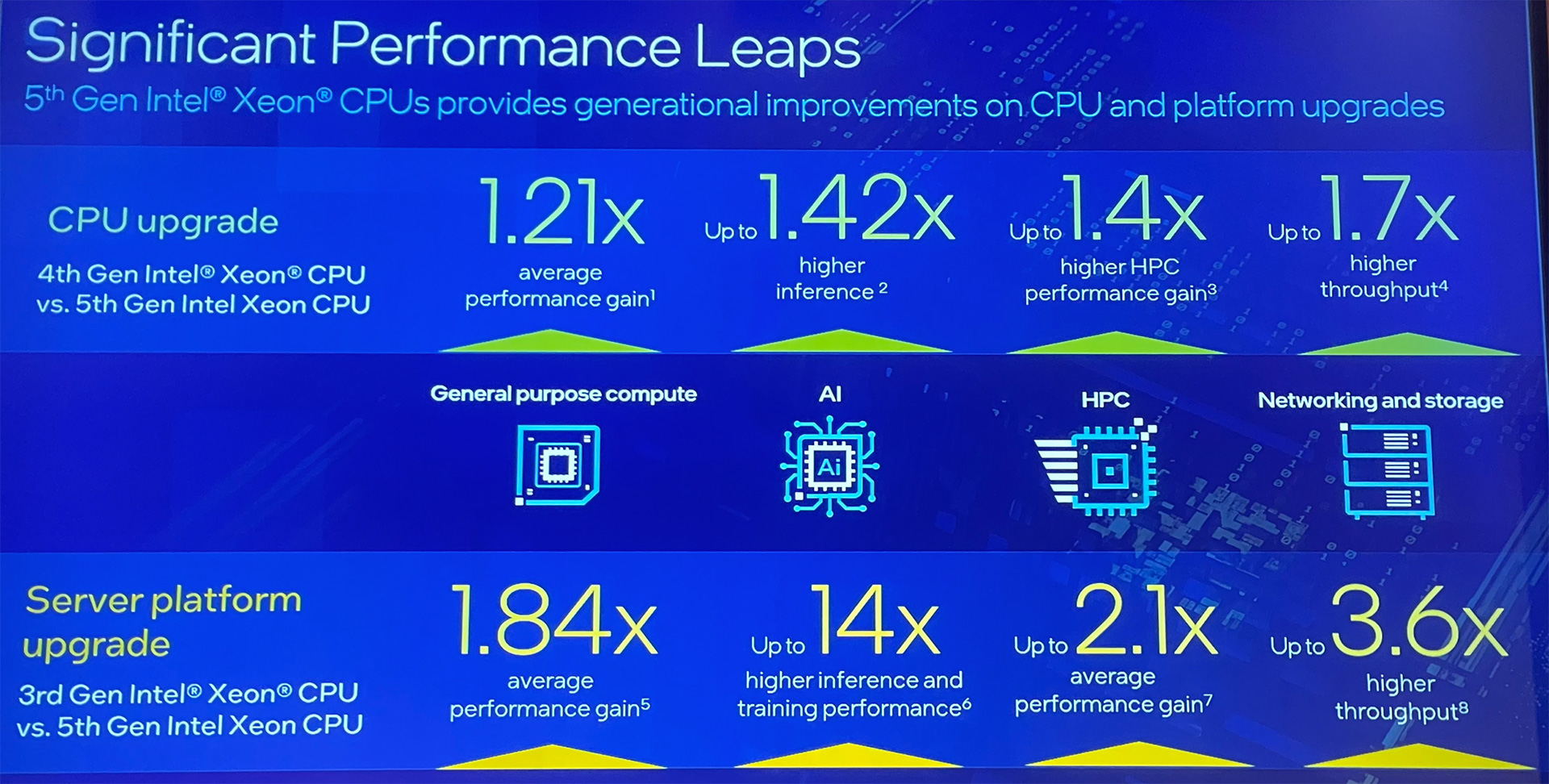

Intel ha fornito numerosi risultati prestazionali che mettono a confronto le piattaforme Xeon di quarta generazione della famiglia Sapphire Rapids con quelle di quinta generazione Emeral Rapids, evidenziando interessanti incrementi che variano molto a seconda del tipo di impiego.

Si passa da un 21% medio nelle elaborazioni di tipo general purpose a un 42% quale picco massimo con elaborazioni di intelligenza artificiale e una percentuale speculare nelle elaborazioni di High Performance Computing (HPC). Netto balzo in avanti anche per quanto riguarda il throughput di rete e storage, con un incremento sino al 70% rispetto alla precedente generazione.

Se spostiamo il confronto rispetto alla famiglia di processori Xeon di terza generazione, interessante per valutare i benefici di un aggiornamento di sistemi in uso già da un paio di anni, il balzo in avanti è ancora più netto in tutti gli ambiti ma diventa ancor più rilevante nelle elaborazioni di intelligenza artificiale: sino a 14 volte in più, merito delle novità architetturali implementate all'interno dei processori Xeon tanto di 4a come di 5a generazione legate proprio a questo genere di elaborazioni.

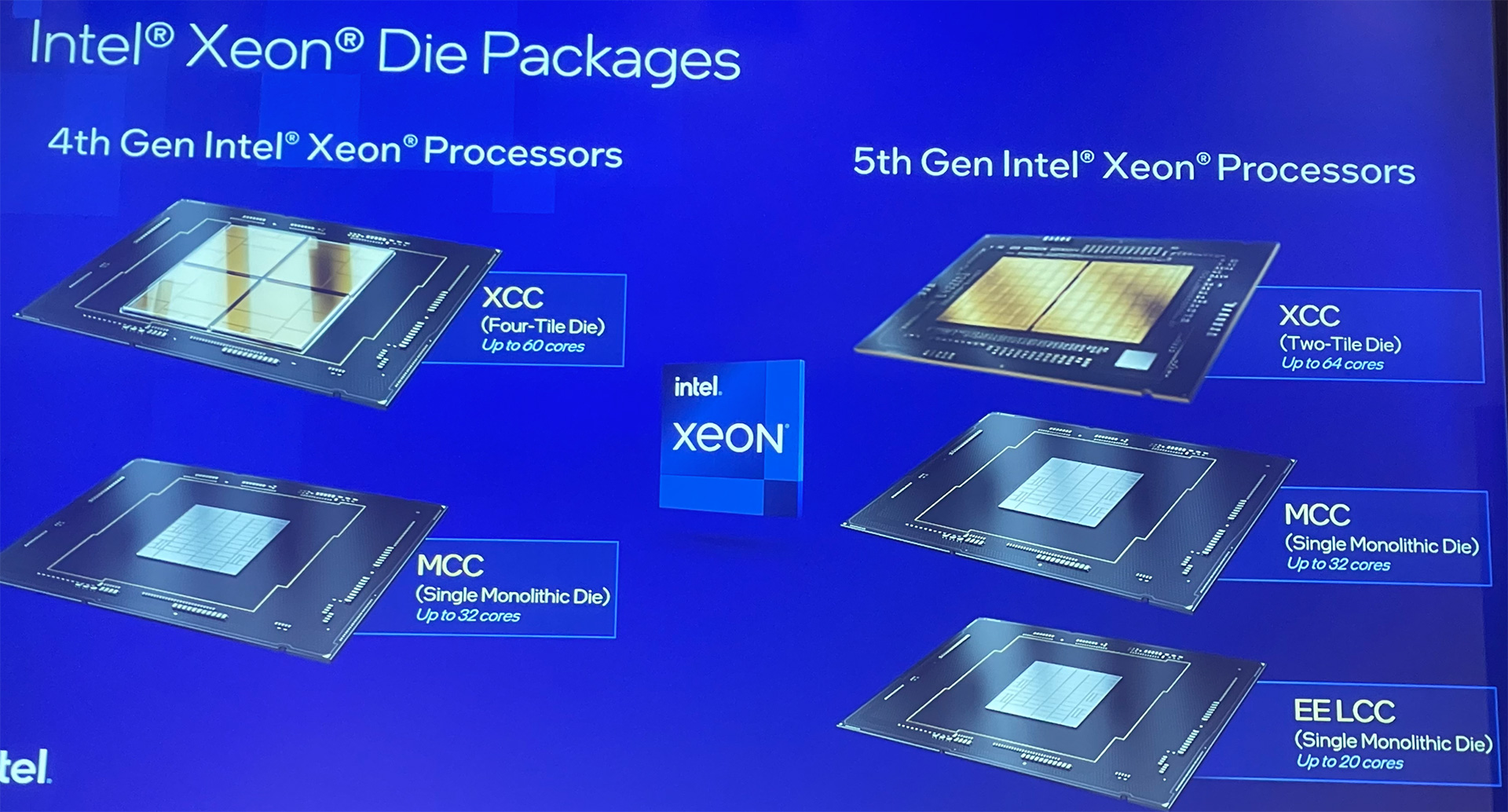

Con i processori Xeon di quinta generazione Intel ha introdotto 3 differenti tipologie di package, contro le due della precedente generazione. Ritroviamo il package XCC, che cambia per via del differente numero di tile che vengono usate per la costruzione del processore (dalle 4 delle CPU Xeon di quarta generazione alle 2 di quelle di quinta generazione).

Il secondo tipo di package è quello MCC, single monolitic die, nel quale è implementato un singolo die che mette a disposizione un massimo di 32 core per ciascuna delle due generazioni di processore Xeon. Il terzo package, esclusivo delle CPU Xeon di quinta generazione, è quello EE LCC, dove le due lettere iniziali stanno per Edge Enhanced: si tratta di un design sempre di tipo a singolo die monolitico, che in questo caso si ferma quale massimo a 20 core ed è stato specificamente sviluppato per le installazioni in soluzioni di edge computing.

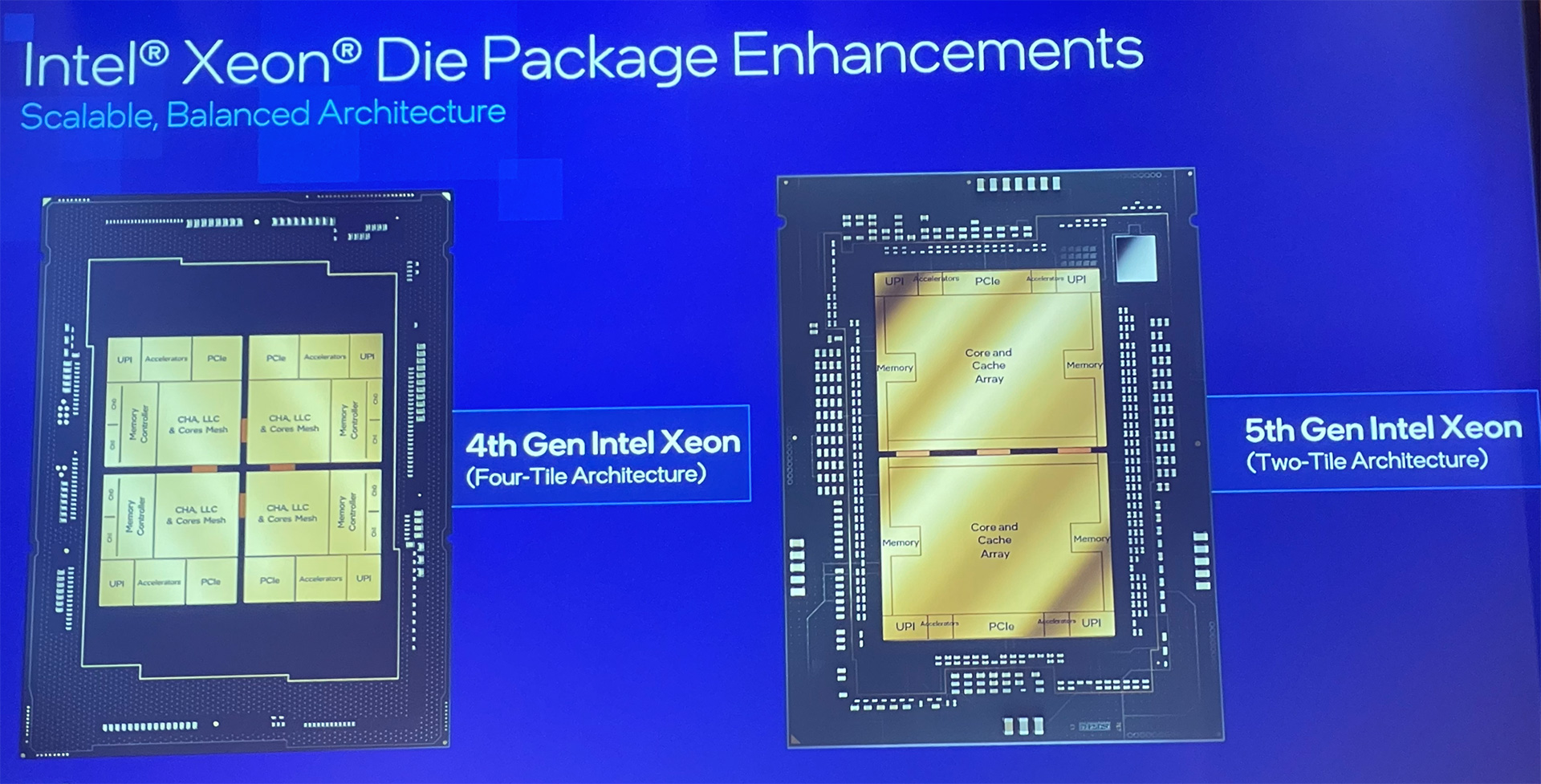

Il package XCC, che viene utilizzato da Intel per le versioni di CPU Xeon dal più elevato numero di core, è stato modificato con le proposte di quarta generazione: il design è ora a due tile contro quello a 4 tile di precedente generazione. Questa scelta di design ha permesso ad Intel di ridurre alcune delle latenze nelle comunicazioni interne al processore con memoria, cache L2 e last level cache, compensando la maggiore complessità costruttiva tipica di un die che ha superficie complessiva superiore.

Tra le ottimizzazioni implementate da Intel nella quinta generazione di processori Xeon ce ne sono diverse legate all'efficienza energetica: se il picco massimo, in termini di TDP, è di fatto rimasto invariato molto è cambiato a livello di consumo effettivo del sistema a percentuali di utilizzo non del 100% quando si abilita l'Optimized Power Mode. La ricaduta pratica è un consumo del sistema inferiore di un valore superiore a 100 Watt, dato tutt'altro che di poco conto tenendo conto della ricerca della massima efficienza energetica possibile in ambito datacenter.

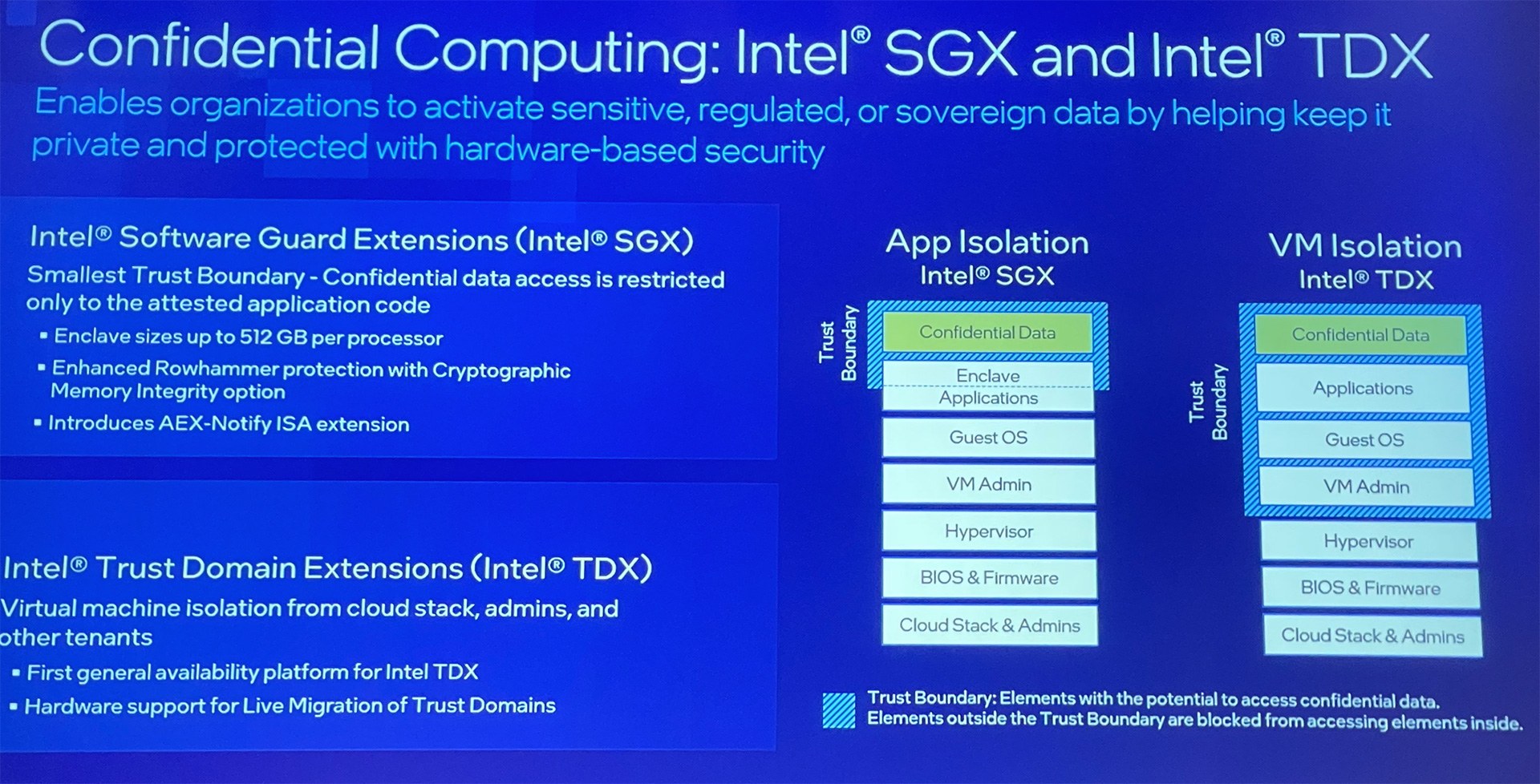

Grande spazio è stato dato anche al tema del Confidential Computing, che punta a offrire un ambiente di elaborazione protetto per i calcoli di intelligenza artificiale che garantisca alle aziende di mantenere sicuri a criptati a occhi esterni i dati. Questo è stato ottenuto facendo leva sulle tecnologie Intel Software Guard Extensions (SGX) e Intel Trust Domain Extension (TDX), grazie alle quali viene fornito un supporto hardware specifico per la sicurezza nelle elaborazioni di IA.

Clicca per ingrandire

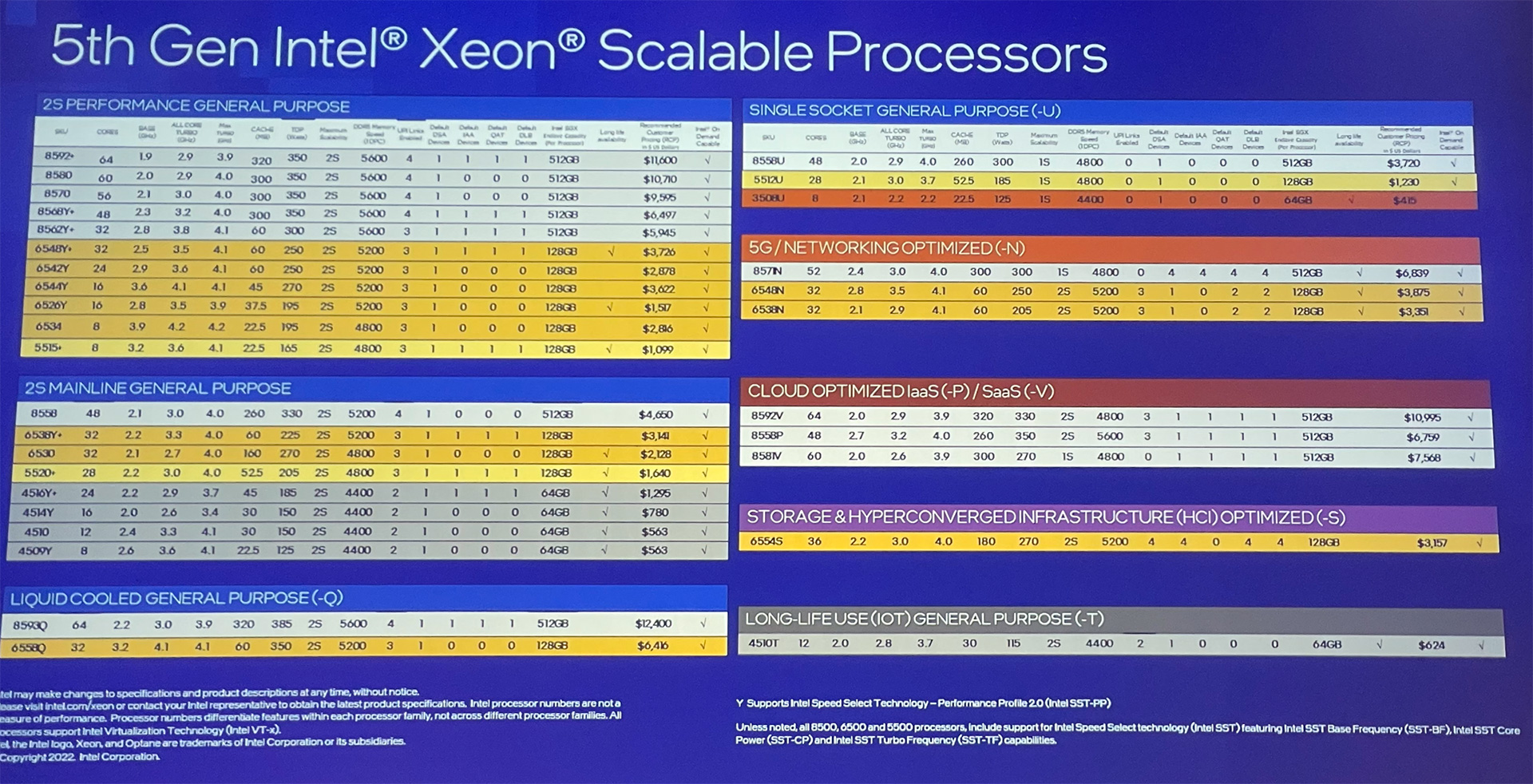

Per i processori Xeon di quinta generazione Intel ha previsto un gran numero di varianti, con la peculiarità che in questa generazione è stato scelto di non offrire supporto a configurazioni che integrano al proprio interno più di 2 socket. Le configurazioni variano da un minimo di 8 core per processore sino a un massimo di 64 core, con declinazioni ottimizzate per il funzionamento con sistemi di raffreddamento a liquido e per questo motivo in grado di operare con una frequenza di clock più alta.

Per il modello Xeon 8593Q, abbinato a raffreddamento a liquido, il TDP arriva a un massimo di 385 Watt con una frequenza di clock pari a 2,2 GHz per tutti i 64 core; la versione più potente tra quelle pensate per sistemi server raffreddati ad aria, il modello Xeon 8592+, vede 64 core operare a 1,9 GHz di clock con un TDP che tocca i 350 Watt. Non mancano modelli pensati per sistemi server a singolo socket, le versioni ottimizzate per sistemi cloud e per le infrastrutture 5G e di networking oltre che per i sistemi destinati allo storage.

Accanto ai processori Xeon di 5a generazione Intel rende disponibili anche le proposte Xeon D-1800/2800 e Xeon E-2400. Per la prima categoria troviamo compatibilità a livello di socket con le piattaforme di precedente generazione basate sulle CPU Xeon D-1700/2700, con un numero massimo di core integrati che passa dai precedenti 20 agli attuali 22. Sono state integrate le tecnologie Intel Speed Select e TF, unitamente a un sottosistema di rete 2x100GB Ethernet nelle CPU Xeon D-1800.

Le CPU Xeon E-2400 passano al socket LGA 1700, al posto di quello LGA 1200 adottato dai processori Xeon E-2300, mantenendo la struttura a singolo socket e il massimo numero di core pari a 8. L'architettura lato CPU passa da quella Cypress Cove all'attuale Raptor Lake e cambia l'architettura della memoria, che da quella DDR4-3200 passa a quella DDR5-4800. Il controller PCI Express integrato è sempre a 20 linee totali, delle quali 16 di tipo PCI Express 5.0 mentre per la piattaforma precedente erano 20 linee tutte PCI Express 4.0. L'aggiornamento al controller PCI Express ha interessato anche il PCH, con 20 linee PCIe 4.0 e 8 linee PCI Express 3.0 contro le precedenti 24 tutte PCI Express 3.0.

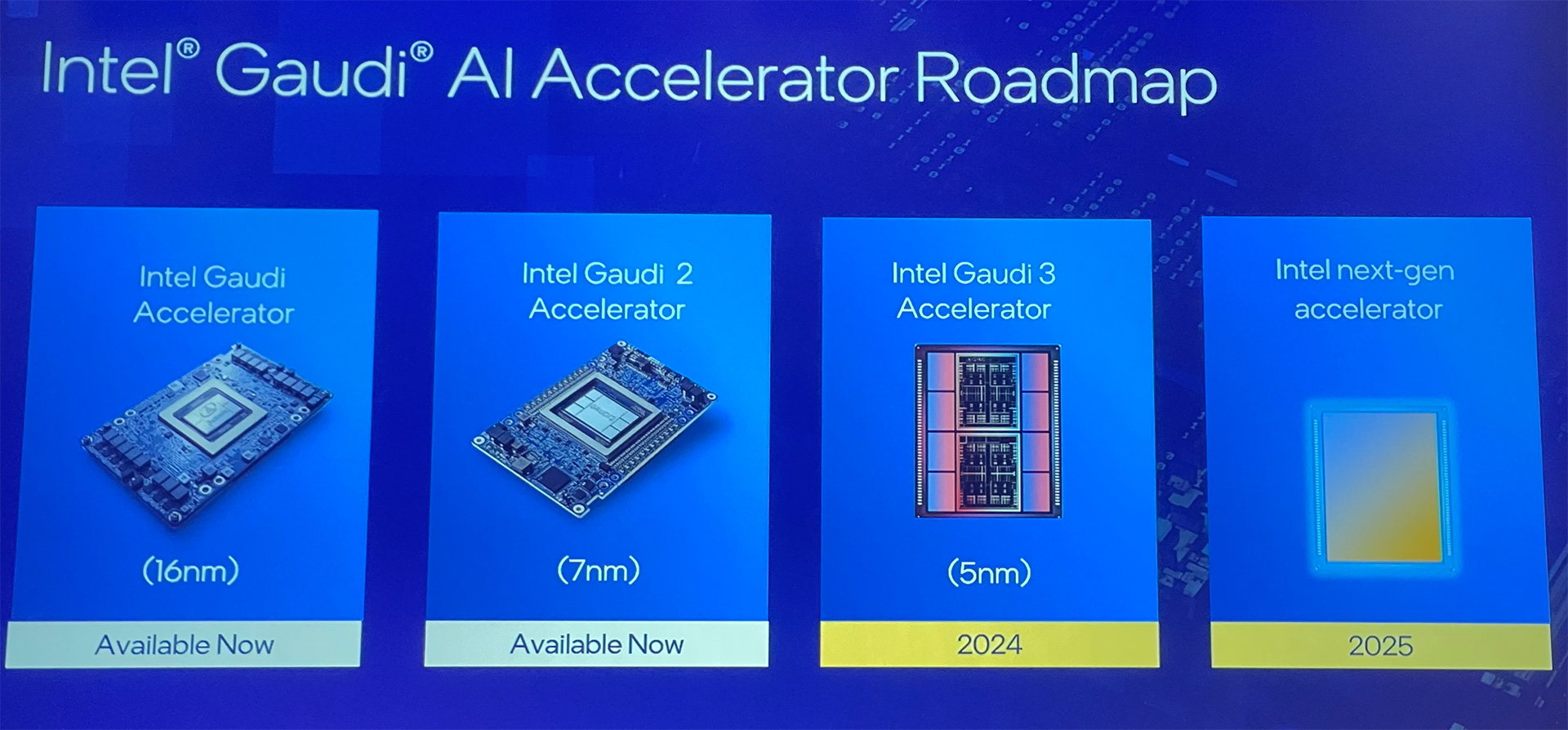

Accanto alle nuove CPU Xeon di quinta generazione Intel rimarca la disponibilità degli acceleratori della famiglia Gaudi 2, frutto dell'acquisizione di Habana Labs avvenuta alla fine del 2019. Al momento attuale Intel propine Gaudi 2, costruito con tecnologia produttiva a 7 nanometri, ma nel prossimo futuro avremo il debutto di Gaudi 3 a 5 nanometri seguito, nel 2025, dalla prossima generazione di acceleratore.

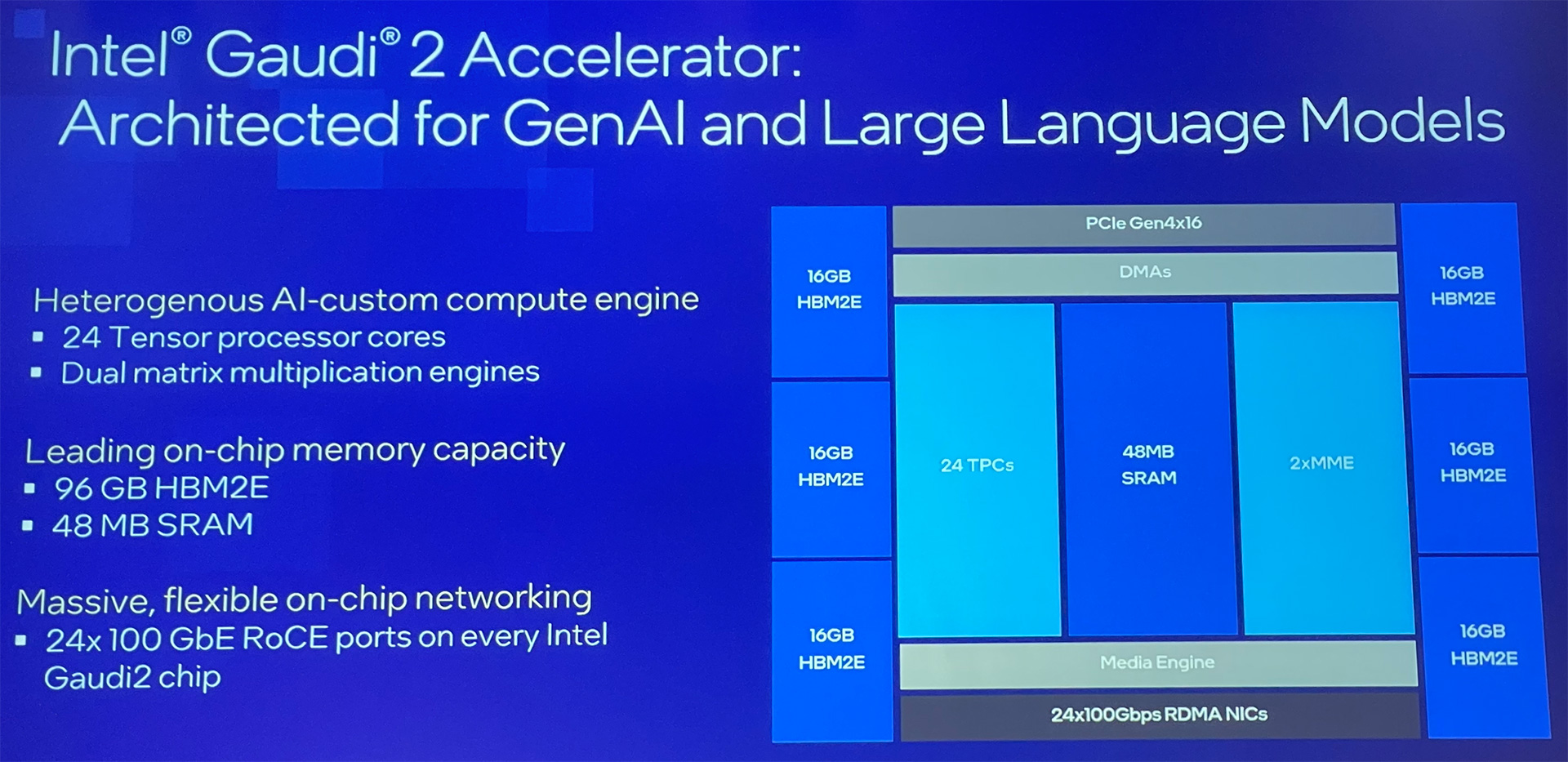

Per Gaudi 3 Intel ha anticipato di attendersi importanti balzi in avanti in termini di prestazioni velocistiche, con un raddoppio della bandwidth nell'infrastruttura di networking integrata e un +50% nella bandwidth della memoria HBM montata sul package. Tutto questo, assieme alle innovazioni a livello di architettura, permetteranno di ottenere una capacità di elaborazione in BF16 superiore di 4 volte rispetto a quanto a ora a disposizione delle soluzioni Gaudi 2.

In ogni scheda Gaudi 2 sono integrati 24 tensor processor core con due matrix multiplication engine, affiancati da 96 GB di memoria HBM2E con una memoria SDRAM dedicata di 48MB. A livello di die sono inoltre presenti 24 schede di rete 100 Gbit, necessarie per costruire sistemi nei quali più schede Gaudi 2 vengono affiancate e fatte elaborare in modo parallelo tra di loro.

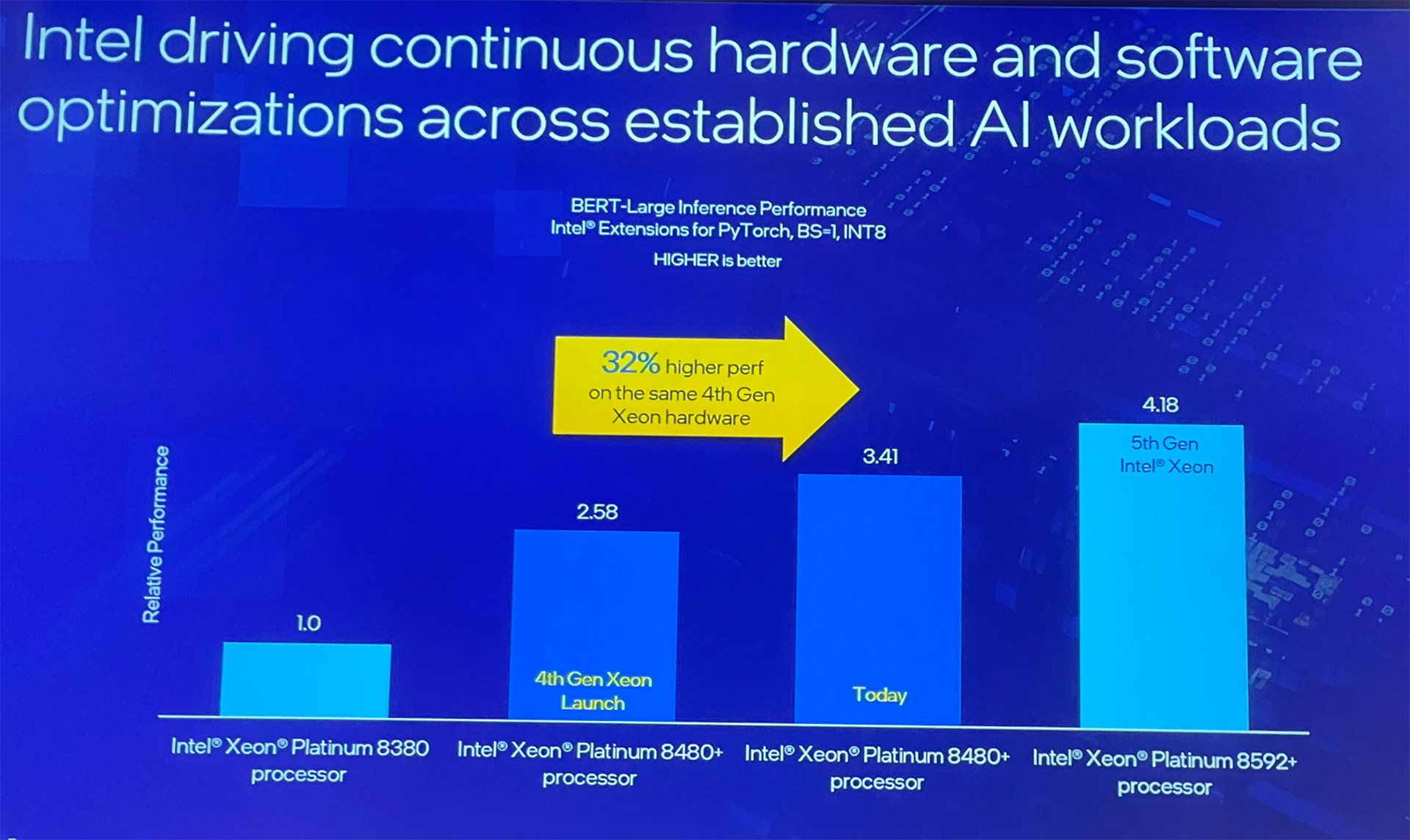

Affiancare CPU sempre più potenti e acceleratori dedicati è la strada maestra per ottenere elevate prestazioni con elaborazioni di intelligenza artificiale, ma non è sufficiente. Intel ha infatti rimarcato l'importanza del lavoro di ottimizzazione lato software mostrando, con questa slide, come questo permetta a parità di architettura sottostante di ottenere un rilevante impatto positivo sulle prestazioni.

La cosa non deve sorprendere particolarmente in quanto è nella natura delle elaborazioni di IA quella di richiedere un costante affinamento software che permetta di sfruttare al meglio l'hardware a disposizione: il lavoro sulla componente software, del resto, è tema che riguarda tutte le aziende produttrici di hardware che si stanno impegnando in modo specifico nell'ambito delle elaborazioni di intelligenza artificiale.

Per questo motivo sarà molto interessante vedere in che modo Intel, AMD, NVIDIA e tutte le aziende impegnate nel settore si muoveranno nel corso del 2024 alla ricerca di quella combinazione tra hardware e ottimizzazione software che possa permettere di ottenere i migliori risultati nelle sempre più complesse e richieste elaborazioni di intelligenza artificiale.

FRITZ!Repeater 1700 estende la rete super-veloce Wi-Fi 7

FRITZ!Repeater 1700 estende la rete super-veloce Wi-Fi 7 Fondazione Chips-IT, l'Italia alla riscossa nei chip. Il piano e la partnership EssilorLuxottica

Fondazione Chips-IT, l'Italia alla riscossa nei chip. Il piano e la partnership EssilorLuxottica Nutanix: innovazione, semplicità e IA al centro della strategia hybrid multicloud

Nutanix: innovazione, semplicità e IA al centro della strategia hybrid multicloud Intel prova macchinari 'cinesi' per i chip del futuro? Il caso ACM scuote Washington

Intel prova macchinari 'cinesi' per i chip del futuro? Il caso ACM scuote Washington Windows 11, problemi con l'aggiornamento KB5072033 e codice errore 0x800f0991

Windows 11, problemi con l'aggiornamento KB5072033 e codice errore 0x800f0991 Bitcoin, sono passati 15 anni dalla 'scomparsa' di Satoshi Nakamoto. Un mistero ancora irrisolto

Bitcoin, sono passati 15 anni dalla 'scomparsa' di Satoshi Nakamoto. Un mistero ancora irrisolto DAZN lancia il Pass Giornata per la Serie A: come si attiva e quanto costa

DAZN lancia il Pass Giornata per la Serie A: come si attiva e quanto costa Street Fighter: Paramount e Capcom pubblicano il primo trailer ufficiale del nuovo film

Street Fighter: Paramount e Capcom pubblicano il primo trailer ufficiale del nuovo film Corsa finale all'ultimo sconto: Amazon promette un weekend con sconti eccezionali un po' su tutto, ecco quelli che abbiamo trovato

Corsa finale all'ultimo sconto: Amazon promette un weekend con sconti eccezionali un po' su tutto, ecco quelli che abbiamo trovato Per Tom Cruise niente film nello spazio: non vuole avvicinarsi a Trump e Musk

Per Tom Cruise niente film nello spazio: non vuole avvicinarsi a Trump e Musk Invincible VS, dopo fumetti e serie TV arriva il picchiaduro con la giusta dose di sangue

Invincible VS, dopo fumetti e serie TV arriva il picchiaduro con la giusta dose di sangue Il robot umanoide che voleva fare il maggiordomo andrà in fabbrica

Il robot umanoide che voleva fare il maggiordomo andrà in fabbrica Galaxy Tab S10 Lite a 299 su Amazon: tablet Samsung elegante con S Pen e Android 15 a prezzo bomba

Galaxy Tab S10 Lite a 299 su Amazon: tablet Samsung elegante con S Pen e Android 15 a prezzo bomba Prezzi in picchiata sull'hardware PC: GPU, CPU e monitor in offerta per l'upgrade

Prezzi in picchiata sull'hardware PC: GPU, CPU e monitor in offerta per l'upgrade Aspyr ha rinviato Deus Ex Remastered: progetto in revisione dopo i feedback negativi

Aspyr ha rinviato Deus Ex Remastered: progetto in revisione dopo i feedback negativi Amazon Haul, prezzi mini senza precedenti: migliaia di prodotti a meno di 2

Amazon Haul, prezzi mini senza precedenti: migliaia di prodotti a meno di 2

5 Commenti

Gli autori dei commenti, e non la redazione, sono responsabili dei contenuti da loro inseriti - infoLe slide si basano su test reali

Test reali ... solo che non è chiaro quali test e quanto sono stati ottimizzati per sfruttare le peculiarità di Emerald Rapids.

https://www.tomshardware.com/pc-com...l3-and-350w-tdp

Sulle slide di meteor lake in piccolo c'era scritto "estimate"

Devi effettuare il login per poter commentare

Se non sei ancora registrato, puoi farlo attraverso questo form.

Se sei già registrato e loggato nel sito, puoi inserire il tuo commento.

Si tenga presente quanto letto nel regolamento, nel rispetto del "quieto vivere".