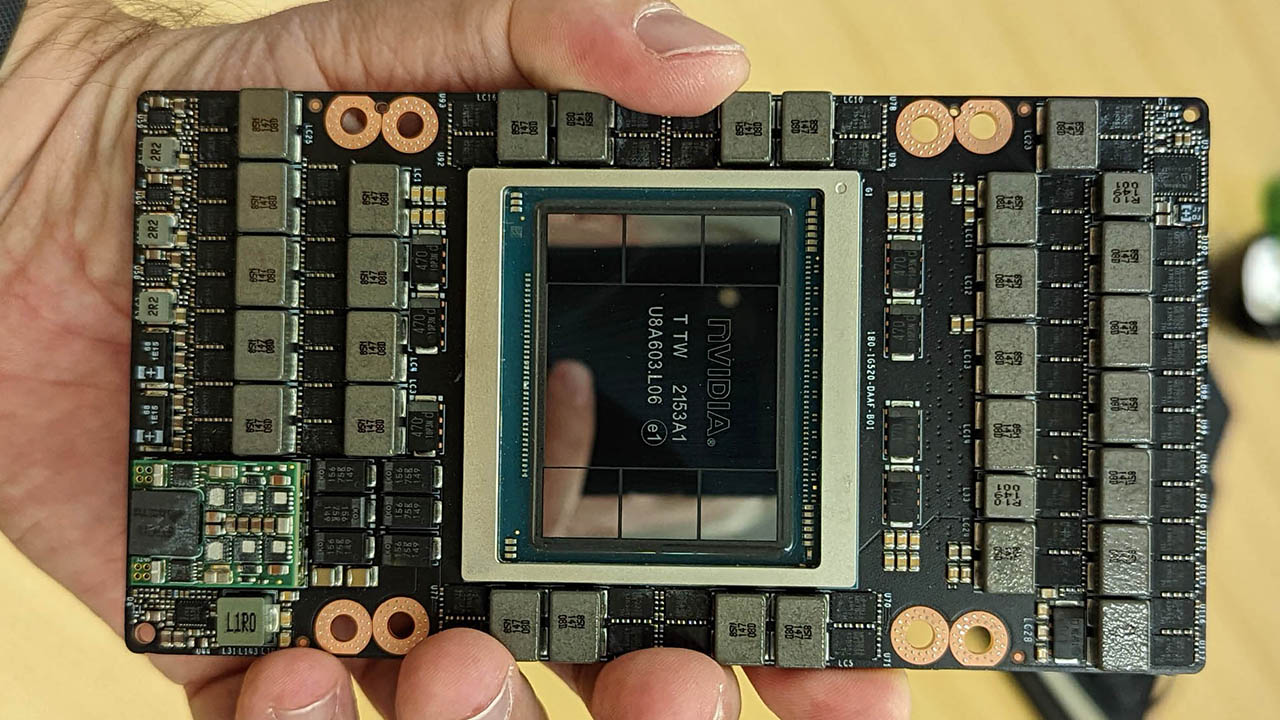

NVIDIA H100 vista da vicino: Hopper e 80 GB di memoria nel palmo di una mano

A poco più di un mese della GTC 2022, il sito di settore ServeTheHome è riuscito a mettere (letteralmente) le mani sull'acceleratore NVIDIA H100 basato su architettura Hopper. Ecco da vicino in due foto ravvicinate nel formato SXM.

di Manolo De Agostini pubblicata il 06 Maggio 2022, alle 11:11 nel canale Schede VideoNVIDIAHopper

Finora avevamo visto solo dei rendering, ma adesso possiamo ammirare NVIDIA H100 e la sua GPU GH100 in foto reali e ravvicinate. Patrick Kennedy del sito ServeTheHome ha avuto la possibilità di tenere tra le mani - o meglio, in una mano grazie al design SXM - il nuovo acceleratore di NVIDIA per il mondo degli HPC e dell'AI.

Al centro di NVIDIA H100 c'è una GPU realizzata con processo personalizzato 4N di TSMC chiamata Hopper (qui tutti i dettagli): si tratta di un "mostro" da 80 miliardi di transistor sostenuto da 80 GB di memoria HBM3 su bus a 5120 bit sullo stesso package grazie alla tecnologia CoWoS di TSMC.

La GPU copre un'area di 814 mm2 e al suo interno conta 144 Streaming Multiprocessor per un totale di 18432 CUDA core FP32, anche se nel modello che vedete - per ragioni di rese produttive - il numero di unità attive scende a 16896 (132 SM). Allo stesso modo, i 6 chip HBM3 offrono in realtà 96 GB di memoria che non è però totalmente accessibile. Il tutto porta il TDP a circa 700W.

Non bisogna dimenticare che NVIDIA offrirà la nuova GPU anche nel formato "a scheda" tradizionale: si tratterà di una soluzione con interfaccia PCI Express 5.0, 14592 CUDA core (114 SM) e 80 GB di memoria HBM2E per un TDP di 350W. NVIDIA H100 debutterà ufficialmente nel terzo trimestre in varie forme e soluzioni, finendo ad esempio nella quarta generazione di DGX chiamata DGX H100.

La rivoluzione dei dati in tempo reale è in arrivo. Un assaggio a Confluent Current 2025

La rivoluzione dei dati in tempo reale è in arrivo. Un assaggio a Confluent Current 2025 SAP Sapphire 2025: con Joule l'intelligenza artificiale guida app, dati e decisioni

SAP Sapphire 2025: con Joule l'intelligenza artificiale guida app, dati e decisioni Dalle radio a transistor ai Micro LED: il viaggio di Hisense da Qingdao al mondo intero

Dalle radio a transistor ai Micro LED: il viaggio di Hisense da Qingdao al mondo intero Una domenica bestiale Amazon: LG OLED, super portatile Lenovo, iPhone 16 Pro e Pro Max, robot e altri super sconti

Una domenica bestiale Amazon: LG OLED, super portatile Lenovo, iPhone 16 Pro e Pro Max, robot e altri super sconti DJI Mini 4 Pro Fly More Combo: drone leggero che non richiede il patentino oggi in offerta super su Amazon

DJI Mini 4 Pro Fly More Combo: drone leggero che non richiede il patentino oggi in offerta super su Amazon realme GT 7T: display da 6000 nit, potentissimo, 7000 mAh, quasi un top di gamma a metà del prezzo che ti aspetti

realme GT 7T: display da 6000 nit, potentissimo, 7000 mAh, quasi un top di gamma a metà del prezzo che ti aspetti Ancora qualche pezzo per il portatile Lenovo con Core i7, 40GB RAM e 1TB SSD: va sempre a ruba

Ancora qualche pezzo per il portatile Lenovo con Core i7, 40GB RAM e 1TB SSD: va sempre a ruba TV OLED LG Serie C4 2024: immagini da cinema e 4K a 144Hz in sconto su Amazon

TV OLED LG Serie C4 2024: immagini da cinema e 4K a 144Hz in sconto su Amazon Smartwatch Amazfit in sconto: Active 2 a 97, ma ci sono offerte su tutta la gamma

Smartwatch Amazfit in sconto: Active 2 a 97, ma ci sono offerte su tutta la gamma Router e ripetitori AVM FRITZ! da 30 su Amazon: ecco tutte le offerte da non perdere

Router e ripetitori AVM FRITZ! da 30 su Amazon: ecco tutte le offerte da non perdere Adulting 101: i corsi per imparare come era la vita fino a qualche anno fa

Adulting 101: i corsi per imparare come era la vita fino a qualche anno fa Blue Origin ha lanciato con successo la missione suborbitale NS-32 con New Shepard

Blue Origin ha lanciato con successo la missione suborbitale NS-32 con New Shepard L'amministrazione Trump ha ritirato la candidatura di Jared Isaacman come amministratore della NASA

L'amministrazione Trump ha ritirato la candidatura di Jared Isaacman come amministratore della NASA La NASA potrebbe chiudere le missioni OSIRIS-APEX, New Horizons e Juno cancellandone altre per risparmiare soldi

La NASA potrebbe chiudere le missioni OSIRIS-APEX, New Horizons e Juno cancellandone altre per risparmiare soldi Trump vieta anche la vendita di software per la progettazione di chip alle società cinesi

Trump vieta anche la vendita di software per la progettazione di chip alle società cinesi Le migliori offerte del weekend Amazon: portatili, robot, iPhone, Kindle ai prezzi più bassi di sempre

Le migliori offerte del weekend Amazon: portatili, robot, iPhone, Kindle ai prezzi più bassi di sempre Dreame L40 Ultra a 699, prezzo shock: vale quasi quanto lX40 Ultra da 999 (ma costa 300 in meno!)

Dreame L40 Ultra a 699, prezzo shock: vale quasi quanto lX40 Ultra da 999 (ma costa 300 in meno!)

6 Commenti

Gli autori dei commenti, e non la redazione, sono responsabili dei contenuti da loro inseriti - infoHPC

Sta per High Performance Computing, che negli ultimi anni è diventato sempre più prerogativa (nel mondo scientifico) del calcolo su GPU.Un esempio è questo: luso delle A100 ha consentito di trovare risultati mai visti prima sullidrodinamica delle spugne di profondità (studio tutto italiano, guidato da Tor Vergata, Cineca e IIT):

https://www.nature.com/articles/s41586-021-03658-1

HPC...

...tradotto in lingua italiana "calcolo ad alte prestazioni". Calcolo di vario tipo ovviamente scientifico ma temo anche rivolto ad altri ehm settori del lato oscuro dello scibile umano.Marco71

La strada dei chiplet è più difficile perché hanno bisogno di interconnessioni veloci e con pochissima latenza ma si hanno meno problemi di rese e scarti.

E SI !!

Si scottial77 ci gira Crysis in tutte le sue versioni contemporaneamente e senza un utente umanoDevi effettuare il login per poter commentare

Se non sei ancora registrato, puoi farlo attraverso questo form.

Se sei già registrato e loggato nel sito, puoi inserire il tuo commento.

Si tenga presente quanto letto nel regolamento, nel rispetto del "quieto vivere".