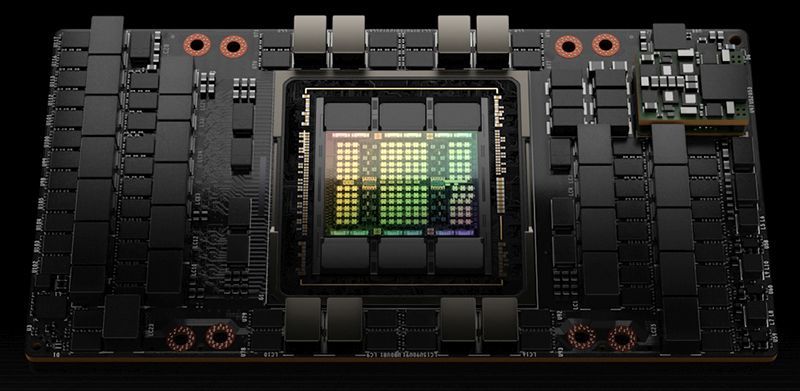

NVIDIA H100, la domanda è altissima: almeno 22 miliardi di dollari di fatturato nel 2023

Non ci sono solo le società cinesi e statunitensi pronte a riversare denaro nelle tasche di NVIDIA per i suoi acceleratori di intelligenza artificiale: sulla scena si affacciano anche i paesi mediorientali come Emirati Arabi Uniti e Arabia Saudita.

di Manolo De Agostini pubblicata il 17 Agosto 2023, alle 11:31 nel canale Schede VideoHopperNVIDIA

Non ci sono solo le società cinesi a voler ricoprire di soldi NVIDIA per avere i suoi acceleratori di intelligenza artificiale ma anche Arabia Saudita ed Emirati Arabi Uniti sono desiderose di fare altrettanto. Le due realtà vogliono trovare un posto al sole nel mondo hi-tech e, facendo affidamento agli immensi proventi derivati dalla vendita del petrolio, sono pronte a entrare in scena.

Secondo quanto riportato dal Financial Times, TSMC - che si occupa di produrre le GPU di NVIDIA - dovrebbe consegnare circa 550.000 GPU Hopper H100 quest'anno alle società che stanno creando i servizi di intelligenza artificiale generativa, come ChatGPT e molti altri. Poiché un acceleratore si dice costi circa 40.000 dollari, si tratta di vendite per almeno 22 miliardi di dollari per un unico prodotto.

Se gli ordini dalla Cina per NVIDIA A800 ammontano a 5 miliardi di dollari fino al 2024, Arabia Saudita ed Emirati Arabi Uniti sembra partiranno a ritmi meno sostenuti, puntando però sull'acceleratore più evoluto: acquisteranno quante più GPU NVIDIA H100 permetterà loro di ordinare, ma siccome probabilmente gran parte della capacità produttiva è già stata riservata, si parla per l'Arabia Saudita di circa 3000 GPU entro fine anno, per un controvalore di circa 120 milioni di dollari, noccioline per lo stato arabo.

Tenendo però conto, almeno così riporta il Financial Times, che ChatGPT è stato sviluppato da OpenAI con "appena" 1024 acceleratori NVIDIA A100 di precedente generazione in un mese solo, triplicare quel numero potrebbe dare all'Arabia la possibilità di creare servizi ben più evoluti, fermo restando le idee e le capacità informatiche.

I paesi del golfo arabo stanno cercando di non legarsi mani e piedi a Cina e Stati Uniti nel campo dell'AI e per questo motivo vogliono realizzare tecnologie proprietarie e attrarre talenti ingegneristici. A tal proposito, gli Emirati hanno già sviluppato un modello linguistico di grandi dimensioni (LLM) open source chiamato Falcon gestito da un'università con legami statali.

L'Arabia Saudita punta anche a creare un proprio supercomputer di ultima generazione chiamato Shaheen III basato su oltre 2800 Grace Hopper Superchip – non è chiaro se la versione HBM3 o l'ultimissima HBM3E.

Il quotidiano conclude affermando che NVIDIA darà probabilmente la priorità alle società con sede negli Stati Uniti per le consegne degli acceleratori H100, quindi OpenAI, Microsoft e Google in primis, ma davanti a un assegno in bianco dalla penisola arabica certi propositi potrebbero vacillare. Alcuni analisti ritengono che NVIDIA potrebbe rastrellare ricavi di 300 miliardi di dollari nel segmento AI entro il 2027.

Tutta questa domanda potrebbe avere un effetto sull'allocazione produttiva di NVIDIA presso TSMC, il che significa che la società potrebbe sacrificare una parte della produzione di GPU GeForce per avere più chip H100, il cui margine di profitto è decisamente più cospicuo. Ciò potrebbe avere ripercussioni sulla disponibilità e i prezzi delle schede video, ma per il momento questa è da intendersi come una mera supposizione.

BOOX Note Air4 C è uno spettacolo: il tablet E Ink con Android per lettura e scrittura

BOOX Note Air4 C è uno spettacolo: il tablet E Ink con Android per lettura e scrittura Recensione Sony Xperia 1 VII: lo smartphone per gli appassionati di fotografia

Recensione Sony Xperia 1 VII: lo smartphone per gli appassionati di fotografia Attenti a Poco F7: può essere il best buy del 2025. Recensione

Attenti a Poco F7: può essere il best buy del 2025. Recensione DJI OSMO Mobile SE a 69: il gimbal compatto che trasforma i video dello smartphone in riprese da pro

DJI OSMO Mobile SE a 69: il gimbal compatto che trasforma i video dello smartphone in riprese da pro Scope elettriche da record su Amazon: due modelli potentissimi sotto i 120, ecco perché piacciono così tanto

Scope elettriche da record su Amazon: due modelli potentissimi sotto i 120, ecco perché piacciono così tanto GTA 6 a 80 euro? Take-Two frena sul prezzo e punta tutto sul valore percepito

GTA 6 a 80 euro? Take-Two frena sul prezzo e punta tutto sul valore percepito I 3 portatili più convenienti su Amazon: sono 2 tuttofare Lenovo e un HP Victus gaming con RTX 5060

I 3 portatili più convenienti su Amazon: sono 2 tuttofare Lenovo e un HP Victus gaming con RTX 5060 AirPods Pro 2 a soli 199: su Amazon anche AirPods 4 in sconto, ecco le differenze che contano

AirPods Pro 2 a soli 199: su Amazon anche AirPods 4 in sconto, ecco le differenze che contano 2 Smart TV 4K Hisense con doppio sconto su Amazon: sono OLED e QLED, 55" e 75", fateci un bel pensierino

2 Smart TV 4K Hisense con doppio sconto su Amazon: sono OLED e QLED, 55" e 75", fateci un bel pensierino Portatili Apple ai minimi: MacBook Pro con chip M4 a 1.648 e Macbook Air 13 16GB7256GB, sempre M4, a 998

Portatili Apple ai minimi: MacBook Pro con chip M4 a 1.648 e Macbook Air 13 16GB7256GB, sempre M4, a 998 Come mantenere Windows 10 sicuro dopo il 2025: tutto sul programma ESU

Come mantenere Windows 10 sicuro dopo il 2025: tutto sul programma ESU Finalmente è tornato su Amazon l'iPhone 16 128GB a 749, in tutti i colori, ma ci sono anche i 16e e 16 Pro in offerta

Finalmente è tornato su Amazon l'iPhone 16 128GB a 749, in tutti i colori, ma ci sono anche i 16e e 16 Pro in offerta Auto nuove? Per il 65% degli italiani sono troppo care, non dovrebbero costare oltre i 20.000 euro

Auto nuove? Per il 65% degli italiani sono troppo care, non dovrebbero costare oltre i 20.000 euro Droni solari Airbus volano nella stratosfera grazie alle nuove batterie al silicio: test riusciti a oltre 20 km di quota

Droni solari Airbus volano nella stratosfera grazie alle nuove batterie al silicio: test riusciti a oltre 20 km di quota Colpo da 15 milioni di dollari: chi ha rubato un carico di prodotti AMD e Apple?

Colpo da 15 milioni di dollari: chi ha rubato un carico di prodotti AMD e Apple? Elon Musk lancia l'allarme su GPT-5: 'OpenAI divorerà Microsoft'. Ma Nadella lo sfida con un sorriso

Elon Musk lancia l'allarme su GPT-5: 'OpenAI divorerà Microsoft'. Ma Nadella lo sfida con un sorriso iPhone 17 Pro sarà più costoso, ma anche più conveniente

iPhone 17 Pro sarà più costoso, ma anche più conveniente

1 Commenti

Gli autori dei commenti, e non la redazione, sono responsabili dei contenuti da loro inseriti - infoDevi effettuare il login per poter commentare

Se non sei ancora registrato, puoi farlo attraverso questo form.

Se sei già registrato e loggato nel sito, puoi inserire il tuo commento.

Si tenga presente quanto letto nel regolamento, nel rispetto del "quieto vivere".