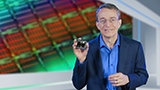

Intel, addio a Hyper Threading?

Si fanno sempre più insistenti le voci circa l'abbandono da parte di Intel della tecnologia Hyper Threading; qual è la verità?

di Alessandro Bordin pubblicata il 07 Marzo 2006, alle 08:39 nel canale ProcessoriIntel

HP Imagine 2026: abbiamo visto HP IQ allopera, ecco cosa può (e non può) fare

HP Imagine 2026: abbiamo visto HP IQ allopera, ecco cosa può (e non può) fare PNY RTX 5080 Slim OC, sembra una Founders Edition ma non lo è

PNY RTX 5080 Slim OC, sembra una Founders Edition ma non lo è Wi-Fi 7 con il design di una vetta innevata: ecco il nuovo sistema mesh di Huawei

Wi-Fi 7 con il design di una vetta innevata: ecco il nuovo sistema mesh di Huawei Stranger Things non è finito! Ecco il trailer di Storie dal 1985

Stranger Things non è finito! Ecco il trailer di Storie dal 1985 iPhone 18, il mistero sul destino della Dynamic Island continua: resta ma sarà più piccola?

iPhone 18, il mistero sul destino della Dynamic Island continua: resta ma sarà più piccola? Motorola lavora al nuovo Razr 70 Ultra: eccolo nei primi render

Motorola lavora al nuovo Razr 70 Ultra: eccolo nei primi render_160.jpg) Il programma di ridimensionamento di OnePlus potrebbe già essere iniziato

Il programma di ridimensionamento di OnePlus potrebbe già essere iniziato L'industria statunitense non è contenta della proposta NASA per le future stazioni spaziali commerciali

L'industria statunitense non è contenta della proposta NASA per le future stazioni spaziali commerciali La NASA cambia strategia per le missioni verso la Luna, la Cina sembra invece più sicura dello svolgimento

La NASA cambia strategia per le missioni verso la Luna, la Cina sembra invece più sicura dello svolgimento Mike Fincke, l'astronauta che ha avuto un malore a bordo della ISS, ha descritto cosa gli è accaduto

Mike Fincke, l'astronauta che ha avuto un malore a bordo della ISS, ha descritto cosa gli è accaduto_160.jpg) I Meta Ray-Ban Display potrebbero non arrivare in Europa: colpa di una normativa UE?

I Meta Ray-Ban Display potrebbero non arrivare in Europa: colpa di una normativa UE? La serie di God of War ha trovato l'attrice che interpreterà Freya

La serie di God of War ha trovato l'attrice che interpreterà Freya Il nuovo iPhone Fold si farà attendere: nuove conferme sul lancio posticipato

Il nuovo iPhone Fold si farà attendere: nuove conferme sul lancio posticipato Ex CEO di Intel furioso verso Wall Street e governo USA: 'se pensi a lungo termine, ti tagliano fuori'

Ex CEO di Intel furioso verso Wall Street e governo USA: 'se pensi a lungo termine, ti tagliano fuori' Un foglietto di rame e le prestazioni di MacBook Neo aumentano drasticamente: 60 fps su Fallout 4

Un foglietto di rame e le prestazioni di MacBook Neo aumentano drasticamente: 60 fps su Fallout 4 100 agenti AI per dipendente: quello che Jensen Huang non dice

100 agenti AI per dipendente: quello che Jensen Huang non dice Le 10 migliori offerte del weekend Amazon: TV OLED e QD-Mini LED, portatili, bici, robot, grossa novità al 5° posto

Le 10 migliori offerte del weekend Amazon: TV OLED e QD-Mini LED, portatili, bici, robot, grossa novità al 5° posto

105 Commenti

Gli autori dei commenti, e non la redazione, sono responsabili dei contenuti da loro inseriti - infoNiagara è molto interessante...volevo segnalare a tal proposito questo interessante articolo: http://www.aceshardware.com/read.jsp?id=65000292

Il problema è come sempre che per sfruttare molti core devi avere SO e applicazioni con elevato livello di parallelismo.

Prima o poi dovranno pur arrivare unità dedicate. E' anche vero che ci sono campi in cui non ha senso avere delle unità dedicate. Per esempio, grafica e fisica (per fisica intendo dinamica dei fluidi, softbodies e dinamica dei corpi rigidi) alla fine sono pesanti applicazioni di calcoli floating-point. Avere delle unità separate per l'una o per l'altra ha senso fino ad un certo punto, considerando che anche nella grafica, molto spesso, ci sono concetti che appartengono alla fisica, come ad esempio l'ottica, la luce e altra roba. Forse oggi hanno senso per contenere i costi, un domani magari una GPU farà entrambi. I processori per cellulari già oggi, infatti, oltre a gestire la grafica fanno tante altre cosette carine in un sigolo chip. Le moderne GPU oggi si occupano anche dei flussi video. Non vedo perchè in un prossimo futuro non si possano occupare di fisica.

Il problema è come sempre che per sfruttare molti core devi avere SO e applicazioni con elevato livello di parallelismo.

Certo, ma nulla che debba far preoccupare piu' di tanto. A livello di programmazione sono uguali 2 core quanti averne 100. Con le moderne architetture, fortemente basate sul parallelismo di esecuzione, ha senso utilizzare OpenMP. Ormai thread e processi sono un concetto "vecchio" (nel senso di piu' basso livello), quasi non piu' idoneo per programmare efficientemente su architetture multicore. Con OpenMP è possibile utilizzare delle semplici direttive "pragma" in modo da identificare le sezioni di codice su cui si vuole il parallelismo (detto molto semplicisticamente). Grazie a queste direttive, è il compilatore che si occupa di generare un codice efficiente per sostenere scheduling, dispatch e sincronizzazione, in modo da mettere thread e processi ad un livello inferiore. OpenMP può essere visto come una programmazione parallela di alto livello.

Anche Microsoft (incredibile dictu) in un recente paper che avevo letto da qualche parte, incoraggiava all'uso di OpenMP.

Semplice, geniale e soprattutto sgrava da complesse operazioni di debugging sui thread. In questo caso anche i calcoli non parallelizzabili vengono gestiti dal compilatore. Io sto aspettando GCC 4.2 con ansia, includerà un progetto che si chiama GOMP (GNU OpenMP) e finalmente darà il via alla programmazione parallela semplificata... Dovrebbe essere compratibile pienamente con le specifiche OpenMP 2.5 (che sono un'unificazione della versione 2.0 per C e Fortran). Ma secondo me prima dei dieci mesi non esce...

Mica tanto... Questi mi sa che parlavano serio...

Devi effettuare il login per poter commentare

Se non sei ancora registrato, puoi farlo attraverso questo form.

Se sei già registrato e loggato nel sito, puoi inserire il tuo commento.

Si tenga presente quanto letto nel regolamento, nel rispetto del "quieto vivere".