AMD lancia GAIA, progetto open source per eseguire LLM in locale su Ryzen AI e non solo

AMD ha annunciato GAIA, un'applicazione di IA generativa progettata per eseguire LLM locali e privati su qualsiasi PC Windows - anche se è ottimizzata per le APU AMD Ryzen AI 300 Series dotate di NPU.

di Manolo De Agostini pubblicata il 24 Marzo 2025, alle 06:21 nel canale ProcessoriRyzenAMD

AMD ha annunciato il lancio di GAIA, un progetto open-source pensato per sfruttare la NPU dei Ryzen AI al fine di eseguire modelli di intelligenza artificiale generativa (LLM) in modo locale e privato sui PC Windows.

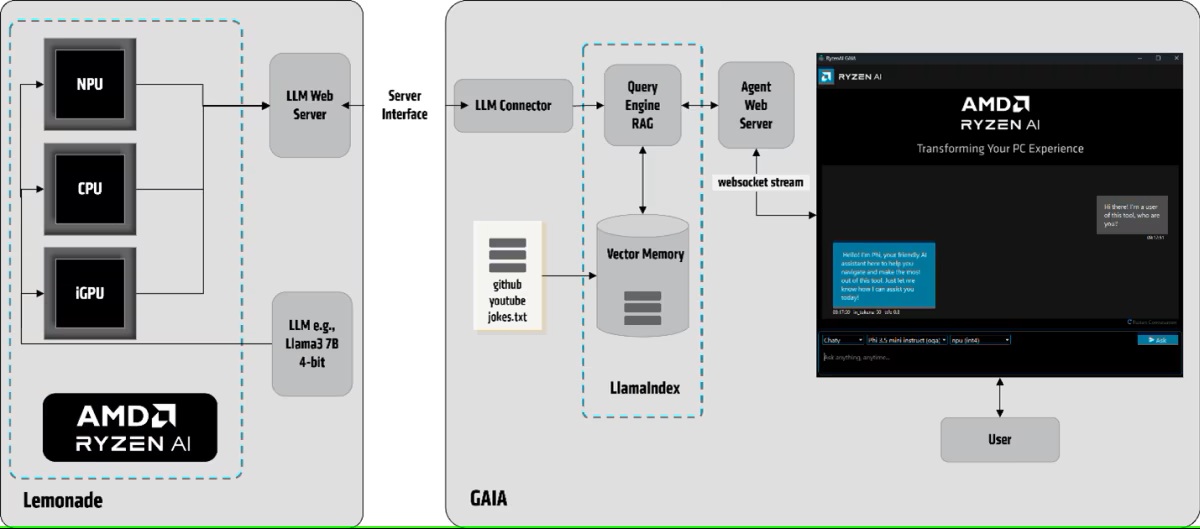

GAIA è un’applicazione avanzata di intelligenza artificiale generativa che permette di eseguire LLM in locale su PC dotati di processori AMD Ryzen AI 300 Series. L'uso della NPU, di pari passo ai core x86 e alla GPU integrata, consente un'elaborazione più veloce e con minori consumi energetici, mantenendo i dati esclusivamente sul dispositivo, senza doverli trasferire a server esterni.

Clicca per ingrandire

GAIA utilizza l'SDK open-source Lemonade di ONNX TurnkeyML per l'inferenza LLM. L’applicazione supporta una vasta gamma di LLM ottimizzati per Ryzen AI, tra cui i modelli Llama e Phi, adatti per applicazioni come generazione di testo, riassunti e risoluzione di problemi complessi.

AMD offre due versioni di GAIA:

- GAIA Installer: compatibile con tutti i PC Windows, sebbene con prestazioni ridotte.

- GAIA Hybrid Installer: ottimizzato per Ryzen AI, sfrutta NPU e iGPU per prestazioni elevate.

L'installazione richiede meno di 10 minuti (istruzioni qui) e, una volta avviata, consente di esplorare diverse funzionalità basate su agenti AI.

Clicca per ingrandire

Uno degli aspetti fondamentali di GAIA è la sua pipeline di Retrieval-Augmented Generation (RAG), che combina modelli di linguaggio con una base di conoscenza per fornire risposte più precise e contestualizzate. Gli agenti attualmente disponibili includono:

- Chaty: chatbot con memoria conversazionale.

- Clip: agente RAG per ricerca e Q&A su YouTube.

- Joker: generatore di battute basato su RAG.

Ulteriori agenti sono in fase di sviluppo e AMD incoraggia gli sviluppatori a contribuire con nuove funzionalità.

GAIA è l'ultima soluzione ad affacciarsi nel nuovo mare di applicazioni LLM localizzate, tra cui LM Studio e ChatRTX. L'esecuzione di un LLM in locale presenta notevoli vantaggi rispetto alle soluzioni basate su cloud, tra cui una maggiore sicurezza, una minore latenza e, in alcuni casi, prestazioni migliori, a seconda dell'hardware. Inoltre, gli LLM locali funzionano offline e non richiedono una connessione a Internet.

Lenovo Legion Go 2: Ryzen Z2 Extreme e OLED 8,8'' per spingere gli handheld gaming PC al massimo

Lenovo Legion Go 2: Ryzen Z2 Extreme e OLED 8,8'' per spingere gli handheld gaming PC al massimo AWS re:Invent 2025: inizia l'era dell'AI-as-a-Service con al centro gli agenti

AWS re:Invent 2025: inizia l'era dell'AI-as-a-Service con al centro gli agenti Cos'è la bolla dell'IA e perché se ne parla

Cos'è la bolla dell'IA e perché se ne parla SpaceX: un satellite ha fotografato il satellite Starlink 35956 danneggiato in orbita mostrando le sue condizioni

SpaceX: un satellite ha fotografato il satellite Starlink 35956 danneggiato in orbita mostrando le sue condizioni 36 idee regalo con offerte Amazon sotto i 50, arrivano prima di Natale (controllate ad una ad una)

36 idee regalo con offerte Amazon sotto i 50, arrivano prima di Natale (controllate ad una ad una) Sony assume il controllo dei Peanuts: Snoopy diventa giapponese

Sony assume il controllo dei Peanuts: Snoopy diventa giapponese DJI Neo scende a 149 su Amazon, in versione Combo con accessori e 3 batterie a 259 ma solo fino a mezzanotte

DJI Neo scende a 149 su Amazon, in versione Combo con accessori e 3 batterie a 259 ma solo fino a mezzanotte Scoperto un nuovo esopianeta che orbita intorno a due stelle, come Tatooine di Star Wars

Scoperto un nuovo esopianeta che orbita intorno a due stelle, come Tatooine di Star Wars Blue Origin NS-37: successo per la missione con un passeggero in sedia a rotelle oltre la linea di Kármán

Blue Origin NS-37: successo per la missione con un passeggero in sedia a rotelle oltre la linea di Kármán Potrebbe essere stata rilevata una superkilonova: doppia, potente esplosione, spaziale

Potrebbe essere stata rilevata una superkilonova: doppia, potente esplosione, spaziale La cometa interstellare 3I/ATLAS è nel punto più vicino alla Terra a 269 milioni di chilometri

La cometa interstellare 3I/ATLAS è nel punto più vicino alla Terra a 269 milioni di chilometri Xiaomi 17 Ultra: l'autonomia non sarà un problema

Xiaomi 17 Ultra: l'autonomia non sarà un problema Il processo produttivo a 2 nm di TSMC è già sold out

Il processo produttivo a 2 nm di TSMC è già sold out The Elder Scrolls VI nel 2029 e Fallout 5 non prima del 2030? Nuove voci sulla roadmap di Bethesda

The Elder Scrolls VI nel 2029 e Fallout 5 non prima del 2030? Nuove voci sulla roadmap di Bethesda Il Ryzen 7 9850X3D appare nel catalogo di alcuni rivenditori online, ma rimane il dubbio sul prezzo

Il Ryzen 7 9850X3D appare nel catalogo di alcuni rivenditori online, ma rimane il dubbio sul prezzo Weekend pre natalizio Amazon, ecco tutte le offerte attive con novità e sorprese

Weekend pre natalizio Amazon, ecco tutte le offerte attive con novità e sorprese

3 Commenti

Gli autori dei commenti, e non la redazione, sono responsabili dei contenuti da loro inseriti - infoSinceramente mi pare di aver capito che con una buona scheda video,in locale,una IA lavora bene,a patto di avere una buona scheda grafica di ultima generazione.

Non avendola provata da quello che capisco la piattaforma Ryzen AI offre alla GPU e forse NPU accesso condiviso alla RAM, con un miglioramento delle performance rispetto all'uso di memorie separate

Devi effettuare il login per poter commentare

Se non sei ancora registrato, puoi farlo attraverso questo form.

Se sei già registrato e loggato nel sito, puoi inserire il tuo commento.

Si tenga presente quanto letto nel regolamento, nel rispetto del "quieto vivere".