Intel e SambaNova, nessuna acquisizione ma una partnership nel nome dell'IA

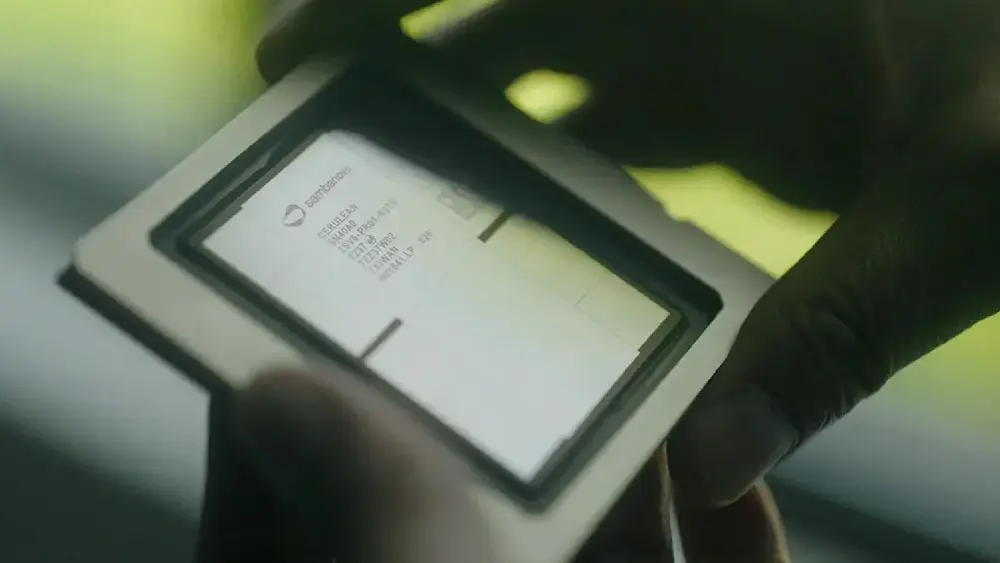

Intel non acquisirà SambaNova, come trapelato nei mesi scorsi. Le due aziende hanno ripiegato su un finanziamento e una partnership che coinvolge i processori Xeon. Sambanova ha inoltre presentato il chip SN50 basato su architettura RDU, progettato per l'inferenza agentica ad alte prestazioni e basso costo, e siglato un accordo con SoftBank.

di Manolo De Agostini pubblicata il 25 Febbraio 2026, alle 09:51 nel canale MercatoXeonSambanovaIntel

Nessuna acquisizione, almeno per ora, ma una partnership attorno alle CPU Xeon e un sostegno economico: si può riassumere così l'affair tra Intel e Sambanova, startup impegnata nello sviluppo di chip per l'inferenza AI.

La partnership con Intel si articola su tre direttrici principali. In primo luogo, l'espansione del cloud AI di SambaNova su infrastruttura basata su processori Intel Xeon, ottimizzata per modelli linguistici e multimodali. In secondo luogo, l'integrazione tra sistemi SambaNova e tecnologie Intel - CPU, acceleratori, networking - per creare soluzioni di inferenza pronte per ambienti enterprise e governativi. Infine, un piano congiunto di go-to-market attraverso i canali globali di Intel.

Il tutto, sottolinea Intel, si inserisce in una strategia che non modifica il percorso di sviluppo delle proprie GPU per datacenter, ma lo affianca con un approccio eterogeneo volto a intercettare la crescente domanda di inferenza AI su larga scala.

Infine, Intel Capital parteciperà al round di finanziamento Series E di SambaNova, che ha superato i 350 milioni di dollari. Tali risorse saranno destinate all'espansione della produzione di SN50, il nuovo acceleratore progettato specificamente per carichi di lavoro di inferenza AI su larga scala, al potenziamento di SambaCloud e all'integrazione software per ambienti enterprise.

L'obiettivo dichiarato di Sambanova con SN50 è offrire un'alternativa alle architetture GPU-centriche, puntando su efficienza, prevedibilità dei costi e scalabilità nei data center. SN50 è basato sull'architettura proprietaria Reconfigurable Data Unit (RDU), ed è pensato per l'AI agentica, ovvero sistemi che orchestrano più modelli e gestiscono flussi di richieste in tempo quasi reale. L'azienda dichiara prestazioni fino a cinque volte superiori rispetto ai chip concorrenti e un TCO fino a tre volte inferiore per le imprese.

Dal punto di vista tecnico, SN50 offre cinque volte più capacità di calcolo per acceleratore e quattro volte la banda di rete rispetto alla generazione precedente. È possibile collegare fino a 256 acceleratori tramite un'interconnessione multi-terabyte al secondo, con l'obiettivo di ridurre il tempo al primo token e supportare batch di dimensioni maggiori.

La piattaforma integra un'architettura di memoria a tre livelli che, secondo quanto comunicato, consente di gestire modelli oltre i 10 trilioni di parametri e contesti superiori ai 10 milioni di token. Funzionalità come memoria residente multi-modello e meccanismi di caching per workload agentici mirano a ottimizzare l'utilizzo dell'hardware, riducendo costi infrastrutturali e latenza. Il chip utilizza alimentazione standard ed è raffreddato ad aria, aspetto che ne facilita l'integrazione nei datacenter esistenti. Le prime consegne ai clienti sono previste entro la fine dell'anno.

Il primo deployment annunciato riguarda SoftBank Corp., che integrerà SN50 nei propri datacenter di nuova generazione in Giappone. SoftBank utilizza già SambaCloud per servizi di inferenza nella regione e con l'adozione di SN50 rafforza la collaborazione, puntando su controllo infrastrutturale, resilienza e requisiti di sovranità dei dati.

HP Imagine 2026: abbiamo visto HP IQ allopera, ecco cosa può (e non può) fare

HP Imagine 2026: abbiamo visto HP IQ allopera, ecco cosa può (e non può) fare PNY RTX 5080 Slim OC, sembra una Founders Edition ma non lo è

PNY RTX 5080 Slim OC, sembra una Founders Edition ma non lo è Wi-Fi 7 con il design di una vetta innevata: ecco il nuovo sistema mesh di Huawei

Wi-Fi 7 con il design di una vetta innevata: ecco il nuovo sistema mesh di Huawei Il dodicesimo lancio del razzo spaziale SpaceX Starship è atteso per aprile, Super Heavy Booster 19 ha completato nuovi test

Il dodicesimo lancio del razzo spaziale SpaceX Starship è atteso per aprile, Super Heavy Booster 19 ha completato nuovi test Blue Origin sta assemblando il secondo lander lunare Blue Moon MK1

Blue Origin sta assemblando il secondo lander lunare Blue Moon MK1 Meta moltiplica gli investimenti in data center IA: le nuove cifre previste dal bilancio sono folli

Meta moltiplica gli investimenti in data center IA: le nuove cifre previste dal bilancio sono folli Addio riflessi fastidiosi? Samsung presenta una nuova pellicola per i display OLED

Addio riflessi fastidiosi? Samsung presenta una nuova pellicola per i display OLED PlayStation 5, doccia fredda da Sony: i prezzi aumentano ancora fino a 899 euro

PlayStation 5, doccia fredda da Sony: i prezzi aumentano ancora fino a 899 euro Super Meat Boy 3D: annunciata la data d'uscita su PC e Xbox Series X/S, manca davvero poco

Super Meat Boy 3D: annunciata la data d'uscita su PC e Xbox Series X/S, manca davvero poco XT View Matrix, il mid-tower Phanteks che punta su estetica e funzionalità moderne

XT View Matrix, il mid-tower Phanteks che punta su estetica e funzionalità moderne David Sacks lascia il ruolo di 'Crypto Czar' alla Casa Bianca mentre le riforme su Bitcoin e stablecoin restano ancora incomplete

David Sacks lascia il ruolo di 'Crypto Czar' alla Casa Bianca mentre le riforme su Bitcoin e stablecoin restano ancora incomplete LG All Stars 2026: quando l'installatore diventa il vero protagonista della transizione

LG All Stars 2026: quando l'installatore diventa il vero protagonista della transizione Addio ad Anna's Archive? Ecco la mossa legale di Spotify che potrebbe chiudere il sito

Addio ad Anna's Archive? Ecco la mossa legale di Spotify che potrebbe chiudere il sito Addio al Mac Pro, Apple mette fine a un progetto che non è mai decollato

Addio al Mac Pro, Apple mette fine a un progetto che non è mai decollato Panasonic a MCE 2026: la rivoluzione silenziosa (e green) passa per i refrigeranti naturali

Panasonic a MCE 2026: la rivoluzione silenziosa (e green) passa per i refrigeranti naturali Netflix alza la posta: il piano Premium verso quota 25 dollari, l'Europa trema

Netflix alza la posta: il piano Premium verso quota 25 dollari, l'Europa trema Nimbus Innovation Awards Cloud Edition 2026: ecco tutti i vincitori

Nimbus Innovation Awards Cloud Edition 2026: ecco tutti i vincitori

0 Commenti

Gli autori dei commenti, e non la redazione, sono responsabili dei contenuti da loro inseriti - infoDevi effettuare il login per poter commentare

Se non sei ancora registrato, puoi farlo attraverso questo form.

Se sei già registrato e loggato nel sito, puoi inserire il tuo commento.

Si tenga presente quanto letto nel regolamento, nel rispetto del "quieto vivere".