|

|||||||

|

|

|

|

|

|

Strumenti |

|

|

#121 | ||||

|

Senior Member

Iscritto dal: Mar 2001

Messaggi: 5390

|

Quote:

Altri miglioramenti prstazionali si avranno in ambiti differenti; ad esempio una miglior gestione della global illumination grazie all'adozione di cube map array (questo porterà anche a vantaggi di tipo qualitativo); un aumento del numero di vertex shader in input e in output (si passerà da 16 a 32 valori a 128 per shader); possibilità di utilizzare blocchi di 2x2 texture al posto di una singola texture con vantaggi qualitativi (nella gestione delle ombre e possibilità di implementare ordini di filtraggio superiori al primo) e velocistici (maggior velocità nel calcolo del procedural noise e incrementi nelle operazioin di stream computing); nuova istruzione per il LoD (possibilità di fare texture filtering di tipo custom con algoritmi di ordine superiore al primo e risultati migliori dal punot di vista qualitativo e maggior velocità nel parallax occlusion mapping). Multi sample buffer read and write e pixel coverage mask (in pratica, il primo permette l'utilizzo di più render target direttamente accessibili dallo shader core e il secondo abilita l'utilizzo di AA di tipo custom); i risultati sono molteplici (da una miglior gestione dell'AA con HDR, alla velocizzazione delle operazioni con adaptive AA, ad una miglior gestione di forme di edge antialiasing di tipo custom con ottimizzazione della banda passante, ad una maggior qualità in alcuni effetti di post processing) Quote:

Complessivamente, si va ben oltre, dal putno di vista prestazionale, rispetto al 24% circa riscontrato con il solo utilizzo di MSAA 4x box filter. Per quanto riguarda la tessellation è scontato che ormai sarà inserita nelle dx11; ma di carne al fuoco ce n'è abbastanza anche con lew 10.1 Quote:

già oggi basta implementare l'utilizzo di MRT per MSAA box filter (e si può fare anche su engine DX9 come l'UE3). Che poi arrivino quando ci saranno già altre vga, magari dx10.1 o, addirittura, dx11, non inficia il fatto che le attuali gpu dx10.1 godranno di benefici, prestazionali e qualitativi, che le attuali gpu dx10 non avranno probabile, però, ripeto, su engone DX9 o misti dx8/dx9 di tipo deferred rendering (stalker e i titoli basati su UE3, ad esempio) è giù implementabile il MRT per color e z-ops; basta quello a fare la differenza Quote:

In quanto a noi e alla nostra presenza sul forum, un paio di anni è un tempo piuttosto lungo per fare previsioni |

||||

|

|

|

|

|

#122 | |

|

Senior Member

Iscritto dal: Mar 2006

Messaggi: 8605

|

Quote:

R500 è essenzialmente una GPU DX9, ma che presenta caratteristiche esclusive delle DX10 e altre che le superano. Molto più avanzata di un G71 castrato che non può nemmeno fare AA con HDR (infatti mi sembra si usino artifici vari per ottenere un risultato simile, facendo partecipare anche il Cell mi pare). che poi la potenza finale sia simile, è tutt'altra cosa.

__________________

Steam Deck OLED 2 TB | Ryzen 7 7700 2x16GB Corsair Dominator Platinum 6400 MHz PowerColor Hellhound RX 7700 XT Trattative OK: 1mp3r4t0r, armenico11, Babumba92, CoolBits, Drigerott, gino1221, k.o.z, Macco, Mastermarcox, Mone_82, stacker, Velvet, Vladimiro Bentovich, frupoli, Sheva77, deg626, HcK190, Godmar, Simonxp, LCol84, pp2k, xeno the holy, SamuTnT, fantacaz |

|

|

|

|

|

|

#123 |

|

Messaggi: n/a

|

vabbè...

cmq a me sembra che anche la ps3 con quel G71 castrato riesca a fare dei giochi graficamente spettacolari e pieni zeppi di effetti... vedi metal gear solid 4, Raket and Clank, uncharted, Killzone 2 ecc... peccato che non sono molti i giochi che la spremono come si deve... ...se sviluppassero + titoli appositamente per l'hw ps3 invece di fare sempre conversioni da xbox360 forse sarebbe meglio. |

|

|

|

#124 | |

|

Senior Member

Iscritto dal: May 2006

Messaggi: 19401

|

Quote:

Non concordo, e niente puo' farmi cambiare idea ora [ma ovviamente capisco e in parte condivido le tue speranze C'è un certo conservatorismo nel mondo dell'informatica con cui anche progetti ambiziosi come quelli di Intel con Larrabee dovranno fare i conti. Da quando è uscita la notizia di Larrabee stavo anche riflettendo sugli scenari futuri possibili (piu' per gioco che per ambizioni divinatorie  ) ) Alla fine per ora abbiamo solo ambizioni, da una parte GPU che vorrebbero fare anche le CPU (ATI e Nvidia) dall'altra CPU che vorrebbero fare GPU (intel con Larrabee) risultati al momento pochi o nulli se escludiamo qualche tech demo scritta appositamente (vedere la fisica di nvidia) le cose potrebbero cambiare come anche no...  Potrebbe (quello che sta avvenendo) essere che ci sara' un' invasione di campo da parte di un po' tutti ma credo che alla fine le cose non cambieranno poi molto e che salvo imprevisti, che nessuno si augura, tutte e tre (4, se consideriamo ATI ancora entita' separata) queste aziende continuino a fare quello che fanno oggi. Bon, la mia previsione l'ho fatta...sotto con le scomesse!!! |

|

|

|

|

|

|

#125 | ||

|

Senior Member

Iscritto dal: Oct 2005

Messaggi: 38298

|

Quote:

Quote:

__________________

Corsair 5000D - Ryzen 7 7700 - Asrock B650E PG - 2x16gb G.Skill Trident Z5 ddr5 6000 mhz - GeForce Rtx 4070Ti S. - Samsung 980 pro 1tb + Crucial mx500 1tb + WD 1tb - Corsair rm850w - LG oled C4 48 le vga che ho avuto Ultima modifica di appleroof : 07-08-2008 alle 19:33. |

||

|

|

|

|

|

#126 | |

|

Senior Member

Iscritto dal: May 2006

Messaggi: 19401

|

Quote:

che pero' non si aggiornano che pero' non si aggiornano Puo' essere (anzi con la fortuna che mi ritrovo perderei sicuro  ), magari fra 5 anni Nvidia si da ai Gelati o ai Phon e AMD alla conquista spaziale... ), magari fra 5 anni Nvidia si da ai Gelati o ai Phon e AMD alla conquista spaziale...

|

|

|

|

|

|

|

#127 | |

|

Senior Member

Iscritto dal: Oct 2005

Messaggi: 38298

|

Quote:

__________________

Corsair 5000D - Ryzen 7 7700 - Asrock B650E PG - 2x16gb G.Skill Trident Z5 ddr5 6000 mhz - GeForce Rtx 4070Ti S. - Samsung 980 pro 1tb + Crucial mx500 1tb + WD 1tb - Corsair rm850w - LG oled C4 48 le vga che ho avuto |

|

|

|

|

|

|

#128 | |||

|

Senior Member

Iscritto dal: Mar 2001

Messaggi: 5390

|

Quote:

Quote:

Quote:

Ultima modifica di yossarian : 07-08-2008 alle 20:30. |

|||

|

|

|

|

|

#129 | |||

|

Senior Member

Iscritto dal: May 2006

Messaggi: 19401

|

Quote:

La tua è (come di chi ha o avra' [non escludendo il sottoscritto] una scheda AMD/ATI) speranza che lo facciano, non hai la certezza per ora, io invece ho la certezza che fin'ora non l'hanno fatto (salvo AC ecc..ecc..)...quindi sei tu che speri...Del doman non c'è certezza  Quote:

poi con le dx11 vedremo... Quote:

Ultima modifica di Kharonte85 : 07-08-2008 alle 20:25. |

|||

|

|

|

|

|

#130 | |

|

Senior Member

Iscritto dal: Oct 2005

Messaggi: 38298

|

Quote:

__________________

Corsair 5000D - Ryzen 7 7700 - Asrock B650E PG - 2x16gb G.Skill Trident Z5 ddr5 6000 mhz - GeForce Rtx 4070Ti S. - Samsung 980 pro 1tb + Crucial mx500 1tb + WD 1tb - Corsair rm850w - LG oled C4 48 le vga che ho avuto |

|

|

|

|

|

|

#131 | |

|

Senior Member

Iscritto dal: Mar 2001

Messaggi: 5390

|

Quote:

credo che il tutto nasca da un fraintendimento di cui mi assumo tutte le responsabilità. Quando si ha un motore che fa deferred rendering (in realtà sia quello di stalker che l'ue3 fanno solo deferred lightning, ma all'atto pratico non cambia nulla), si ha il problema di rendere fruibili i risultatii contenuti nello z-buffer per le successive operazioni (sono quei risultati su cui si applica il MSAA box filter). L'HW dx9 è impossibilitato a farlo, poichè non può salvarli da nessun'altra parte che non sia lo z-buffer stesso e questi dati vengono sovrascritti (e quindi resi inutilizzabili) quando si procede alle operazioni di color e alpha blending. Con l'HW dx10 è possibile salvare questi risultati su una texture e riutilizzare lo z-buffer per le color ops. Questo però comporta una maggior occupazione di bandwidth e tutta una serie di operazioni in più (ogni volta che serovno i dati si deve effettuare un'operazioni di texture fetch). La terza soluzione è quella che permette di utilizzare 2 diversi render target per z-ops e color ops, entrambi accessibili in ogni momento e, se necessario, contemporaneamente. Ogni render target ha le sue modalità di blending (altro problema da superare in caso di render to texture, poichè per le z-ops e per il MSAA box filter si usa INT8, mentre per le color ops fp32). Quest'ultima è la soluzione possibile con HW dx10.1 (o dx11). Per questo motivo ho la certezza che si farà uso (e anche piuttosto presto) di MRT. Finora non si sono visti titoli dx10 ma solo titoli dx8/9 con qualche feature simil-dx10 appiccicata qua o là. Nel momento in cui si inizierà a far uso di deferred rendering e MSAA, l'implementazione della soluzione che fa uso di MRT è non solo la migliore ma anche la più probabile. I motori grafici, finora nascono su HW che non può gestire illuminazione dinamica (di tipo deferred) e MSAA. Adesso c'è HW in grado di gestire le due cose con modalità differenti e non è difficile implementarle entrambe. Tra l'altro, potrei sbagliarmi, ma credo che lì'utilizzo di MRT su un engine in cui è previsto l'uso di render to texture, potrebbe essere fatta anche via driver senza tanti sbattimenti (probabilmenyte, ma non ci metto la mano sul fuoco, non essendo un programmatore) è sufficiente sostituire una chiamata di tipo render to texture con una di tipo render to target |

|

|

|

|

|

|

#132 | ||

|

Senior Member

Iscritto dal: May 2006

Messaggi: 19401

|

Quote:

... ...Ma poi non capisco dove sia il problema male che vada appunto si compra ATI se diventa una cosa cosi' fondamentale Quote:

Ma che te voi scusa' e chessaramai  stay relaxed stay relaxed Comunque ho capito cosa intendi, ormai aspettiamo e vediamo (anche perche' siamo un po' OT |

||

|

|

|

|

|

#133 | |

|

Senior Member

Iscritto dal: Oct 2005

Messaggi: 38298

|

Quote:

__________________

Corsair 5000D - Ryzen 7 7700 - Asrock B650E PG - 2x16gb G.Skill Trident Z5 ddr5 6000 mhz - GeForce Rtx 4070Ti S. - Samsung 980 pro 1tb + Crucial mx500 1tb + WD 1tb - Corsair rm850w - LG oled C4 48 le vga che ho avuto |

|

|

|

|

|

|

#134 | |

|

Senior Member

Iscritto dal: Jan 2001

Messaggi: 9098

|

Quote:

. .

__________________

26/07/2003 |

|

|

|

|

|

|

#135 |

|

Senior Member

Iscritto dal: Jul 2005

Messaggi: 7819

|

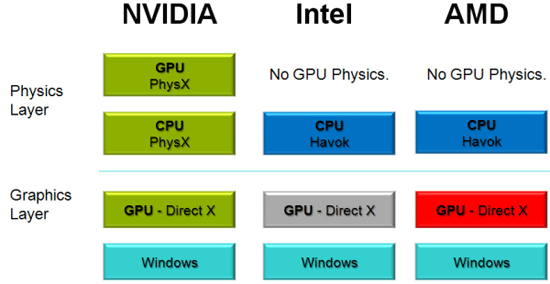

Microsoft game studios va con Havok definitivamente quindi Physx di nVidia sarebbe tagliata fuori dai giochi per quel che riguarda Microsoft: http://www.gamerchip.com/can-the-hav...box-exclusive/

E a questo punto immagino che Microsoft sia più favorevole a favorire Havok anche per le DX11 qualche info sull DX11: http://www.realtimerendering.com/blo...-part-i-intro/ http://www.realtimerendering.com/blo...-tessellation/ e qualche pdf di nVidia: http://news.developer.nvidia.com/200...st-presen.html

__________________

Sample is selezionated !

|

|

|

|

|

|

#136 | |

|

Senior Member

Iscritto dal: Jan 2001

Messaggi: 9098

|

Quote:

Scherzi a parte era quantomeno OVVIO che finisse cosi' e se non ricordo male lo avevamo ipotizzato gia' un casino di tempo fa. Microsoft comanda e comanda cio' che a lei commercialmente conviene.

__________________

26/07/2003 |

|

|

|

|

|

|

#137 |

|

Senior Member

Iscritto dal: Oct 2005

Messaggi: 38298

|

Brutto colpo per i verdi, Microsoft ha siglato un accordo di licenza per la fisica nei propri giochi con Havok. L’accordo mette tutti i prodotti Havock, Physics, Animation e Behaviour disponibili negli studio interni a Microsoft e a tutti i suoi partner internazionali. Intel e AMD ringraziano.

Fra i titoli Microsoft in fase di sviluppo che usano Havok troviamo Fable 2, Halo Wars e Banjo Kazooie: Nuts and Bolts. Microsoft usa prodotti Havok dal 2001e il motore di fisica è stato inserito in tanti titoli Microsoft come Halo 3, Halo 2 e Age of Empires III. http://www.theinquirer.it/2008/08/07...ena-havok.html ricollegandoci ai discorsi che facevamo su questo stesso tread, non so Amd, ma Intel ringrazia davvero (soldi ben spesi)  Azz, ho trovato questa notizia vecchissima: http://www.hwupgrade.it/news/videogi...ine_19555.html altro che novità inoltre, Nvidia in passato aveva già collaborato strettamente per far girare havock fx sulle sue vga http://www.nvidia.it/object/IO_30500.html a voi i commenti....

__________________

Corsair 5000D - Ryzen 7 7700 - Asrock B650E PG - 2x16gb G.Skill Trident Z5 ddr5 6000 mhz - GeForce Rtx 4070Ti S. - Samsung 980 pro 1tb + Crucial mx500 1tb + WD 1tb - Corsair rm850w - LG oled C4 48 le vga che ho avuto Ultima modifica di appleroof : 08-08-2008 alle 09:52. |

|

|

|

|

|

#138 | |

|

Bannato

Iscritto dal: Jun 2007

Messaggi: 1186

|

Quote:

|

|

|

|

|

|

|

#139 |

|

Senior Member

Iscritto dal: May 2006

Messaggi: 19401

|

Era palese che Microsoft scegliesse la via piu' semplice, infatti fino ad oggi l'uso dell' Havok non è mai stato legato alle GPU ma solo alle CPU (AMD ha partecipato soprattutto per questo motivo secondo me) e quindi ha avuto da sempre più mercato (rispetto alle alternative: o niente fisica o PPU AGEIA dedicata)

La fisica proposta da nvidia invece è di tutt'altro livello (e i primi test condotti sembrano mostrare risultati migliori di quanto pensassi) tutto dipenderà da quanti produttori di giochi saranno disponibili a impegnarsi per supportarla seriamente...nvidia dovrà spingere soprattutto sulla prossima console Sony se vuole ottenere dei risultati in futuro... @appleroof: prima dell'acquisizione da parte di Intel, havok aveva sviluppato dei tool ,chiamati proprio havok FX, sia per schede nvidia che ATI, poi tutto è finito in fumo... Ultima modifica di Kharonte85 : 08-08-2008 alle 12:02. |

|

|

|

|

|

#140 | ||

|

Senior Member

Iscritto dal: Oct 2005

Messaggi: 38298

|

Quote:

Quote:

p.s.: ricordo havock fx, l'ho riportato perchè secondo me nulla vieta che esso possa essere implementato su schede Nvidia (come physx su Ati), dipende tutto dai citati giochi di potere...

__________________

Corsair 5000D - Ryzen 7 7700 - Asrock B650E PG - 2x16gb G.Skill Trident Z5 ddr5 6000 mhz - GeForce Rtx 4070Ti S. - Samsung 980 pro 1tb + Crucial mx500 1tb + WD 1tb - Corsair rm850w - LG oled C4 48 le vga che ho avuto |

||

|

|

|

|

| Strumenti | |

|

|

Tutti gli orari sono GMT +1. Ora sono le: 18:06.