GPU in ogni dove, anche nella memoria: il piano segreto di NVIDIA

Meta, NVIDIA e i principali produttori di memoria starebbero valutando una nuova tipologia di HBM con logica GPU integrata nel die di base, una soluzione che punta a ridurre i trasferimenti di dati e migliorare l'efficienza per i carichi AI

di Vittorio Rienzo pubblicata il 27 Novembre 2025, alle 12:10 nel canale MemorieNVIDIAAMDHBMSamsungSK hynix

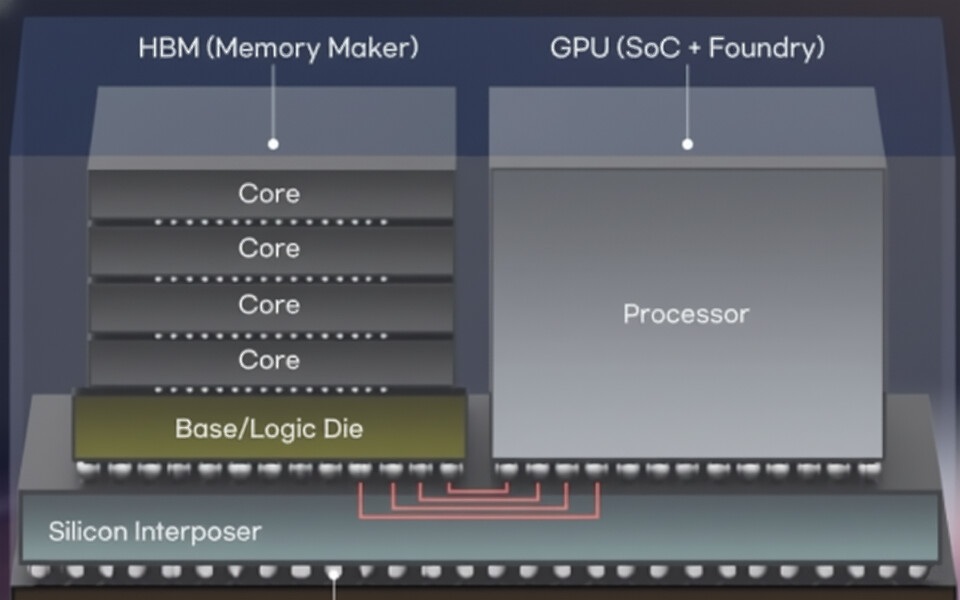

Secondo quanto riportato dalla testata coreana ET News, Meta, NVIDIA, SK Hynix e Samsung starebbero collaborando allo sviluppo di una nuova generazione di HBM (High Bandwidth Memory) capace di integrare i core GPU direttamente nel die di base della memoria.

La futura HBM4, la cui produzione è prevista per l'anno prossimo, integrerà un controller interno per ridurre la distanza tra logica e memoria e ottimizzare così consumi e prestazioni. L'inserimento di porzioni di GPU nel base die rappresenterebbe un ulteriore passo in questa direzione, con l'obiettivo di migliorare ulteriormente l'efficienza e velocizzare le operazioni nei carichi AI più intensi.

Tuttavia, ci sarebbero diversi limiti fisici non trascurabili: lo spazio disponibile sul die, le capacità di alimentazione per la GPU e, soprattutto, il raffreddamento dei chip. In sostanza, l'integrazione nel die della memoria non esclude le sfide che già adesso i fornitori devono affrontare con i chip tradizionali.

"La velocità della transizione tecnologica, in cui il confine tra memoria e semiconduttori di sistema si riduce a favore del progresso dell'intelligenza artificiale, accelererà" ha spiegato Kim-Joung-ho, professore presso la Facoltà di Ingegneria del KAIST (Korea Advanced Institute of Science and Technology). "Le aziende nazionali devono espandere il proprio ecosistema oltre la memoria, inserendosi nel settore della logica per anticipare il mercato HBM di prossima generazione".

Parallelamente, i primi prodotti di fascia altissima mostrano quanto la banda di memoria continui a essere un elemento centrale. La nuova GPU AMD Instinct MI430X, basata sull'architettura CDNA di prossima generazione, utilizza 432 GB di HBM4 e raggiunge una banda di 19.6 TB/s, valori pensati per addestramento e inferenza AI su larga scala.

NVIDIA ha scelto una strada differente con la piattaforma Vera Rubin Superchip: ogni GPU Rubin integra due chiplet compute dalla grandezza di un reticolo abbinati a otto stack HBM4, per un totale di circa 288 GB di HBM4 per GPU e 576 GB sull'intero Superchip. Una configurazione sviluppata per massimizzare la scalabilità dei sistemi multi-GPU ad alta densità.

Integrare i core di elaborazione direttamente nella memoria rappresenta quindi una sfida decisamente ambiziosa e appannaggio esclusivamente di quelle aziende che dispongono di avanzate capacità di packaging. Allo stesso tempo, però, rappresenterebbe un enorme passo avanti per massimizzare le capacità di elaborazione IA.

PNY RTX 5080 Slim OC, sembra una Founders Edition ma non lo è

PNY RTX 5080 Slim OC, sembra una Founders Edition ma non lo è Wi-Fi 7 con il design di una vetta innevata: ecco il nuovo sistema mesh di Huawei

Wi-Fi 7 con il design di una vetta innevata: ecco il nuovo sistema mesh di Huawei Core Ultra 7 270K Plus e Core Ultra 7 250K Plus: Intel cerca il riscatto ma ci riesce in parte

Core Ultra 7 270K Plus e Core Ultra 7 250K Plus: Intel cerca il riscatto ma ci riesce in parte L'AI agentica potrebbe trasformare Internet: il settore della pubblicità online è a rischio?

L'AI agentica potrebbe trasformare Internet: il settore della pubblicità online è a rischio? Qualcomm lancerà due chip per smartphone Android a 2 nm nel 2026: ecco le possibili differenze

Qualcomm lancerà due chip per smartphone Android a 2 nm nel 2026: ecco le possibili differenze_160.jpg) Xiaomi dà i numeri: ecco come è andato il 2025 dell'azienda tra smartphone, tablet, accessori e auto elettriche

Xiaomi dà i numeri: ecco come è andato il 2025 dell'azienda tra smartphone, tablet, accessori e auto elettriche AMD annuncia Ryzen 9 9950X3D2 Dual Edition: primo Zen 5 con doppio 3D V-Cache e TDP a 200W

AMD annuncia Ryzen 9 9950X3D2 Dual Edition: primo Zen 5 con doppio 3D V-Cache e TDP a 200W CyrusOne avvia la costruzione del suo primo data center in Italia, a Milano

CyrusOne avvia la costruzione del suo primo data center in Italia, a Milano Cloud in crescita, ma ladozione dellIA resta lenta. Lidentikit delle PMI italiane secondo Wolters Kluwer Italia

Cloud in crescita, ma ladozione dellIA resta lenta. Lidentikit delle PMI italiane secondo Wolters Kluwer Italia OpenAI cancella l'adult mode di ChatGPT: il riassetto strategico miete un'altra vittima

OpenAI cancella l'adult mode di ChatGPT: il riassetto strategico miete un'altra vittima Google Search Live arriva in Italia: la ricerca ora ci vede e ci parla

Google Search Live arriva in Italia: la ricerca ora ci vede e ci parla MacBook Air 15'' con chip M4 (2025) crolla su Amazon: il prezzo che stavamo cercando è finalmente realtà

MacBook Air 15'' con chip M4 (2025) crolla su Amazon: il prezzo che stavamo cercando è finalmente realtà Ora è possibile trasferire file tra Samsung e Apple con AirDrop e Quick Share. Ecco come fare

Ora è possibile trasferire file tra Samsung e Apple con AirDrop e Quick Share. Ecco come fare Apple domina con il MacBook Neo: i laptop Windows faticano a tenere il passo

Apple domina con il MacBook Neo: i laptop Windows faticano a tenere il passo Arriva la nuova gamma di PC Dell Pro per utenti aziendali: nuovi notebook, desktop e workstation portatili

Arriva la nuova gamma di PC Dell Pro per utenti aziendali: nuovi notebook, desktop e workstation portatili DJI Avata 360: la recensione del primo drone FPV 8K con sensori da 1 pollice

DJI Avata 360: la recensione del primo drone FPV 8K con sensori da 1 pollice Il browser di Samsung arriva su Windows, ma in Italia non c'è l'IA agentica

Il browser di Samsung arriva su Windows, ma in Italia non c'è l'IA agentica

0 Commenti

Gli autori dei commenti, e non la redazione, sono responsabili dei contenuti da loro inseriti - infoDevi effettuare il login per poter commentare

Se non sei ancora registrato, puoi farlo attraverso questo form.

Se sei già registrato e loggato nel sito, puoi inserire il tuo commento.

Si tenga presente quanto letto nel regolamento, nel rispetto del "quieto vivere".