|

|||||||

|

|

|

|

|

|

Strumenti |

|

|

#41 |

|

Senior Member

Iscritto dal: Dec 2001

Città: Trento

Messaggi: 3330

|

l 85 1.2 spacca non ce che dire su ff non per il diaframma ma per i colori e la sua resa particolare microcontrasto bello sfocato etc... (ho la versione II)

pero è specialistico non me lo sono nemmeno portato in america (preferendo il 135f2 ben più pratico e adatto a molte situazioni anche "veloci") si secondo me è quello perché anche con ottiche adattate su ff zeiss e leica a volte faceva così! misurando a zona totale visto che le grandi aperture vignettano la macchina facendo la media della scena fa la media della "parte più scura data dalla vignettatura".... magari dai un occhiata al mio sito di foto ... |

|

|

|

|

|

#42 | |

|

Senior Member

Iscritto dal: Mar 2001

Messaggi: 5373

|

Quote:

Ultima modifica di yossarian : 13-12-2011 alle 19:09. |

|

|

|

|

|

|

#43 |

|

Senior Member

Iscritto dal: May 2006

Messaggi: 4389

|

Se hai intenzione di passare al full frame allora 135 f2, se invece rimarrai su aps-c probabilmente ti consiglierei il 50

|

|

|

|

|

|

#44 | |

|

Senior Member

Iscritto dal: Dec 2001

Città: Trento

Messaggi: 3330

|

Quote:

l 85 solo se fai ritratti e ti esalta e hai già le altre due focali! ps io ho 24 2.8, 50 1.4, 85 1.2 mk2, 135 f2 il 50 lo trovo insostituibile come il 135... http://www.photo4u.it/album_pic.php?pic_id=556635 si vede? 135 a f2 Ultima modifica di Donagh : 13-12-2011 alle 19:42. |

|

|

|

|

|

|

#45 | ||

|

Senior Member

Iscritto dal: Mar 2001

Messaggi: 5373

|

Quote:

Quote:

Grazie per i consigli |

||

|

|

|

|

|

#46 | |||

|

Bannato

Iscritto dal: Aug 2006

Città: Parma

Messaggi: 2579

|

Allora a me il discorso sembra molto chiaro e prego di leggere bene proprio perché capisco possa non essere banale per chiunque.

A me con una preparazione di tipo fisico mi pare sensato come ragionamento teorico, d'altra parte per come è messa però dovrebbero mettersi a fare le misurazioni in una maniera controllata per validare l'ipotesi del fenomeno. Ma non mi sembra che ci sia interesse né da parte di DxO che ha lanciato la pietra e nascosto la mano, né ovviamente dai tecnici stessi che probabilmente nemmeno si sognano possa esistere un dibattito del genere fra gli utenti e in ogni caso è difficile una comunicazione diretta. A me con una preparazione di tipo fisico mi pare sensato come ragionamento teorico, d'altra parte per come è messa però dovrebbero mettersi a fare le misurazioni in una maniera controllata per validare l'ipotesi del fenomeno. Ma non mi sembra che ci sia interesse né da parte di DxO che ha lanciato la pietra e nascosto la mano, né ovviamente dai tecnici stessi che probabilmente nemmeno si sognano possa esistere un dibattito del genere fra gli utenti e in ogni caso è difficile una comunicazione diretta.Se posso permettermi, non vorrei risultare pedante, Quote:

Quote:

Quote:

Poi c'è l'ipotesi del fenomeno che sono il primo a dire di essere scettico e che può essere opinata o meno purché argomentando se la si è compresa, ma finora è quella più verosimile dal punto di vista fisico, IMHO. Imputare lo scostamento a un difetto di trasmissione non è compatibile, per le ragioni che ho provato a spiegare e di cui ti puoi assicurare anche tu se sei abbastanza curioso da andare a leggerti dei fenomeni di riflessione/rifrazione. So perfettamente che l'ipotesi di spiegazione del fenomeno può risultare poco chiara (deve essere chiaro che è un problema di ciò che sta davanti al sensore come ottica cioé lente e microlente-struttura del pixel non di sensibilità del fotosito) ai più e se serve, appena ho un attimo, provo a cercare di spiegare il concetto in maniera più comprensibile, spero almeno perché non mi ritengo per nulla un divulgatore.

|

|||

|

|

|

|

|

#47 | |||

|

Senior Member

Iscritto dal: Mar 2001

Messaggi: 5373

|

Quote:

Questa è la definizione generale di guida d'onda che è semplicemente un mezzo per guidare un'onda o una serie di onde EM da un punto ad un altro, costringendole a seguire un percorso obbligato anzichè uno libero. Una fibra ottica è un tipo di guida d'onda che si usa per trasferire onde EM a una o più frequenze diverse, ma anche un obiettivo è una guida d'onda che, ovviamente, non facendo uso di una trasmittente laser, non trasferisce una radiazione di tipo coerente. Di fatto una guida d'onda non serve per creare un'immagine ma neppure per trasmettere un suono, ma solo per trasportare onde EM; quello che si fa con queste onde dipende solo ed esclusivamnete da cosa si usa come trasmettitore e come ricevitore. Se uso una sorgente luminosa come trasmettitore (o, meglio, il riflesso delle onde EM emesse da questa sorgente luminosa su un altro corpo) e una pellicola fotografica o una matrice di fotodiodi abbinati ad un filtro di tipo bayer o ad una struttura multilayer, tipo foveon e "costringo" questa radiazione a passare all'interno di un percorso obbligato che la guidi verso la struttura preposta a riceverla, non faccio altro che utilizzare una guida d'onda e il risultato che otterrò è una immagine. SE lavoro nel campo delle microonde, la guida d'onda sarà di tipo metallico, in quello delle ottiche posso utilizzare una fibra ottica o qualunque cosa permetta di indirizzare le onde E.M. lungo un percorso prestabilito, per mezzo di pareti riflettenti (a frequenze ottiche anche una parete a specchio può assolvere lo stesso compito di una fibra ottica; dipende solo dal tipo e dalla quantità di luce che devo farci passare dentro). Quote:

Quote:

Probabilmente non ci arrivo, ma continuo a non vederci niente di strano, anzi ritengo probabile che un'operazione del genere avvenga anche con ottiche meno "veloci", in condizioni di scarsa luce. Ultima modifica di yossarian : 15-12-2011 alle 00:22. |

|||

|

|

|

|

|

#48 | |

|

Bannato

Iscritto dal: Aug 2006

Città: Parma

Messaggi: 2579

|

Guarda non per continuare a voler fare botta/risposta che sono pure argomenti abbastanza ampi ed è difficili esaurirli con 4 parole riassunte: non so come te l'abbiano spiegata, ma fidati hai un po' le idee confuse su cosa sia una guida d'onda e anche sull'ottica stai facendo strafalcioni (le aberrazioni te lo ripeto NON sono dovute a fenomeni d'interferenza!).

Se vuoi capire meglio, cerca di approfondirne il funzionamento e fai MOLTO caso su quali principi si basa la trasmissione di una radiazione (in linea di massima monocromatica e coerente fra l'altro e questo già dovrebbe farti venire parecchi dubbi col tuo paragone lente/guida d'onda) all'interno di una fibra ottica (fenomeno di riflessione totale), e invece cosa voglia dire focalizzare un'immagine (non c'è nessun confinamento, anzi in ottica fisica si considerano i diversi cammini ottici) che è quanto fa una lente a partire da luce incoerente e non monocromatica (quindi cosa ci faresti, seppure ben avessi informazioni sulla fase..  ). ).Quote:

Penso tu abbia equivocato, provo a spiegarmi. Penso tu abbia equivocato, provo a spiegarmi.Come hai detto la Qe è un parametro del dispositivo che indica solo l'efficienza del processo di conversione. Ai fini dell'esposizione non te ne frega niente se hai un fotosito buono o pessimo (semmai te ne accorgerai nell'immagine in termini di rumore) ci pensa l'hardware e il software a rinormalizzare il tutto per fornire all'utente un riferimento che è poi il valore di sensibilità in ISO. Provo a renderlo comprensibile: se il tuo fotosito è molto efficiente avrai molto meno bisogno di AMPLIFICARE il segnale per definire un certo valore di sensibilità ISO rispetto a un fotosito poco efficiente (con tutto ciò che ne consegue nel peggioramento dell'SNR; in parole povere e semplificate: il primo sensore partirà con un ISO base più alto e potrà spingersi più avanti a parità di "amplificazione elettronica" rispetto al secondo). Ma questa è una cosa "a basso livello" di cui all'interfaccia software non gliene può fregar di meno, perché lavora già col parametro ISO; te fai lo stesso discorso quindi non diciamo cose molte diverse,  ). Che le FF abbiano migliore Qe delle APS (oppure estendilo pure ai casi di sensori migliori rispetto ai più vecchi) risulterà semplicemente come sappiamo nel rumore delle immagini a parità di ISO. Quindi il discorso che fai non ti torna perché pensi che il gain del grafico che ho riportato sia "a basso livello", mentre in realtà è già riparametrato perché ragiona in termini di ISO. ). Che le FF abbiano migliore Qe delle APS (oppure estendilo pure ai casi di sensori migliori rispetto ai più vecchi) risulterà semplicemente come sappiamo nel rumore delle immagini a parità di ISO. Quindi il discorso che fai non ti torna perché pensi che il gain del grafico che ho riportato sia "a basso livello", mentre in realtà è già riparametrato perché ragiona in termini di ISO.Per i grafici prima di DxO le differenze fra fotocamere diverse, per come è spiegata, si suppongono considerando che a seconda della tecnologia del sensore e delle microlenti, si ha una limitazione nell'apertura numerica del pixel che può essere diversa e che quindi limita diversamente il sistema ottico a monte. Quindi penso siano corrette le tue considerazioni sulla dimensione dei pixel e l'incidenza del fenomeno. Se non è chiaro lo ripeto, il fenomeno è il seguente: scatto a f/8 e l'esposimetro dà una certa coppia (ISO 100 e tempo che so 1/10s), poi misuro a f/2,8 e l'eposimetro dà una coppia con la proporzione prevista cioè 3-stop in meno (ISO 100 e tempo 1/80s), infine misuro a f/1,2 e l'esposimetro mi trova una coppia inferiore alla proporzione prevista cioé invece di 2,5-stop mi salta fuori 1-stop in meno del previsto. A questo punto la fotocamera dovrebbe impostare un tempo 1/225s, invece per far tornare i conti alza l'ISO a 200 FACENDOMI CREDERE CHE SIA ANCORA A 100 per poter darmi il tempo previsto di 1/450s e mascherare la perdita di uno stop a f/1.2 (NON PUO' ESSERE un problema di trasmissione, cioè T-number perché altrimenti la perdita sarebbe una caduta costante a tutti i diaframmi e te ne accorgeresti solo confrontando le coppie misurate con un'altra lente avente trasmissione migliore/peggiore). Dato che l'eposimetro di norma con le lenti moderne fa la misura una volta sola a TA e poi si calcola le coppie per l'apertura a seconda di cosa imposta l'utente, può barare solo quando sa che il diaframma avrà un valore critico (cioé a quanto risulta da f/2 in su). Quindi se usi una lente senza contatti e il diaframma lo imposti manualmente, lo smascheri perché è costretto a fare la misura di volta in volta dato che non sa quale diaframma hai impostato. |

|

|

|

|

|

|

#49 | ||||

|

Senior Member

Iscritto dal: Mar 2001

Messaggi: 5373

|

Quote:

Quote:

Per quanto interessanti, non credo che siano questi gli argomenti della discussione, però. Quote:

Se uso una lente più luminosa, il firmware della macchina aumenta l'amplificazione per compensare le perdite ai bordi del frame. Supponiamo che la perdita sia del 30%, per uniformità con la situazione precedente. La differenza sta solo nel fatto che nel primo caso, secondo dxomark, gli iso sono 100 e nel secondo sono 130. Questo non significa che nel secondo caso il produttore sta barando, ma semplicemente che nel primo caso ha operato in modo tale da compensare una perdita facilmente quantificabile perchè insita nell'architettura hardware della macchina e, in particolare, nella tipologia di specchio adottato. Nel secondo caso non è in grado di fare lo stesso, perchè la "caduta di luce" dipende dal tipo di ottica di ottica e dall'apertura usata. Quindi non è cosa connaturata alla macchina ma dipende da un elemento aggiuntivo che si può usare o no. Nel momento in cui imposti una lente veloce a TA, la macchina "legge" la quantità di luce media e la confronta con il valore di target impostato. Se il valore rilevato è più basso aumenta l'amplificazione di quel tanto necessario a riportarlo al valore stabilito. Se l'ottica "comunica" con la cpu, allora il mascheramento è semplice, alla stregua di quanto avviene con lo specchio SLT; se si usa un'ottica che non comunica con la cpu, allora la compensazione avviene lo stesso, ma il "trucco" viene scoperto. Quote:

Come si vede dalle immagini dei test sulle ottiche e come detto da alcuni utenti che partecipano a questa discussione, passando da un'ottica f/1.2 ad una f/1.4 o f/1.8, cambia lo sfocato, quindi, da questo punto di vista, la differenza c'è. Ovviamente, con ottiche più aperte c'è anche una fisiologica maggior diminuzione della luce soprattutto sui bordi del frame ed è questo che l'aumento degli ISO va a compensare. |

||||

|

|

|

|

|

#50 |

|

Senior Member

Iscritto dal: Dec 2001

Città: Trento

Messaggi: 3330

|

f 1.2.... spero le vedete....  1.4... |

|

|

|

|

|

#51 | ||||

|

Bannato

Iscritto dal: Aug 2006

Città: Parma

Messaggi: 2579

|

Quote:

Riguardo al dopo, anch'io non vorrei continuare a scrivere solo tanto per farlo visto che risulta poco costruttivo e mi sembra di saltare di palo in frasca. In ogni caso per intenderci già quando parli di "finestra" mi verrebbe da riprenderti sul fatto che un laser che non sia monocromatico e coerente non è un laser per definizione. Il fatto che si possano regolare diverse frequenze di emissione non toglie che selezionatane una si abbia qualcosa di monodisperso (ciò vale tanto sia per un He-Ne da laboratorio, sia per un diodo laser da lettore CD, sia per il FEL che sei andato a pescare), ripeterò ancora in linea di massima, Quote:

dove si accenna che le microlenti funzionano entro certi vincoli e che la corsa ai Mpx acuisce il problema; se hai accesso alle pubblicazioni scientifiche nella biografia trovi anche materiale molto più avanzato, se hai bisogno mp dove si accenna che le microlenti funzionano entro certi vincoli e che la corsa ai Mpx acuisce il problema; se hai accesso alle pubblicazioni scientifiche nella biografia trovi anche materiale molto più avanzato, se hai bisogno mp Quote:

Personalmente ci andrei molto cauto nel proclamare considerazioni sullo sfocato a sentimento, puoi rileggerti la prima pagina d'interventi qui per intuire perché, resta il fatto che se il fenomeno fosse quello ipotizzato INFLUIREBBE pure sulla PdC. Misurazioni su questo aspetto NON SONO STATE FATTE e non le ritengo alla portata del modo di operare dell'utente comune. Ovviamente se si vogliono fare Quote:

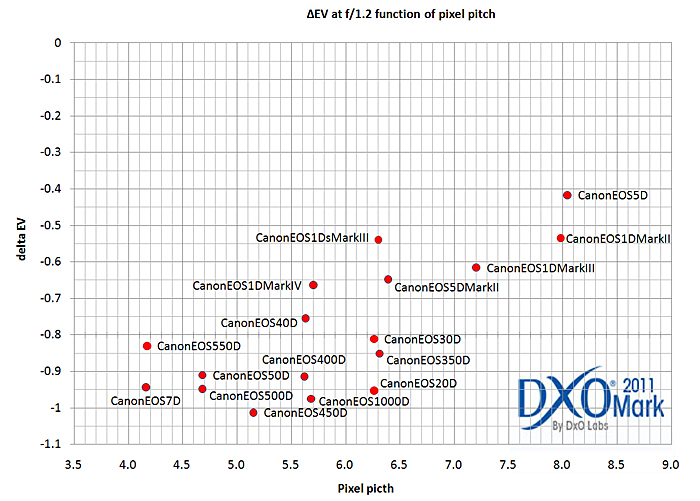

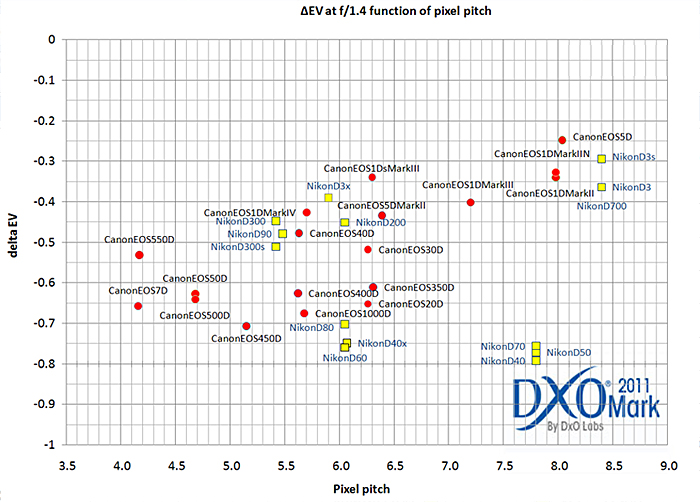

*La vignettatura come aberrazione assiale cala la trasmissione dal centro con la potenza quarta del coseno dell'angolo, certo si aggiunge il discorso del fuori asse della microlente come fai notare ma comunque siamo lì considerati i profili di vignettatura che si misurano. C'è un'altra considerazione: soprattutto a parità di lente, se dipendesse dalla vignettatura (fisiologica+offset) ne avresti la conferma qualora il dato dei sensori FF fosse molto peggiore di quello degli APS, invece è proprio l'esatto contrario! Detto ciò mi sentirei di confutare questa ipotesi come causa predominante, visto il grafico sottostante di DxO.  Ora non che a me piaccia difendere questa teoria dell'apertura limitata dal pixel, ma a parte l'essere molto più verosimile di altre possibili spiegazioni, se nell'ambiente è conosciuto come problema noto (anche qui a parte DxO, c'è l'articolo della Stanford già citato e cercando come ti ho detto trovi approfondimenti benché non alla portata di tutti) e si trova che nelle pubblicazioni scientifiche non vi sono remore nel considerare il fenomeno, ma anzi sembra se ne tenga conto perfino per sviluppi futuri, non vedo il senso di "voltarsi da un'altra parte"...  Perdona Donagh ma a parte i bei ritratti

|

||||

|

|

|

|

|

#52 | |||||||

|

Senior Member

Iscritto dal: Mar 2001

Messaggi: 5373

|

chiudo la parentesi sui fibre ottiche e affini con una precisazione: nel post precedente ho citato di proposito i laser He-Ne perchè sono tra quelli con "finestra" di trasmissione più stretta ma, nonostante ciò, sempre di finestra si tratta. I diodi laser hanno finestre decisamente più ampie e i led, usati n accoppiamento con fibre multimodo, non sono né coerenti né monocromatici. Infine, una nota sulle aberrazioni; vengono spiegate con l'ottica geometrica solo in prima approssimazione, ma sono originate da fenomeni che non non rientrano nelle approssimazioni tipiche dell'ottica geometrica (che tratta solo le aberrazioni di Seidel). In quanto a fenomeni di interferenze "visibili", mi limito a citarne solo 2: gli effetti della diffrazione e il moire (me, se preferisci, l'aliasing più in generale).

Quote:

Quote:

Quote:

In ogni caso, il fatto stesso che ci progettino microlenti e che ci si dia tanto da fare per migliorarne l'efficienza, dimostra che il problema esiste, è riconosciuto e si cerca di ridurne l'incidenza. Ovviamente, la diminuzione delle dimensioni dei pixel rende il tutto più difficile, perchè il tunnel attraverso cui si deve guidare la radiazione diventa più stretto ma i risultati rilevati sperimentalmente dimostrano che cmos FSI da 16 o 18 Mpixel di oggi si comportano meglio di ccd da 6 o 10 Mpixel di 5 o 6 anni fa. Quote:

Quote:

Quote:

Quote:

Per come la vedo, l'unica cosa che è cambiata, rispetto al passato, ovvero all'uso dell'analogico o dei sensori ccd di qualche anno fa, è che adesso ci si è resi conto del fenomeno solo perchè ci sono strumenti che hanno permesso di fare analisi più approfondite rispetto al passato anche ai non addetti ai lavori. Per il resto, mettere in un unico calderone i risultati di dxomark (che, ripeto, dicono, eventualmente, solo di quanto la fotocamera corregge ma non danno indicazioni sulla reale caduta di luce su quel sensore), un articolo di Stanford che parla dei problemi connessi allo scaling geometrico dei pixel, i problemi di accoppiamento lente-sensore e, a questo punto, non vedo perchè tralasciare l'effetto blurring del filtro antimoire o gli effetti del filtro IR o, magari, come ho sentito da qualcuno, le aberrazioni introdotte dalle microlenti (che sono il rimedio e non la causa degli eventuali problemi di accoppiamento lente-sensore, soprattutto quando le dimensioni ddei sensori e dei pixel si riducono), non mi pare un modo di procedere troppo scientifico Ultima modifica di yossarian : 28-12-2011 alle 17:21. |

|||||||

|

|

|

|

|

#53 |

|

Senior Member

Iscritto dal: Mar 2001

Messaggi: 5373

|

rileggendo l'articolo di dxomark in cui si parla delle misurazioni effettuate sui sensori con ottiche f/1.2 e f/1.4, mi sono venute in mente una serie di questioni.

nell'articolo si parla di una caduta di intensità luminosa rilevata ai bordi utilizzando ottiche luminose, ma manca un'analisi approfondita di un fenomeno, per altro già noto e che provoca altri effetti visibili come, ad esempio la vignettatura. 1) la "perdita di luce" avviene rispetto a cosa? Ad un ipotetico obiettivo ideale di uguale apertura e stessa trasmittanza? Rispetto al centro (e grazie, verrebbe da aggiungere 2) nell'articolo si afferma che il conseguente innalzamento degli ISO per compensare la "perdita di luce" provochi più rumore senza portare benefici. In realtà anche la stessa caduta di luce provoca un peggioramento del SNR e questo dovrebbe significare che i sensori che nel test presentano il fenomeno in maniera più accentuata dovrebbero presentare cifre di rumore più elevate. Se prendiamo sensori con caratteristiche analoghe (d200, d80, d60, d40x) scopriamo che, mentre, in teoria, tra d60, d40x e d200 a f/1.2 dovrebbe esserci quasi 1/2 eV di vantaggio, come rumore, a favore della terza, nei fatti, secondo le misurazioni di dxomark, le cose non stanno affatto così (anzi la d60 fa meglio della d200, anche se di poco). Discorso analogo per d300 e d300s e d3 e d3s. Se guardo poi questo , in cui ho inserito 7d e 550d (identico comportamento) e d200 (che dovrebbe fare meglio, almeno fino a 1600 iso), la cosa diventa imbarazzante. E' evidente che la "perdita di luce" e il fatto che la 7d "compensi" più della d200 non sono sufficienti a far registrare un SNR peggiore. 3) nel commento al primo grafico è riportato questo: This loss seems to increase when the pixel size decreases, as shown on the figure below.. Ora, scusami, ma la cosa è tutt'altro che evidente. sensori da quasi 8 micron di pixel pitch e per di più di tipo ccd, fanno peggio di altri da poco più di 4 micron di pixel pitch, per di più di tipo cmos FSI, ovvero il tipo trattato dall'articolo della Stanford perchè è quello che presenta le maggiori criticità ai bordi nelle operazioni di scaling geometrico. Anzi, a ben guardare, pare che i sensori ccd con pixel pitch di 8 micron sono quelli che si comportano peggio in assoluto 4) le fotocamere compensano la caduta di luce alzando gli ISO. 7d con f/1.2, caduta di luce di circa 0,95 eV (ossia quasi 1 eV, compensazione di circa 0,58; a f/1.4, light loss di 0,65, compensazione di 0,36 circa. Ovvero, con ottiche luminose, a partire da f/2.8, la aps-c hanno tutte tendenza a sottoesporre, visto che hanno la necessità di compensare ma compensano meno di quanto perdono? Con la 7d o con la 30d, a f/2.8 non ho mai avuto problemi di sottoesposizione. Quando proverò ottiche più luminose vedremo cosa succede. Questo non significa girarsi dall'altra parte, anche perchè, lo ripeto, si tratta di un fenomeno già noto e che dà luogo anche ad effetti molto più visibili; è un fenomeno che esisteva già con la pellicola anche se non era possibile quantificarlo e che con i sensori digitali ha solo aggiunto qualche elemento in più. Passando a cose più serie, ossia le pubblicazioni scientifiche, è evidente che questo (e altri) fenomeni, fossero già noti ben prima della "scoperta" dei tecnici di dxomark e non solo ai progettisti di lenti e sensori digitali (basta guardare le date degli articoli che si trovano online) Allo stesso modo, il vignetting e fenomeni di light fall, soprattutto in prossimità dei margini del frame, erano fenomeni noti ben prima dell'era digitale. Questo significa che, ad esempio, le microlenti, contrariamente a quanto scritto da chi ha iniziato il thread su dpreview, non sono la causa del vignetting ma, se mai, il rimedio: il pixel vignetting è solo una componente del fenomeno globale ed è l'unica imputabile al digitale ma microlenti progettate bene ne introducono poco ma, in compenso, aumentano notevolmente la capacità dei singoli pixel di catturare luce anche con angoli meno favorevoli; questo spiega il perchè, contrariamente a quanto affermato dai tecnici di dxomark, il teorema "pixel più grandi = meno light fall" non è valido in toto ma solo a parità di tecnologia (delle microlenti). Tra le altre cose, sempre il citato articolo di Stanford parla dei problemi connessi alle operazioni di scaling dimensionale dei pixel e, in particolare, alla necessità di progettare microlenti che non solo tendano a focalizzare la luce verso il centro del pixel, ma anche a guidarla in modo tale che raggiunga la parte fotosensibile dello stesso (con riferimento ai cmos di tipo aps FSI). Questo perchè, in caso contrario, si hanno due fenomeni: abbassamento dell'efficienza ottica del pixel (che ha come conseguenza il light fall) e accentuazione dei fenomeni di optical pixel crosstalk (ovvero interferenze tra radiazioni incidenti su pixel confinanti, da non confondere con il crosstalk di tipo elettronico). Questi fenomeni, ovviamente, sono tanto più presenti nelle zone periferiche, dove gli angoli di incidenza sono meno favorevoli e si accentuano al diminuire delle dimensioni dei pixel. Solo poche righe su questo articolo; qui in parte è confermato l'oggetto del thread, ossia l'incremento della sensibilità per compensare le perdite di luminosità. In realtà, l'articolo è incentrato su un altro punto: ossia sulle manipolazioni che vengono fatte sui file RAW che, come ho ripetuto più volte, non solo in questo thread, sono tutt'altro che grezzi (e canon è, probabilmente, quella che manipola di meno i RAW). Detto ciò, continuo a non vedere il presunto "complotto" o imbroglio a chiamalo come vuoi, da cui si salverebbero solo i produttori di pellicole perchè queste ultime non possono variare al volo gli ISO quando c'è una perdita di luminosità su parte del frame Piuttosto, guardando le date, vedo che la lettera aperta di LL è di ottobre 2010 e cita un articolo di dxolabs di fine novembre dello stesso anno

Ultima modifica di yossarian : 30-12-2011 alle 21:06. |

|

|

|

|

|

#54 | ||||||||

|

Bannato

Iscritto dal: Aug 2006

Città: Parma

Messaggi: 2579

|

Avevo cominciato a risponderti al penultimo appena l'avevi scritto ma poi non avevo postato per impegni, ora vedo che in parte hai modificato l'intervento nell aprte finale e iniziale, oltre ad aver aggiunto un'intervento quindi pazienta se lo leggerò dopo e troverai in parte risposta anche al secondo.

Quote:

Quote:

Ammiro l'impegno Ammiro l'impegno Invece la tendenza è concorde con la riduzione del pixel, così come previsto per il primo difetto quindi non vedo perché dovrei pensare a un fenomeno secondario (vignettatura) che non tiene conto di quell'andamento. A maggior ragione, poi, se c'è un aggravio della vignettatura col pixel vignetting, allora significa dare un peso ancora maggiore al primo difetto (che si arrendono perfino dal correggere a differenza dell'altro!) dato che hanno la medesima genesi. Ovviamente non è solo la riduzione (pixel pitch) che influisce, ma anche questo è concorde col fatto che, come spiegato nell'articolo, dipende dalla tecnologia di produzione e dal progetto della microlente. Sicuramente sono state affinate diversamente negli anni (quante volte abbiamo sentito parlare di nuove lenti gapless o altri affinamenti come quelli a cui ti riferisci appunto), ciò può spiegare perché un modello più vecchio o di gamma inferiore a parità di pitch possa fare peggio. Quote:

Certo che l'avrebbe superato è analogo al grafico dopo, Certo che l'avrebbe superato è analogo al grafico dopo,  Quote:

(costerà sicuramente meno cambiare l'ultimo piuttosto che riprogettare tutti i processi litografici del sensore). Lo stesso si può dire per altri casi: (costerà sicuramente meno cambiare l'ultimo piuttosto che riprogettare tutti i processi litografici del sensore). Lo stesso si può dire per altri casi:  fra 7D e 550D (18Mpx) c'è differenza (come tra 20D e 30D) e pure lì quella della generazione dopo fa meglio, ma ad esempio fra 50D e 500D (15Mpx) NO, un altro caso esmplare che non muta è D40X/D60 (10Mpx) che sono praticamente la stessa macchina (con la D80 attaccata pure), così come D50/D70/D40 (6Mpx). Anche k20d e k-7 hanno lo stesso identico sensore a sentito comune, peccato che uno può fare i video e l'altro no quindi NON è sicuramente lo stesso identico sensore! fra 7D e 550D (18Mpx) c'è differenza (come tra 20D e 30D) e pure lì quella della generazione dopo fa meglio, ma ad esempio fra 50D e 500D (15Mpx) NO, un altro caso esmplare che non muta è D40X/D60 (10Mpx) che sono praticamente la stessa macchina (con la D80 attaccata pure), così come D50/D70/D40 (6Mpx). Anche k20d e k-7 hanno lo stesso identico sensore a sentito comune, peccato che uno può fare i video e l'altro no quindi NON è sicuramente lo stesso identico sensore!  Certo non è come passare dal bianco al nero, esistono i toni di grigio: non avranno riprogettato tutto ma qualcosa ogni tanto affinano. D'altronde come fai ad essere sicuro di cosa facciano nella produzione e che mantengano sempre lo stesso protocollo dall'inizio alla fine in tutti i casi simili? Di sicuro non vengono a dircelo a noi! Perfino quando riutilizzano lo stesso sensore (Sony) su più fotocamere a distanza di 6 mesi o un anno, a me vengono seri e fondati dubbi non possa essere stato affinato qualcosa, visto come a volte cambia la QI. Certo non è come passare dal bianco al nero, esistono i toni di grigio: non avranno riprogettato tutto ma qualcosa ogni tanto affinano. D'altronde come fai ad essere sicuro di cosa facciano nella produzione e che mantengano sempre lo stesso protocollo dall'inizio alla fine in tutti i casi simili? Di sicuro non vengono a dircelo a noi! Perfino quando riutilizzano lo stesso sensore (Sony) su più fotocamere a distanza di 6 mesi o un anno, a me vengono seri e fondati dubbi non possa essere stato affinato qualcosa, visto come a volte cambia la QI.Quote:

Quote:

Quando dico che le prove sono più affidabili se fatte da laboratori c'è un motivo.. Quando dico che le prove sono più affidabili se fatte da laboratori c'è un motivo.. Ultima modifica di Chelidon : 02-01-2012 alle 21:01. |

||||||||

|

|

|

|

|

#55 | |||||||||

|

Senior Member

Iscritto dal: Mar 2001

Messaggi: 5373

|

Quote:

Quote:

Quote:

Quote:

Un sensore identico ad un altro, con microlenti migliori, a parità di iso, fa segnare SNR più elevati a causa della maggior OE e del miglior contenimento del crosstalk (nel caso dei cmos FSI). Invece, prendendo le stesse misurazioni di dxolabs, questo non avviene; in alcuni casi il comportamento è identico, in altri, addirittura, venno meglio quelli che fanno registrare cadute di luce più elevate. Scusa tanto, ma i conti non tornanno affatto  . . In quanto alla tipologia dei sensori, quello della d200 e quello della d80 differiscono solo leggerissimamente a livello di dimensioni lineari, pur conservando la stessa area e le stesse dimensioni dei singoli pixel, in quanto la d200 ha 4 readout channel contro i 2 della d80. Tra 20d e 30d il sensore è lo stesso, mentre è leggermente differente quello della 350d. Il fatto che la k7 faccia i video e la k20 no non ha alcun significato: in una fotocamera non è il sensore l'unica componente elettronica presente; prensìdi un pc senza un codec, ad esempio, per il formato AVCHD e poi prendine uno identico dotato del codec necessario. L'hardware è lo stesso, le funzionalità no Quote:

Quote:

p.s. non è che i cmos mi piacciono tanto. Personalmente non li trovo particolarmente attraenti; il fatto è che fanno parte del mio lavoro, quindi, comunque, devo averci a che fare, anche non volendo Quote:

Quote:

Quote:

In quanto alle prove, andrebbero fatte in laboratorio, ma sapendo cosa si va a misurare, cosa che spesso non avviene (e mi riferisco anche alle prove fatte con dxomark) Ultima modifica di yossarian : 03-01-2012 alle 01:57. |

|||||||||

|

|

|

|

|

#56 | |||||||

|

Bannato

Iscritto dal: Aug 2006

Città: Parma

Messaggi: 2579

|

Soc! Ma sai che non riesco a capire se fai fatica a crederci per un pregiudizio duro a morire o semplicemente non leggi attentamente gli articoli!?

Comunque in un caso o nell'altro non capisco (visto che so che sui sensori in genere sei molto interessato Comunque in un caso o nell'altro non capisco (visto che so che sui sensori in genere sei molto interessato Quote:

visto che spiegano proprio nella lettera che hanno avuto contatti con DxO, che gli ha fatto notare per primi i risultati che poi hanno reso pubblici... visto che spiegano proprio nella lettera che hanno avuto contatti con DxO, che gli ha fatto notare per primi i risultati che poi hanno reso pubblici... Quote:

e che il lettore accorto scarti il resto dei ragionamenti. e che il lettore accorto scarti il resto dei ragionamenti. Spero di non sembrare che ci vada giù pesante, ma il calderone lo fai te, se vai a tirare in ballo fenomeni che non causano la perdità di esposizione riscontrata, ma semplicemente difetti nell'immagine o altre cose che nulla centrano. Quote:

Quote:

Quote:

e anch'io mi sarei aspettato un approfondimento più chiaro e scientifico (ma non sarebbe la prima volta che in un secondo momento sull'ondata di richieste chiariscono le procedure tenute e articolino meglio la fondatezza delle loro conclusioni, ad esempio come in questo caso e anch'io mi sarei aspettato un approfondimento più chiaro e scientifico (ma non sarebbe la prima volta che in un secondo momento sull'ondata di richieste chiariscono le procedure tenute e articolino meglio la fondatezza delle loro conclusioni, ad esempio come in questo caso  ). Però, se ti dai da fare e cerchi un attimo, ). Però, se ti dai da fare e cerchi un attimo,  mi pare piuttosto scontato che siano i dati aggregati presi dai loro database con due tipologie di misurazione distinte: mi pare piuttosto scontato che siano i dati aggregati presi dai loro database con due tipologie di misurazione distinte:

Quote:

Sul punto 4) hai ragione: l'amplificazione non trasparente dell'ISO è solo un pagliativo e non corregge interamente la perdita, ma mi chiedo anche quanti noterebbero comunque che un'obiettivo del genere perda 0,4-0,3 EV solo a tutta apertura! Occhio a f/2 e f/2.8 la perdità si riduce e sfido se c'è chi con una scena varia (non lo sfondo uniforme di un test) riesca a distinguere differenze di esposizione inferiori al quarto di stop e abbia l'accortezza mentale di collegare tutti i pezzi del puzzle fino a notare che è un problema che capita solo col costoso obiettivo luminoso a TA! A parte il discorso che ti ho già fatto che sulla pellicola hai solo vignettatura e non problemi dovuti a pixel che non ci sono proprio! Visto che i fenomeni che abbiamo descritto sorgono perché l'area sensibile non coincide con l'area del pixel: per questo servono le microlenti proprio come fai notare tu. Su tutto quello dopo sono perfettamente d'accordo e l'ho letto anch'io: le microlenti hanno un ruolo fondamentale e a detta dei "tecnici" per ora in parte sono l'anello debole che va migliorato e limita sia l'integrazione esagerata (DPS) che scalare Mpx. Quote:

Dimentichi che ora non è che la situazione sia scegli o la tecnologia pellicola o quella sensore. Dato che c'è stato un ordine temporale e ora i secondi hanno soppiantato la prima, anche grazie ad un certo numero di vantaggi (ben sottolineati dalla pubblicità quando si trattava di fare il passaggio), si potrebbe notare che i fenomeni descritti siano uno svantaggio degli attuali sensori (benché palesemente noto stranamente sottaciuto) e sotto questa luce (come ho già fatto notare indietro) si capisce il vespaio di polemiche di LL e altri che quel passaggio l'hanno conosciuto. |

|||||||

|

|

|

|

|

#57 | |||||||

|

Senior Member

Iscritto dal: Mar 2001

Messaggi: 5373

|

Quote:

Quote:

Quote:

Quote:

Quote:

Quote:

Quote:

Ultima modifica di yossarian : 04-01-2012 alle 11:59. |

|||||||

|

|

|

|

|

#58 | ||||||||

|

Bannato

Iscritto dal: Aug 2006

Città: Parma

Messaggi: 2579

|

Quote:

Ma anche te dai come dato di fatto (e su questo basi la tua giustificazione dell'aumento nascosto di esposizione Ma anche te dai come dato di fatto (e su questo basi la tua giustificazione dell'aumento nascosto di esposizione Quote:

La pellicola non ha le microlenti perché NON NE HA BISOGNO: infatti nessuno si è mai posto il problema semplicemente perché non ne aumenterebbero l'efficienza per nulla, dato che si comporta a prescindere dai grani come un continuo: la radiazione nel suo cammino incontra COMUNQUE SEMPRE UN GRANO a causa della disposizione tridimensionale casuale di questi! Il punto è che barriere geometriche a livello della superficie sensibile che possano creare fenomeni di vignetting dovuti al pixel non ce ne sono proprio nella pellicola (detto in altri termini il fill-factor è 100%)!  Come dici te le microlenti sono la soluzione (e come si legge indietro non ho mai detto il contrario solo che hanno dei limiti) a difetti e limiti nei pixel dei sensori attuali (che avranno tanti vantaggi ma non credo siano perfetti e mi sembra sciocco idealizzarli oltre i loro limiti). Come dici te le microlenti sono la soluzione (e come si legge indietro non ho mai detto il contrario solo che hanno dei limiti) a difetti e limiti nei pixel dei sensori attuali (che avranno tanti vantaggi ma non credo siano perfetti e mi sembra sciocco idealizzarli oltre i loro limiti). Quote:

Quote:

Quote:

L'articolo che ti ho citato, mantiene questa distinzione, quindi non sono SOLO 4 strati per fare la guida d'onda, ma se leggi la parte sul DPS vedi che i pixel a blocchi di 4 condividono pure l'ADC che riduce (e rende anche asimmetriche) le misurazioni finali. Con ciò vogliono dimostrare,come fanno espressamente notare, che l'aumento d'integrazione complica i problemi di cui stiamo parlando (on-axis e off-axis). Tanto che nelle conclusioni, oltre a consigliare un compromesso verso la minore complessità nell'integrazione, suggeriscono la possibilità di uso per le microlenti, invece del biossido di silicio (compatibile coi processi litografici e perciò a basso costo) di materiali polimerici per superare i limiti di concentrazione di cui abbiamo già parlato. Quote:

Col discorso che fai, in pratica, stai confermando quello che ho detto finora: ovvero che allo scalare del pixel pitch verso il basso (più Mpx), la NA della microlente a causa di limitazioni tecniche diminuisce e può non riuscire a stare dietro all'angolo di accettanza della pupilla di uscita dell'obiettivo. Di conseguenza stai confermando, proprio tu, che il f# (o diaframma che dir si voglia) dell'obiettivo viene limitato a livello di ogni pixel (d'altronde, lo ripeto, non ci sono dubbi su questo fenomeno in letteratura). Quote:

2) A quanto mi risulta sui sensori "grandi" (cioè quelli di fotocamere a lenti intercambiabili), non c'è ancora alcun BSI e non mi sembra che prevedano di impiegarli a breve per una serie di ragioni che per ora li rendono più appetibili sui sensori "piccoli" di cellulari e compatte. Quando ci saranno (o anche solo appena testeranno le sigma con X3) vedremo quanto cambieranno le analisi di DxO. Quote:

Retoricamente non ricordo, ma dimmi un po' quale di queste 3 tipologie usavano per quelle reflex del grafico (o le reflex in generale)?? Retoricamente non ricordo, ma dimmi un po' quale di queste 3 tipologie usavano per quelle reflex del grafico (o le reflex in generale)?? Bene questo spiega e adesso possiamo intuire perché non fanno molto meglio dei CMOS (questo lo ricordo perché una volta me lo hai fatto notare proprio tu Visto che i due fenomeni che ho citato: cioè "problema di NA della microlente" e "pixel vignetting allontanandosi dall'asse" dici che non affliggono tipologie di sensori diverse dai cmos aps (fsi sott'inteso: bsi me lo risparmi vero fino a che non ne faranno una..  ). ).Visto che l'altra volta volevo mettere qualcosa di schematico te lo cito ora dato che riguarda un CCD:  Fa le stesse considerazioni ripetute finora e chiarisce meglio a livello ottico quello che sto cercando di dire:

|

||||||||

|

|

|

|

|

#59 | |||

|

Bannato

Iscritto dal: Aug 2006

Città: Parma

Messaggi: 2579

|

Quote:

Li esempi li ho già fatti, ma ricapitolando: sembrano accomunate D50/D70/40, 1Dmk2/1Dmk2N, D40X/D60/D80, 50D/500D, D300/D90/D300s, 20D/350D, 1000D/400D; restano lontane d80/d200, 20D/30D, 400D/40D e 550D/7D. Quote:

7D/550D circa 1 Db peggio la 7D sì ma ad alti ISO uguali (la 550D risulta uguale alla 500D 500D-50D uguali sì 400D/40D quasi uguali no (forse 0,5 Db peggio la 400D sì che però è uguale alla 1000D sì) 20D/30D uguali no (e praticamente identiche alla 350D sì che perde solo ad alti ISO forse quasi 0,5 Db) D300s/-D90-/D300 sotto di 0,5 Db o appena più la D300 rispetto alla D300s D60-D40X-/D80 peggio di meno di 1 Db la D60 rispetto alla D40X D80/D200 peggio di più di 0,5 Db la D80 della D200 sì D50-D70-D40 uguali sì (D70 cala di 0,5 Db ad altissimi ISO) Ora io non so quanti fenomeni hardware o semplicemente correzioni software possano incidere (E QUANTO!) su quel dato di SNR 18% al variare dell'ISO: ci sono alcuni casi in cui prevede correttamente sì, altri no, in molti casi sembra si contraddica,  ma sopratutto non è mai coerente con le differenze previste né da me, né da te, quando ci sono quindi non riesce nemmeno a smentire il grafico (nei ma sopratutto non è mai coerente con le differenze previste né da me, né da te, quando ci sono quindi non riesce nemmeno a smentire il grafico (nei Quote:

Per chiudere il piacevole confronto, non so cos'altro si possa dire

|

|||

|

|

|

|

|

#60 | |||||||||

|

Senior Member

Iscritto dal: Mar 2001

Messaggi: 5373

|

Quote:

Vediamo adesso cme è fatto un sensore. Tu parti dal principio che un raggio luminmoso che entri iin diagonale attraverso una microlente non colpisca un elemento fotosensibile. In realtà le cose non stanno affatto così, a meno che quel raggio non finisca sulla parte superficiale occupata dagli elementi circuitali preposti a funzioni differenti dalla cattura della luce. Ma questo vale solo per i cmos di tipo FSI che hanno, al di sotto della superficie uno strato composto dalle metallizzazioni, disposte sui bordi della superficie del pixel e, sotto questo strato, un tunnel composto da materiali non necessariamente riflettenti, che conduce al fotodiodo. Questo significa che una radiazione diagonale che attraversa la microlente e non colpisce i circuiti in superficie, in mancanza di un tunnel con pareti riflettenti arriva a colpire, comunque, un fotodiodo: quello di uno dei pixel contigui, causando un fenomeno analogo a quello che avvine con la pellicola e che si definisce optical crosstalk e dà origine a errori nella rilevazione dei valori corretti per quel singolo pixel e per quello vicino di cui "si è preso" i fotoni. Il risultato è rumore. Per questo motivo, sui cmos FSI, il tunnel viene schermato in modo da ridurre al minmo il fenomeno del crosstalk. In questo modo, i fotoni che entrano in dagonale e non colpisocono i circuiti superficiali, rimbalzano sulle pareti del tunnel, esattamente come in una fibra ottica, fino ad arrivare al fotodiodo CORRETTO. Sui CCD FF transfer e sui CMOS BSI, invece, la superficie fotoassorbente è sopra agli altri elementi circuitali, il che significa che un raggio che entra in diagonale attraverso la microlente, ha ottime probabilità di colpire il corretto fotodiodo. Ovviamente, queste probabilità sono vicine al 100% se il pixel è di grandi dimensioni e calano al diminuire delle dimensioni del pixel stesso. Nei foveon, che come struttura ricalcano la pellicola, una radiazione diagonale può fare veri disastri, non perchè non colpisce elementi fotosensibili, ma perchè, almeno finora, non è stato possibile realizzare un tunnel schermato tra pixel contigui a causa dell sviluppo in profondità e, quindi il crosstalk ottico è incontrollabile e, con basse luci, quando il SNR è molto basso, questo tipo di disturbo è quello che crea più problemi (questo è il vero motivo per cui questo tipo di tecnologia non ha preso piede). Quote:

Quote:

Quote:

Tornando al documento della Stanford, si tratta di un'analisi un po' datata, riferita ad una tecnologia oggi di comune applicazione. Anzi, rispetto a quel documento, in cui si consiglia l'adozione di uno strato riflettente come guida (il 4), oggi si tende ad estendere la guida a tutta la profondità del canale. Quote:

displaced from the pixel floor. These rays would strike the edge of the pixel tunnel or travel to regions within the floor of adjacent pixels. The microlens must redirect these rays so that they travel through the pixel tunnel and reach the photodetector position at the substrate. The loss of light due to the failure to redirect these rays is called pixel vignetting. Redirection of the rays is achieved by appropriate placement of the microlenses with respect to the pixel aperture. questo passo, tratto testualmente dall'articolo in questione, nel punto in grassetto parla proprio del fenomeno del crosstalk ottico, ovvero fotoni che attraversano il substrato in diagonale, raggiungendo il "pavimento", ossia il fondo, dove si trova il fotodiodo, di un pixel adiacente. L'articolo è incentrato proprio sul fatto che AL DIMINUIRE DELLE DIMENSIONI DEI PIXEL, questo fenomeno viene accentuato, in quanto, mentre lo scaling sugli assi x e y (che chiamo l per comodità) avviene esnsa problemi, ben più difficile è ridurre le dmensioni lungo l'asse z , ovvero in profondità. Questo comporta che, ogni volta che si fa scaling, il rapporto tra l/z diminuisce. Questo crea sempre più problemi al corretto indirizzamento della luce che attraversa la microlente con angoli non favorevoli. Attenzione, l'articolo non parla della luce che cade sugli spoazi tra pixel ma delle difficoltà ad indirizzare la luce che cade sul pixel. Quote:

Quote:

Quote:

Quote:

|

|||||||||

|

|

|

|

| Strumenti | |

|

|

Tutti gli orari sono GMT +1. Ora sono le: 15:19.