AMD pubblica una guida per eseguire OpenClaw in locale su Windows: ecco RyzenClaw e RadeonClaw

AMD ha pubblicato una guida per eseguire gli agenti AI di OpenClaw in locale su Windows usando due configurazioni hardware ribattezzate RyzenClaw e RadeonClaw. L'obiettivo è dimostrare la fattibilità di sistemi "Agent Computer" sempre attivi.

di Manolo De Agostini pubblicata il 14 Marzo 2026, alle 16:01 nel canale ProcessoriRyzenRadeonAMD

AMD ha pubblicato una guida tecnica per eseguire OpenClaw, piattaforma open source per agenti AI autonomi, direttamente su sistemi locali basati su hardware Ryzen o Radeon. L'iniziativa si inserisce in quella che AMD definisce "Agent Computer", ovvero una nuova categoria di PC progettati per eseguire agenti AI in modo continuativo senza dipendere dal cloud. Qualcosa che richiama Perplexity Computer.

Nella visione di AMD e altre società, l'utente non interagisce direttamente con il sistema come con un normale PC, ma assegna compiti agli agenti, che possono poi eseguire applicazioni e servizi in autonomia. OpenClaw supporta infatti l'integrazione con diversi strumenti e servizi digitali e può operare sia con accesso completo al sistema sia in modalità sandbox, a seconda dei requisiti di sicurezza.

Clicca per ingrandire

Secondo l'azienda, molti utenti e organizzazioni potrebbero preferire soluzioni locali per motivi di controllo dei dati, costi operativi e assenza di limiti di utilizzo tipici dei servizi cloud. Un sistema dedicato potrebbe funzionare come una sorta di assistente permanente sempre attivo in casa o in ufficio, capace di gestire attività in autonomia tramite agenti software.

Clicca per ingrandire

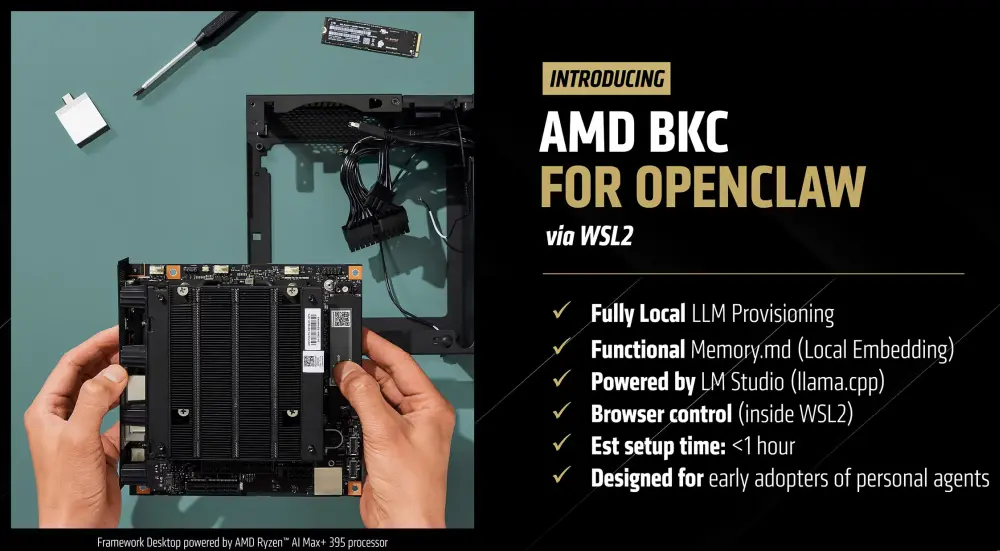

La guida descrive due percorsi hardware distinti, denominati "RyzenClaw" e "RadeonClaw", entrambi progettati per eseguire OpenClaw su Windows utilizzando WSL2, LM Studio e l'inferenza locale dei modelli tramite llama.cpp.

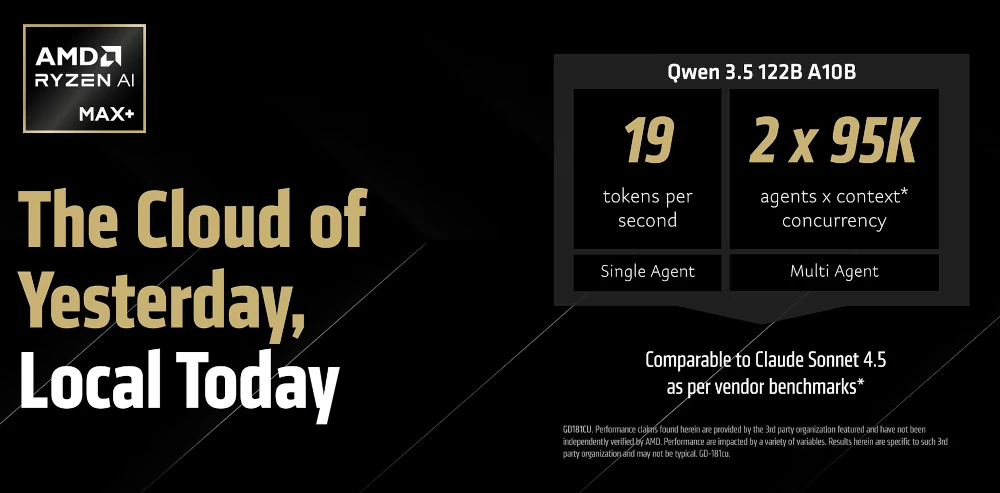

RyzenClaw su sistemi con Ryzen AI Max+

Clicca per ingrandire

Il primo scenario prevede l'uso di una piattaforma basata su Ryzen AI Max+ con 128 GB di memoria unificata. AMD raccomanda di configurare 96 GB come memoria grafica variabile, così da offrire spazio sufficiente ai modelli linguistici. In questa configurazione OpenClaw può eseguire il modello Qwen 3.5 35B A3B, raggiungendo circa 45 token al secondo. AMD indica inoltre alcune capacità operative:

- elaborazione di 10.000 token di input in circa 19,5 secondi

- finestra di contesto fino a 260.000 token

- supporto fino a sei agenti simultanei

La disponibilità di grandi quantità di memoria è il fattore che consente a questo sistema di sperimentare configurazioni di "agent swarm", ovvero più agenti che collaborano tra loro per portare a termine attività complesse.

RadeonClaw: prestazioni più elevate con GPU workstation

Il secondo approccio, chiamato RadeonClaw, utilizza invece una GPU Radeon AI PRO R9700 dotata di 32 GB di VRAM. In questo caso il sistema risulta sensibilmente più veloce con lo stesso modello AI:

- circa 120 token al secondo

- elaborazione di 10.000 token in circa 4,4 secondi

Il rovescio della medaglia è una minore capacità di parallelizzazione: la configurazione supporta solo due agenti contemporanei e offre una finestra di contesto di circa 190.000 token, inferiore rispetto alla piattaforma Ryzen AI Max+.

Clicca per ingrandire

Nonostante il potenziale tecnico, le configurazioni indicate da AMD restano per ora lontane dall'essere soluzioni mainstream. Un sistema basato su Ryzen AI Max+ con 128 GB di memoria, come ad esempio alcune configurazioni desktop dedicate, può superare i 2700 dollari senza includere lo storage. La GPU Radeon AI PRO R9700, invece, parte da circa 1300 dollari.

Di conseguenza, la proposta appare destinata soprattutto a sviluppatori ed early adopter interessati a sperimentare agenti AI locali piuttosto che al pubblico consumer. Ma, come si suol dire, tempo al tempo. Il concetto di AI agent sempre attivi in locale rappresenta una delle possibili e promettenti evoluzioni del mercato AI.

Wi-Fi 7 con il design di una vetta innevata: ecco il nuovo sistema mesh di Huawei

Wi-Fi 7 con il design di una vetta innevata: ecco il nuovo sistema mesh di Huawei Core Ultra 7 270K Plus e Core Ultra 7 250K Plus: Intel cerca il riscatto ma ci riesce in parte

Core Ultra 7 270K Plus e Core Ultra 7 250K Plus: Intel cerca il riscatto ma ci riesce in parte PC Specialist Lafité 14 AI AMD: assemblato come vuoi tu

PC Specialist Lafité 14 AI AMD: assemblato come vuoi tu L'esperimento BASE del CERN è riuscito a trasportare dell'antimateria

L'esperimento BASE del CERN è riuscito a trasportare dell'antimateria Afeela è morta: chiusa definitivamente la collaborazione tra Sony e Honda per gli EV premium

Afeela è morta: chiusa definitivamente la collaborazione tra Sony e Honda per gli EV premium Intel BOT altera i risultati, Geekbench invita a non fidarsi dei risultati delle CPU che lo supportano

Intel BOT altera i risultati, Geekbench invita a non fidarsi dei risultati delle CPU che lo supportano Intel e AMD faticano a soddisfare la domanda consumer: CPU introvabili e attese fino a sei mesi

Intel e AMD faticano a soddisfare la domanda consumer: CPU introvabili e attese fino a sei mesi Microsoft e NVIDIA insieme per dare una scossa allo sviluppo del nucleare: l'IA per accelerare i tempi

Microsoft e NVIDIA insieme per dare una scossa allo sviluppo del nucleare: l'IA per accelerare i tempi Ring rinnova l'intera gamma video: 4K su batteria, PoE e nuovo caricatore solare tra le novità

Ring rinnova l'intera gamma video: 4K su batteria, PoE e nuovo caricatore solare tra le novità Recensione Galaxy Buds4 Pro: le cuffie Samsung più belle e intelligenti

Recensione Galaxy Buds4 Pro: le cuffie Samsung più belle e intelligenti Spotify si arricchisce ancora: arriva SongDNA, tutto sulla tua musica preferita

Spotify si arricchisce ancora: arriva SongDNA, tutto sulla tua musica preferita I digital twin di AVEVA a supporto delle AI Factory di NVIDIA

I digital twin di AVEVA a supporto delle AI Factory di NVIDIA Iliad non si ferma: clienti in crescita sia sul mobile sia per la fibra

Iliad non si ferma: clienti in crescita sia sul mobile sia per la fibra XuanTie C950, il chip IA di Alibaba basato su RISC-V sarà prodotto a 5 nm

XuanTie C950, il chip IA di Alibaba basato su RISC-V sarà prodotto a 5 nm Volkswagen richiama 94.000 auto elettriche per rischio incendio nei moduli batteria

Volkswagen richiama 94.000 auto elettriche per rischio incendio nei moduli batteria Le nuove LaserJet di HP portano la crittografia quantum-resistant su tutte le stampanti, dalle Pro alle Enterprise

Le nuove LaserJet di HP portano la crittografia quantum-resistant su tutte le stampanti, dalle Pro alle Enterprise FSR 4 gira sulla GPU di PS5 Pro, ma non sulle vecchie Radeon: AMD cosa aspetti?

FSR 4 gira sulla GPU di PS5 Pro, ma non sulle vecchie Radeon: AMD cosa aspetti?

6 Commenti

Gli autori dei commenti, e non la redazione, sono responsabili dei contenuti da loro inseriti - infoOppure potrebbe peggiorare se gli USA vogliono continuare l'attuale traiettoria autodistruttiva.

Ci sono i tensor core/IA accelerator/xmx delle schede video che vengono usati per i "videogiochi" per creare immagini finte che alla fine,vengono anche usati per fare girare i modelli di IA ma non con poche difficoltà, difatti Windows fa girare solo la IA nelle CPU con le unità IA dedicate per non incappare nella frammentazione.

A questo punto conviene infarcire di più le CPU (cosa che a Nvidia potrebbe arrecare danno) di unità di elaborazione IA più che le GPU se vogliamo arrivare a computer con sistemi operativi agentici.

Ci sono i tensor core/IA accelerator/xmx delle schede video che vengono usati per i "videogiochi" per creare immagini finte che alla fine,vengono anche usati per fare girare i modelli di IA ma non con poche difficoltà, difatti Windows fa girare solo la IA nelle CPU con le unità IA dedicate per non incappare nella frammentazione.

A questo punto conviene infarcire di più le CPU (cosa che a Nvidia potrebbe arrecare danno) di unità di elaborazione IA più che le GPU se vogliamo arrivare a computer con sistemi operativi agentici.

Non vorrei sbagliarmi, ma su Github si trovano AI (ed altri siti di informatica si trovano info a riguardo) che ad esempio avviando .bat con Phyton con aggiunto i modelli necessari scaricandoli dai siti di storage ufficiali che una volta avviati funzionano anche solamente coi tensor cores con RTX media o bassa, ma per maggiori info devi vedere che non so bene.

Il DLSS delle RTX e l'FSR su Linux attivabile con stringa in Steam (e questo per ogni GPU e non solo RTX), per un giocatore entry level che punta a giocare intelligentemente ai triple A in risparmio energetico sono una giga manna dal Cielo.

Per articolo, ma questa AI non e' la stessa che è stato dimostrato che basta un comando nascosto nell'email o nella pagina web visitata per impartirle degli ordini ad insaputa per vero proprietario e le si fa fale quel che si vuole? Oppure che quando ha cambiato nome, hanno acquistato il precedente nome del sito web per sostituire i pacchetti con altri e via con eventuali problemi di sicurezza? Se è la stessa e non è un nome simile, anche avviarla in locale per poi darle comunque accesso ad internet, bah non la vedo bene.

Se invece e' un'altra, ok come non detto era un'altra.

Ci sono i tensor core/IA accelerator/xmx delle schede video che vengono usati per i "videogiochi" per creare immagini finte che alla fine,vengono anche usati per fare girare i modelli di IA ma non con poche difficoltà, difatti Windows fa girare solo la IA nelle CPU con le unità IA dedicate per non incappare nella frammentazione.

A questo punto conviene infarcire di più le CPU (cosa che a Nvidia potrebbe arrecare danno) di unità di elaborazione IA più che le GPU se vogliamo arrivare a computer con sistemi operativi agentici.

Serve memoria a volontà e veloce principalmente, cosa che manca con le CPU a meno di configurazioni multichannel, mentre con le GPU consumer manca la quantità.

Devi effettuare il login per poter commentare

Se non sei ancora registrato, puoi farlo attraverso questo form.

Se sei già registrato e loggato nel sito, puoi inserire il tuo commento.

Si tenga presente quanto letto nel regolamento, nel rispetto del "quieto vivere".