Meta accelera sui chip AI proprietari: quattro generazioni MTIA entro due anni

Meta accelera lo sviluppo dei propri acceleratori AI MTIA con l'annuncio di quattro nuove generazioni entro due anni. I chip, progettati per inferenza e carichi GenAI, avranno un'architettura modulare a chiplet, memoria HBM ad alta banda e caratteristiche specifiche per adattarsi all'infrastruttura di Meta.

di Manolo De Agostini pubblicata il 12 Marzo 2026, alle 08:31 nel canale Server e WorkstationMeta

Meta ha annunciato una significativa accelerazione nello sviluppo dei propri acceleratori per l'intelligenza artificiale. L'azienda prevede di introdurre quattro nuove generazioni della famiglia MTIA (Meta Training and Inference Accelerator) nell'arco di circa due anni, una cadenza molto più rapida rispetto ai cicli tradizionali dell'industria dei semiconduttori.

L'iniziativa rientra nella strategia infrastrutturale della società per sostenere l'espansione dei carichi di lavoro legati all'AI, che spaziano dai sistemi di ranking e raccomandazione dei contenuti fino alle applicazioni di intelligenza artificiale generativa. Secondo Meta, l'obiettivo è mantenere la flessibilità necessaria per supportare modelli in continua evoluzione e gestire l'enorme scala operativa delle proprie piattaforme.

I chip MTIA rappresentano una componente chiave della strategia hardware dell'azienda. La prima generazione è stata introdotta nel 2023 e da allora Meta ha progressivamente ampliato la famiglia di acceleratori, progettati internamente in collaborazione con Broadcom.

Questi chip sono utilizzati principalmente per carichi di inferenza AI, e l'azienda afferma di averne già distribuito centinaia di migliaia nei propri datacenter per alimentare funzionalità come raccomandazioni personalizzate e pubblicità nei servizi social del gruppo.

A differenza delle GPU general purpose, gli acceleratori MTIA sono progettati per carichi specifici di Meta e fanno parte di una soluzione hardware e software completamente integrata. Questo approccio consente di ottimizzare l'efficienza computazionale e ridurre i costi operativi rispetto all'impiego di chip più generici.

La roadmap annunciata include quattro nuove generazioni di acceleratori:

- MTIA 300 - già in produzione, ottimizzato inizialmente per l'addestramento dei modelli di ranking e raccomandazione

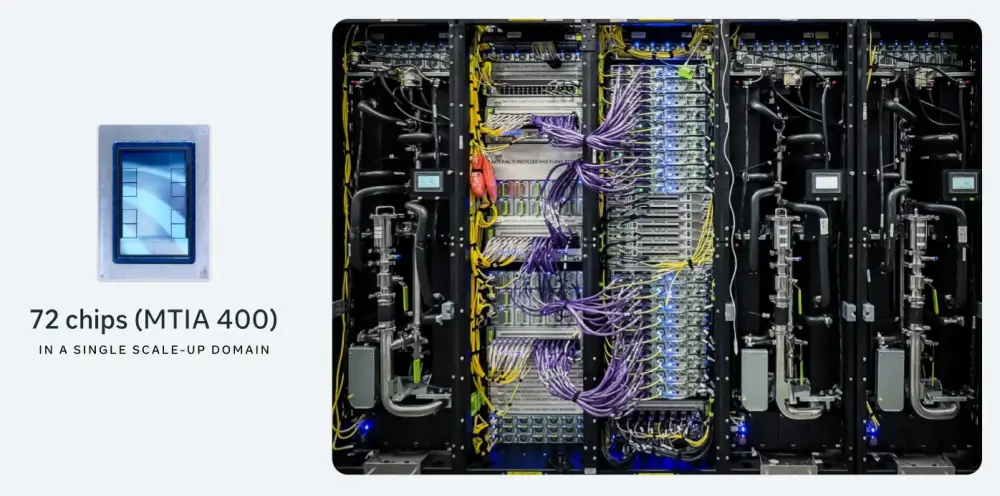

- MTIA 400 - evoluzione progettata per gestire anche carichi di lavoro di intelligenza artificiale generativa, con prestazioni di calcolo significativamente superiori

- MTIA 450 - ottimizzato per l'inferenza dei modelli GenAI e previsto per distribuzione su larga scala all'inizio del 2027. Bandwidth HBM raddoppiata rispetto a MTIA 400 e tipi di dati a bassa precisione progettati appositamente per i carichi di lavoro di inferenza

- MTIA 500 - ulteriore evoluzione focalizzata sull'inferenza generativa con maggiore efficienza e banda memoria. Bandwidth HBM aumentata del 50% rispetto a MTIA 450 e ulteriori innovazioni nei tipi di dati a bassa precisione

Nel passaggio da MTIA 300 a MTIA 500, Meta indica un incremento di circa 25 volte nelle prestazioni computazionali e di 4,5 volte nella banda della memoria HBM, miglioramenti ottenuti in meno di due anni.

Una caratteristica chiave della piattaforma è l'architettura modulare basata su chiplet riutilizzabili, che permette di aggiornare singoli componenti senza riprogettare completamente il chip.

Ad esempio, MTIA 300 integra un chiplet di calcolo, due chiplet di rete e diversi stack di memoria HBM. All'interno del chiplet di calcolo, Meta spiega che ci sono "processing element" (PE) che integrano core vettoriali RISC-V, unità dedicate alla moltiplicazione di matrici, engine per operazioni di riduzione e acceleratori per funzioni matematiche utilizzate nei modelli di machine learning.

Questa architettura modulare si estende anche a livello di sistema: più generazioni di chip condividono lo stesso chassis, rack e infrastruttura di rete, permettendo di installare nuovi acceleratori negli stessi datacenter senza modifiche sostanziali.

Uno dei pilastri della strategia è l'approccio "inference-first": laddove molte GPU commerciali vengono progettate principalmente per l'addestramento su larga scala dei modelli generativi e successivamente adattate all'inferenza, Meta ha scelto il percorso inverso: ottimizzare gli acceleratori innanzitutto per l'inferenza.

Per questo motivo, le generazioni MTIA 450 e 500 introducono diverse ottimizzazioni per l'inferenza di modelli generativi, tra cui una banda HBM significativamente più elevata, supporto avanzato a formati numerici a bassa precisione, accelerazioni hardware dedicate a operazioni chiave e integrazione con l'ecosistema open source.

Sul piano software, Meta ha scelto di sviluppare MTIA utilizzando standard industriali ampiamente diffusi, con integrazione nativa con framework e strumenti come PyTorch, vLLM e Triton. L'infrastruttura software consente di eseguire i modelli sia su GPU tradizionali sia sugli acceleratori MTIA senza modifiche sostanziali al codice, facilitando il porting delle applicazioni e l'adozione nei sistemi di produzione.

La piattaforma include inoltre compilatori dedicati, librerie di comunicazione per sistemi multi-acceleratore e strumenti di monitoraggio e debugging progettati per gestire infrastrutture composte da centinaia di migliaia di dispositivi.

Meta sottolinea che MTIA non sostituirà completamente le soluzioni di altri produttori. L'azienda continuerà infatti a utilizzare un portafoglio eterogeneo di acceleratori, combinando hardware proprietario con chip di fornitori esterni.

Le specifiche tecniche e le prestazioni diffuse da Meta - Clicca per ingrandire

Secondo l'azienda, questo approccio permette di adattare l'infrastruttura ai diversi tipi di carico di lavoro e di evolvere rapidamente insieme ai modelli di intelligenza artificiale, che stanno cambiando più velocemente dei tradizionali cicli di sviluppo hardware.

Wi-Fi 7 con il design di una vetta innevata: ecco il nuovo sistema mesh di Huawei

Wi-Fi 7 con il design di una vetta innevata: ecco il nuovo sistema mesh di Huawei Core Ultra 7 270K Plus e Core Ultra 7 250K Plus: Intel cerca il riscatto ma ci riesce in parte

Core Ultra 7 270K Plus e Core Ultra 7 250K Plus: Intel cerca il riscatto ma ci riesce in parte PC Specialist Lafité 14 AI AMD: assemblato come vuoi tu

PC Specialist Lafité 14 AI AMD: assemblato come vuoi tu Musica generativa, arriva Lyria 3 Pro: ora Gemini compone brani completi

Musica generativa, arriva Lyria 3 Pro: ora Gemini compone brani completi Melania Trump scortata da un robot umanoide alla Casa Bianca. Il video è virale

Melania Trump scortata da un robot umanoide alla Casa Bianca. Il video è virale HONOR 600: nuove conferme sulle specifiche del nuovo mid-range con batteria enorme

HONOR 600: nuove conferme sulle specifiche del nuovo mid-range con batteria enorme Blade 16: Razer sostituisce AMD con Intel, e i prezzi volano

Blade 16: Razer sostituisce AMD con Intel, e i prezzi volano Solo 649 con coupon: questa e-bike da città HillMiles ha 100 km di autonomia, batteria rimovibile IP65 ed è in offerta in 3 colori

Solo 649 con coupon: questa e-bike da città HillMiles ha 100 km di autonomia, batteria rimovibile IP65 ed è in offerta in 3 colori Arriva AI Dividend: 1.000 dollari al mese per chi ha perso il lavoro a causa dell'intelligenza artificiale

Arriva AI Dividend: 1.000 dollari al mese per chi ha perso il lavoro a causa dell'intelligenza artificiale Forza Horizon 6 sorprende con requisiti PC accessibili e supporto al gaming handheld fin dal lancio

Forza Horizon 6 sorprende con requisiti PC accessibili e supporto al gaming handheld fin dal lancio Smart TV QLED 50'' a un super prezzo: 4K, 120Hz e HDMI 2.1 tornano a 249 con Google TV e DAZN gratuito per 6 mesi

Smart TV QLED 50'' a un super prezzo: 4K, 120Hz e HDMI 2.1 tornano a 249 con Google TV e DAZN gratuito per 6 mesi Crypto, GPU e miliardi: la causa che mette NVIDIA all'angolo entra nel vivo

Crypto, GPU e miliardi: la causa che mette NVIDIA all'angolo entra nel vivo Gap e Google portano l'acquisto conversazionale a un nuovo livello: si potranno acquistare vestiti all'interno di Gemini

Gap e Google portano l'acquisto conversazionale a un nuovo livello: si potranno acquistare vestiti all'interno di Gemini DLSS 5 è qui per restare: ecco cosa ha detto il director di Kingdom Come: Deliverance 2

DLSS 5 è qui per restare: ecco cosa ha detto il director di Kingdom Come: Deliverance 2 Un PC HP tuttofare a 649 imperdibile: 32GB di RAM, 1TB SSD, Intel Core i5, ma solo 9 pezzi

Un PC HP tuttofare a 649 imperdibile: 32GB di RAM, 1TB SSD, Intel Core i5, ma solo 9 pezzi I leader di Meta, NVIDIA e Google entrano nel consiglio tecnologico di Trump per guidare le politiche su AI e innovazione

I leader di Meta, NVIDIA e Google entrano nel consiglio tecnologico di Trump per guidare le politiche su AI e innovazione Dreame vs ECOVACS: 4 robot aspirapolvere super interessanti in offerta su Amazon, da 379 a 649

Dreame vs ECOVACS: 4 robot aspirapolvere super interessanti in offerta su Amazon, da 379 a 649

2 Commenti

Gli autori dei commenti, e non la redazione, sono responsabili dei contenuti da loro inseriti - infosono lo stesso chip messo assieme piu e piu volte lo hanno anche scritto è una soluzione modulare, aggiungi moduli aggiungi performance

Devi effettuare il login per poter commentare

Se non sei ancora registrato, puoi farlo attraverso questo form.

Se sei già registrato e loggato nel sito, puoi inserire il tuo commento.

Si tenga presente quanto letto nel regolamento, nel rispetto del "quieto vivere".