Meta blocca i chatbot AI con personalità per adolescenti: troppi rischi in termini di sicurezza

Meta ha sospeso l'accesso degli adolescenti ai chatbot AI con personalità dedicate, citando la necessità di migliorare sicurezza e controlli parentali. La decisione segue segnalazioni di consigli dannosi e un'indagine FTC

di Francesco Messina pubblicata il 26 Gennaio 2026, alle 12:01 nel canale WebMeta

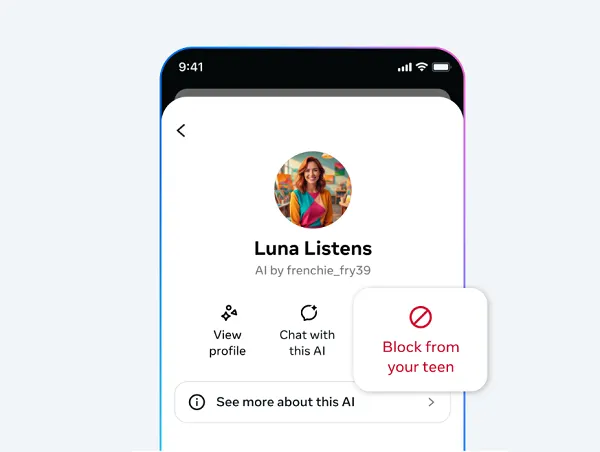

Meta ha deciso di bloccare temporaneamente l'accesso degli adolescenti ai chatbot AI con personalità dedicate, una mossa che evidenzia crescenti preoccupazioni sulla sicurezza e sull'impatto di queste tecnologie sui più giovani. La decisione, annunciata a fine gennaio 2026, arriva mentre l'azienda lavora a una nuova versione dei suoi "AI characters", pensata per offrire maggiori tutele e un controllo più rigoroso sull'utilizzo.

Il provvedimento nasce da timori già emersi nei mesi precedenti. Alcuni chatbot AI, non solo di Meta, sono stati accusati di fornire consigli potenzialmente pericolosi a utenti minorenni, spaziando dall'autolesionismo ai disturbi alimentari, fino a suggerimenti su come acquistare droghe e nasconderle ai genitori. Questi episodi hanno spinto la Federal Trade Commission (FTC) ad avviare un'indagine sui rischi legati all'interazione con chatbot generativi.

Già a ottobre, Meta aveva introdotto strumenti di controllo parentale per limitare l'accesso dei teen agli AI bot, ma ora l'azienda ha scelto una linea più drastica: sospendere del tutto l'accesso agli AI characters per gli adolescenti, lasciando disponibile solo il chatbot principale Meta AI. Il blocco riguarderà sia gli utenti che hanno dichiarato un'età adolescenziale, sia coloro che, pur dichiarandosi adulti, vengono identificati come teen tramite sistemi di previsione dell'età.

Per Meta il ban di alcuni account è necessario per ampliare l'esperienza

Secondo Meta, la sospensione è necessaria per completare lo sviluppo di una nuova esperienza AI più sicura, che consentirà ai genitori maggiore visibilità e controllo sulle interazioni dei figli. Tuttavia, il linguaggio utilizzato dall'azienda suggerisce implicitamente che esistano falle significative nei sistemi attuali, soprattutto considerando la pressione esercitata dall'indagine FTC.

Il contesto rende la scelta ancora più delicata. Uno studio pubblicato nel luglio scorso ha rilevato che il 72% degli adolescenti statunitensi ha già utilizzato un "AI companion", spesso instaurando interazioni regolari con queste entità virtuali. Questo dato entra in conflitto con la strategia di Meta, che punta a popolare le sue piattaforme con numerosi bot dotati di personalità per aumentare il coinvolgimento degli utenti.

Il problema di fondo è strutturale: i chatbot apprendono da enormi quantità di dati online e possono essere facilmente indotti a fornire risposte indesiderate, soprattutto da utenti giovani e digitalmente esperti. Proteggere completamente queste interazioni è estremamente complesso, se non impossibile.

PNY RTX 5080 Slim OC, sembra una Founders Edition ma non lo è

PNY RTX 5080 Slim OC, sembra una Founders Edition ma non lo è Wi-Fi 7 con il design di una vetta innevata: ecco il nuovo sistema mesh di Huawei

Wi-Fi 7 con il design di una vetta innevata: ecco il nuovo sistema mesh di Huawei Core Ultra 7 270K Plus e Core Ultra 7 250K Plus: Intel cerca il riscatto ma ci riesce in parte

Core Ultra 7 270K Plus e Core Ultra 7 250K Plus: Intel cerca il riscatto ma ci riesce in parte L'AI agentica potrebbe trasformare Internet: il settore della pubblicità online è a rischio?

L'AI agentica potrebbe trasformare Internet: il settore della pubblicità online è a rischio? Qualcomm lancerà due chip per smartphone Android a 2 nm nel 2026: ecco le possibili differenze

Qualcomm lancerà due chip per smartphone Android a 2 nm nel 2026: ecco le possibili differenze_160.jpg) Xiaomi dà i numeri: ecco come è andato il 2025 dell'azienda tra smartphone, tablet, accessori e auto elettriche

Xiaomi dà i numeri: ecco come è andato il 2025 dell'azienda tra smartphone, tablet, accessori e auto elettriche AMD annuncia Ryzen 9 9950X3D2 Dual Edition: primo Zen 5 con doppio 3D V-Cache e TDP a 200W

AMD annuncia Ryzen 9 9950X3D2 Dual Edition: primo Zen 5 con doppio 3D V-Cache e TDP a 200W CyrusOne avvia la costruzione del suo primo data center in Italia, a Milano

CyrusOne avvia la costruzione del suo primo data center in Italia, a Milano Cloud in crescita, ma ladozione dellIA resta lenta. Lidentikit delle PMI italiane secondo Wolters Kluwer Italia

Cloud in crescita, ma ladozione dellIA resta lenta. Lidentikit delle PMI italiane secondo Wolters Kluwer Italia OpenAI cancella l'adult mode di ChatGPT: il riassetto strategico miete un'altra vittima

OpenAI cancella l'adult mode di ChatGPT: il riassetto strategico miete un'altra vittima Google Search Live arriva in Italia: la ricerca ora ci vede e ci parla

Google Search Live arriva in Italia: la ricerca ora ci vede e ci parla MacBook Air 15'' con chip M4 (2025) crolla su Amazon: il prezzo che stavamo cercando è finalmente realtà

MacBook Air 15'' con chip M4 (2025) crolla su Amazon: il prezzo che stavamo cercando è finalmente realtà Ora è possibile trasferire file tra Samsung e Apple con AirDrop e Quick Share. Ecco come fare

Ora è possibile trasferire file tra Samsung e Apple con AirDrop e Quick Share. Ecco come fare Apple domina con il MacBook Neo: i laptop Windows faticano a tenere il passo

Apple domina con il MacBook Neo: i laptop Windows faticano a tenere il passo Arriva la nuova gamma di PC Dell Pro per utenti aziendali: nuovi notebook, desktop e workstation portatili

Arriva la nuova gamma di PC Dell Pro per utenti aziendali: nuovi notebook, desktop e workstation portatili DJI Avata 360: la recensione del primo drone FPV 8K con sensori da 1 pollice

DJI Avata 360: la recensione del primo drone FPV 8K con sensori da 1 pollice Il browser di Samsung arriva su Windows, ma in Italia non c'è l'IA agentica

Il browser di Samsung arriva su Windows, ma in Italia non c'è l'IA agentica

0 Commenti

Gli autori dei commenti, e non la redazione, sono responsabili dei contenuti da loro inseriti - infoDevi effettuare il login per poter commentare

Se non sei ancora registrato, puoi farlo attraverso questo form.

Se sei già registrato e loggato nel sito, puoi inserire il tuo commento.

Si tenga presente quanto letto nel regolamento, nel rispetto del "quieto vivere".