NemoClaw è la soluzione di NVIDIA basata su OpenClaw per l'AI agentica: maggiore sicurezza e semplicità

Alla GTC 2026, NVIDIA ha svelato NemoClaw, stack basato su OpenClaw per agenti AI auto-evolutivi. Integrando il runtime di sicurezza OpenShell e i nuovi sistemi DGX Spark e Station con chip Blackwell, NVIDIA trasforma il PC in una centrale autonoma capace di pianificare missioni complesse, proteggendo privacy e dati sensibili.

di Manolo De Agostini pubblicata il 17 Marzo 2026, alle 11:21 nel canale WebNVIDIA

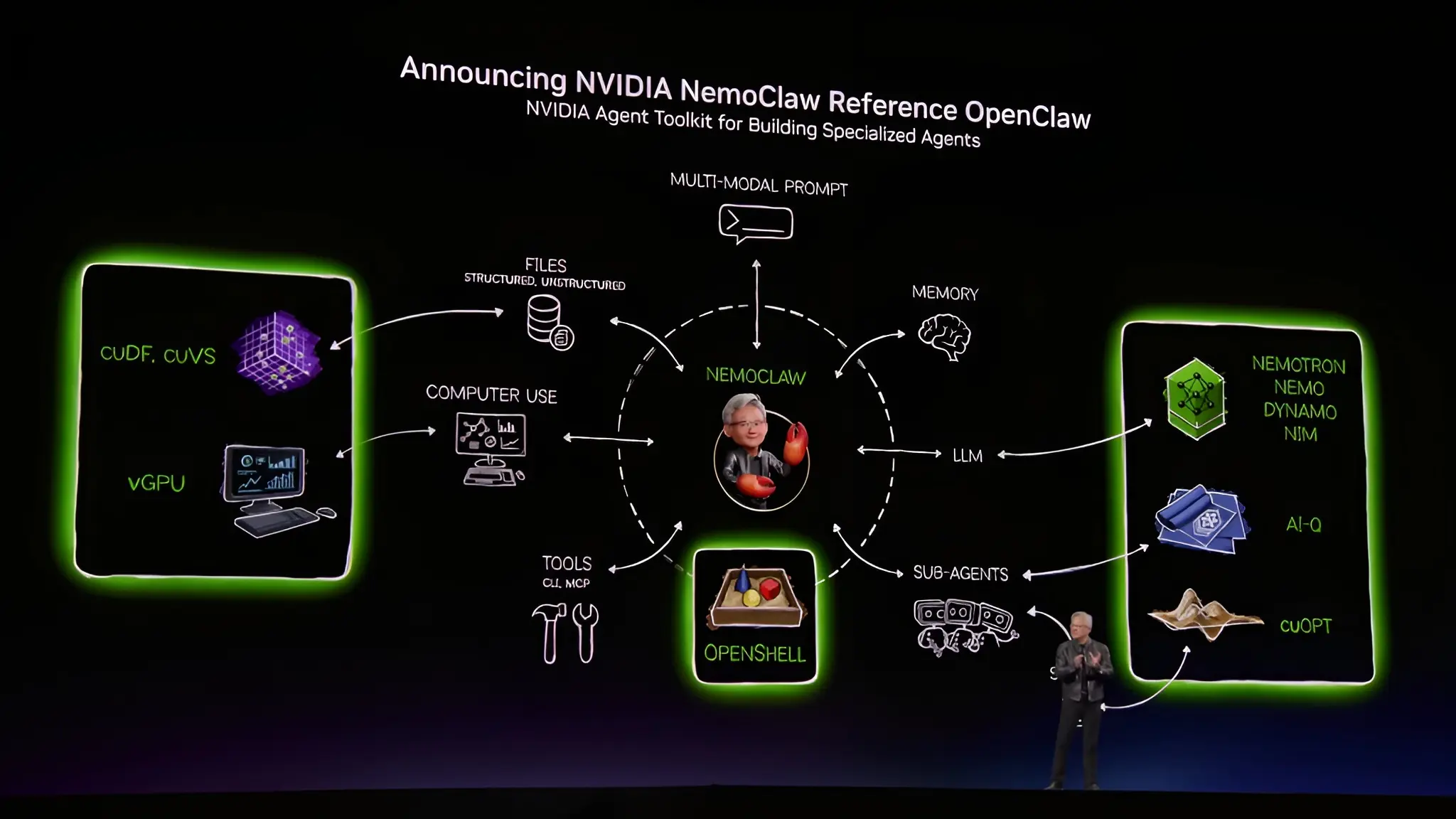

Nel corso della GTC 2026, NVIDIA ha presentato una serie di novità dedicate allo sviluppo di agenti AI autonomi, una categoria di applicazioni che l'azienda considera il prossimo livello evolutivo dell'intelligenza artificiale. Al centro degli annunci figurano il nuovo NVIDIA Agent Toolkit, il runtime di sicurezza OpenShell e l'integrazione con l'ecosistema OpenCLAW, oltre a nuovi aggiornamenti per le piattaforme DGX Spark e DGX Station.

Secondo NVIDIA, l'emergere di sistemi agentici - definiti come agenti software capaci di pianificare, eseguire compiti e perseguire obiettivi complessi in autonomia - sta cambiando il modo in cui l'AI viene utilizzata. In questo modello, l'utente non fornisce più soltanto istruzioni puntuali o prompt specifici, ma può assegnare missioni complete come la creazione di software o l'esecuzione di attività articolate.

Per supportare questo paradigma, NVIDIA ha introdotto Agent Toolkit, una raccolta di modelli open, strumenti di sviluppo, runtime e blueprint destinati alla creazione e alla valutazione di agenti autonomi di lunga durata. La piattaforma si basa su diversi componenti dell'ecosistema NVIDIA:

- modelli Nemotron open source, pensati per compiti di ragionamento, programmazione, analisi documentale, visione e speech

- NeMo, utilizzato per profiling, personalizzazione e ottimizzazione degli agenti

- NIM, dedicato all'inferenza dei modelli

- Dynamo, pensato per la scalabilità dei carichi di lavoro

Tra le nuove funzionalità compare anche COOP, un sistema che consente agli agenti di affrontare problemi di ottimizzazione espressi in linguaggio naturale.

Uno degli elementi più rilevanti annunciati da NVIDIA è OpenShell, un runtime open source progettato per gestire la sicurezza e l'accesso alle risorse degli agenti autonomi.

Gli agenti AI di nuova generazione possono infatti interagire con dati sensibili, servizi esterni e strumenti software. Questo introduce rischi legati a escalation di privilegi, accessi non autorizzati o uso improprio delle informazioni. OpenShell si propone quindi come livello infrastrutturale che permette agli agenti di operare in modo produttivo, applicando al contempo policy di sicurezza, controlli di rete e protezioni della privacy. In particolare, il runtime introduce un ambiente isolato (sandbox) e un sistema di controlli basati su policy che fungono da "guardrail" per limitare comportamenti non sicuri.

Inoltre, come da previsioni, NVIDIA ha annunciato NemoClaw, la propria implementazione per l'ecosistema OpenClaw, una piattaforma open dedicata allo sviluppo di agenti autonomi auto-evolutivi.

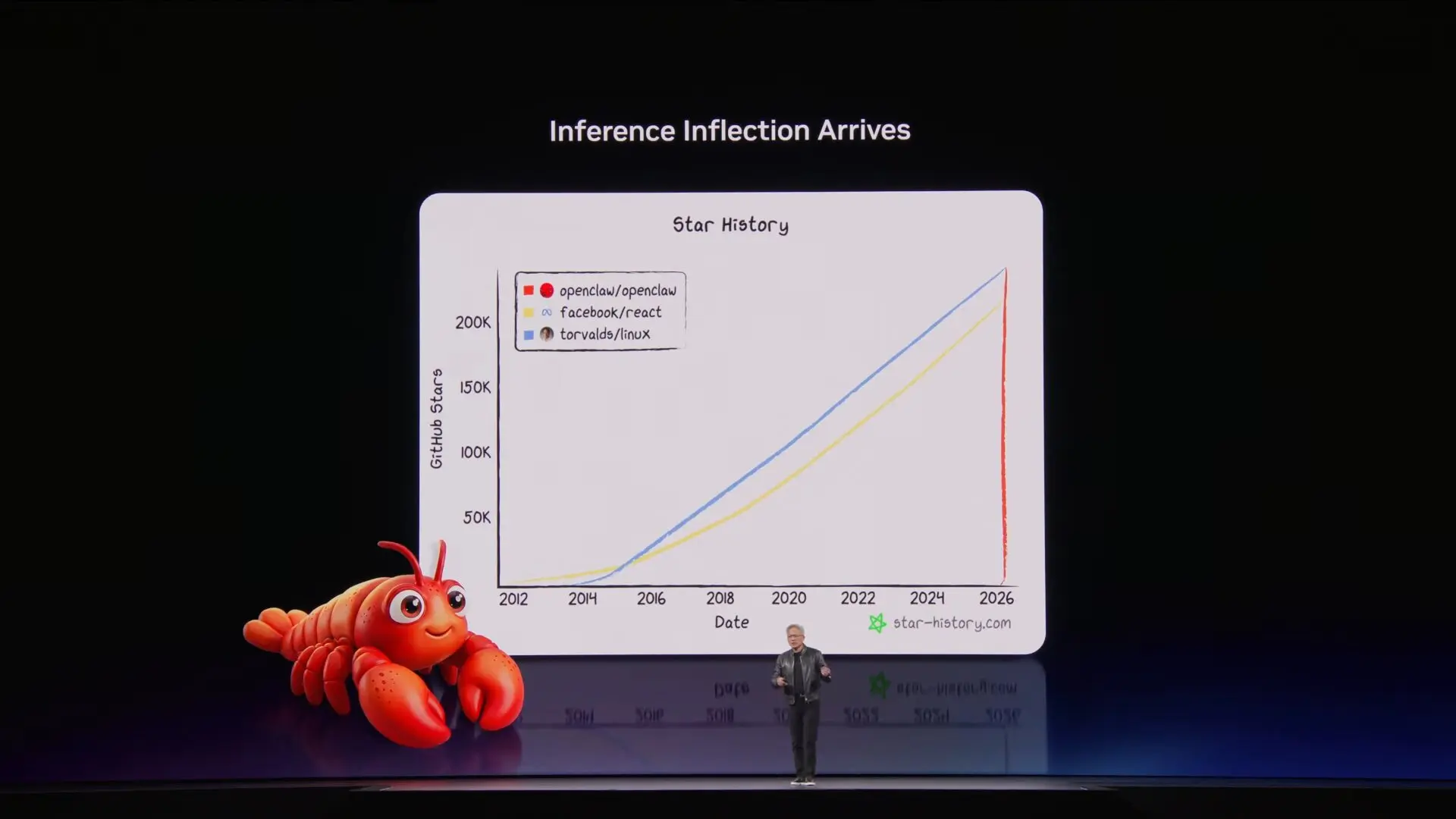

Il progetto nasce dalla collaborazione con la comunità OpenClaw e con il suo sviluppatore Peter Steinberger. L'obiettivo dichiarato è rendere questi agenti più affidabili, scalabili e accessibili. Non a caso, Jensen Huang ha definito OpenClaw "il sistema operativo della personal AI", paragonandolo al ruolo che macOS e Windows hanno avuto per il personal computing, parlando di una nuova "rinascita del software".

NVIDIA vede OpenClaw come un vero punto di partenza per l'agentic AI, arrivando a paragonarne l'impatto a quello di HTML nello sviluppo del web: una piattaforma destinata a standardizzare e diffondere l'uso di molteplici agenti AI in diversi ambiti applicativi, dal coding all'ingegneria fino ai flussi enterprise.

NemoClaw rappresenta uno stack completo che consente di installare OpenClaw, i modelli Nemotron e il runtime OpenShell tramite un singolo comando. L'integrazione con NVIDIA Agent Toolkit permette inoltre di ottimizzare automaticamente l'ambiente di esecuzione.

L'ambiente risultante introduce un livello infrastrutturale finora mancante per gli agenti autonomi: da un lato fornisce accesso alle risorse necessarie per operare, dall'altro applica controlli di sicurezza, rete e privacy basati su policy.

Dal punto di vista operativo, NemoClaw è progettato per essere flessibile: può utilizzare qualsiasi coding agent e sfruttare modelli open eseguiti in locale - come i Nemotron - su sistemi dedicati. Allo stesso tempo, grazie a un "privacy router", gli agenti possono accedere anche a modelli di frontiera in cloud, combinando quindi risorse locali e remote. Questo approccio ibrido consente agli agenti di apprendere nuove competenze e completare task complessi rispettando vincoli di sicurezza e privacy.

La soluzione è progettata per funzionare su diverse piattaforme dedicate, tra cui PC con GPU GeForce RTX, workstation RTX PRO, DGX Station e DGX Spark, permettendo di eseguire agenti sempre attivi ("always-on") su hardware locale.

NVIDIA ha posto particolare attenzione alla piattaforma DGX Spark, pensata per rendere lo sviluppo di agenti autonomi più accessibile agli sviluppatori che preferiscono lavorare in ambienti locali. Il sistema si basa sul Superchip GB10 Grace Blackwell, dotato di Tensor Core Blackwell e supporto al formato dati FP4. Secondo NVIDIA, la piattaforma è in grado di raggiungere fino a un petaflop di prestazioni AI in FP4, valore utile per elaborare prompt molto estesi e gestire richieste concorrenti provenienti da più agenti.

La crescente complessità dei flussi agentici richiede infatti finestre di contesto molto ampie - fino a un milione di token - e la capacità di gestire più prompt contemporaneamente.

Tra le novità software annunciate per DGX Spark figura anche un aggiornamento che estende le capacità di clustering: sarà infatti possibile collegare fino a quattro sistemi (contro i due supportati ufficialmente in precedenza) sfruttando interconnessioni basate su networking ConnectX a 200 GbE. Questo consente di creare configurazioni più scalabili, verosimilmente con topologia a stella, per eseguire più modelli e agenti in parallelo mantenendo i dati in locale.

DGX Spark è un sistema pensato come "AI supercomputer" desktop compatto, rivolto a sviluppatori, data scientist e team di ricerca per prototipazione, fine-tuning e inferenza locale di modelli di grandi dimensioni. Il suo utilizzo è particolarmente interessante per startup e ambienti enterprise che vogliono evitare fin da subito il ricorso a infrastrutture cloud o data center. All'evento sono stati annunciati anche nuovi modelli compatibili con DGX Spark, molti dei quali ottimizzati per il formato NVFP4 al fine di migliorare efficienza e prestazioni sul GB10: Nemotron Super V3-120B (NVFP4) con finestra di contesto fino a 1 milione di token, Nemotron-3-Nano-30B-A3B-Omni, Nemotron Nano v2.1 4B, FLUX.2 Klein per la generazione di immagini, LTX 2.3 22B per la generazione video, Qwen 3.5 multimodale e Sinistea (NVFP4).

Sono inoltre previsti nuovi playbook e guide pratiche per sviluppatori, che riflettono l'evoluzione verso workflow agentici complessi. Tra questi figurano playbook dedicati a OpenClaw e OpenShell, oltre a scenari come LM Studio su DGX Spark, CLI Coding Agent, speculative decoding su sistemi dual DGX Spark, robotica (es. Reachy Photo Booth) e ottimizzazione kernel (cuTile).

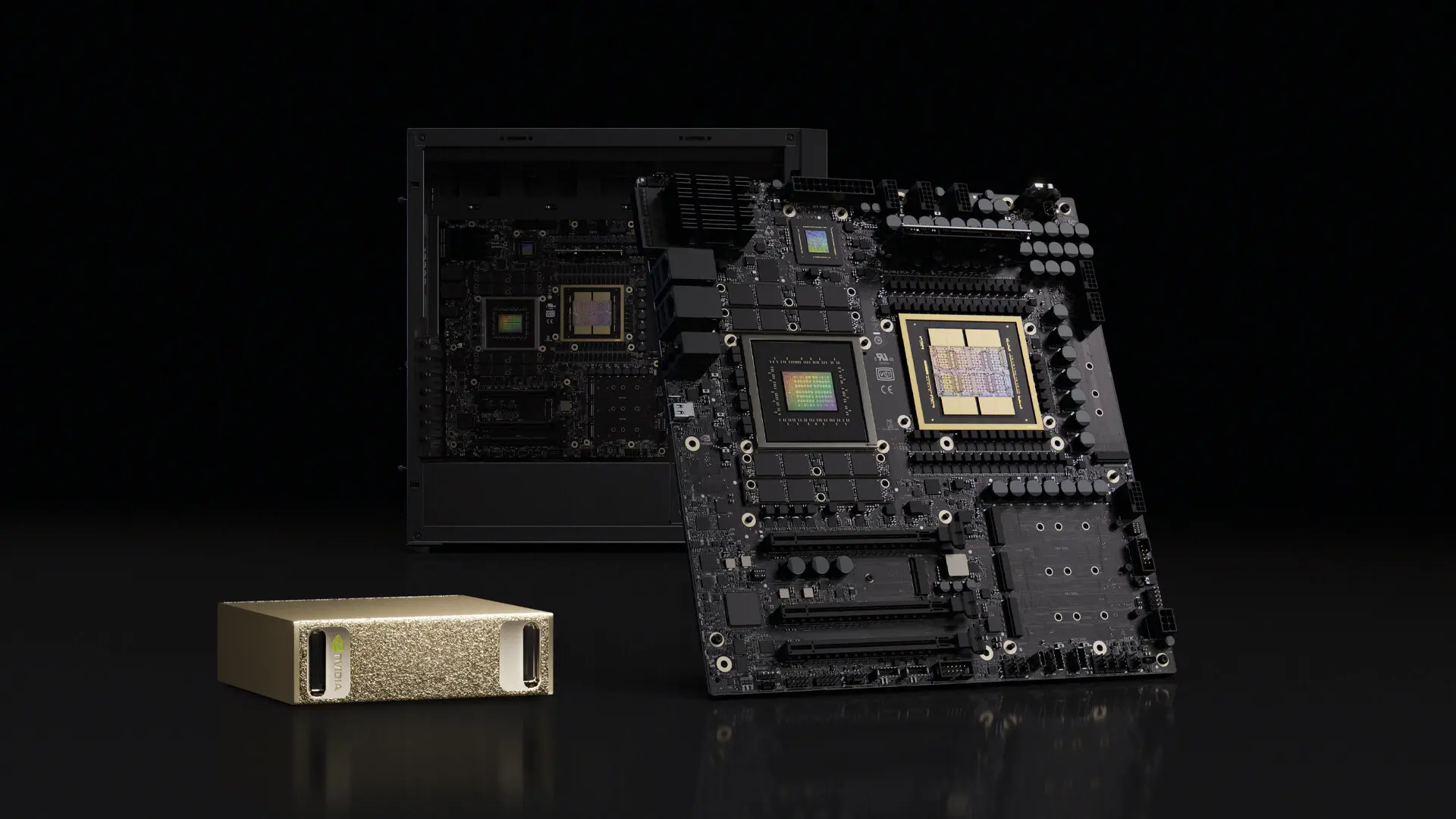

Se DGX Spark non bastasse, NVIDIA propone DGX Station, descritta come la piattaforma di riferimento per la creazione e l'esecuzione di agenti avanzati, che compie un salto netto in termini di architettura e prestazioni. Le nuove DGX Station portano infatti su desktop il Superchip GB300 Grace Blackwell Ultra, lo stesso utilizzato nei sistemi datacenter NVIDIA. Si tratta di una soluzione che combina due GPU Blackwell in un unico package con 288 GB di memoria HBM3E, collegate tramite interconnessione NVLink-C2C a 900 GB/s a una CPU Grace con 72 core Arm Neoverse-V2 e 496 GB di memoria LPDDR5X.

Nel complesso, il sistema arriva a offrire fino a 784 GB di memoria totale e una potenza di calcolo dichiarata pari a 20 PetaFLOPS in FP4 (con sparsity).

Queste caratteristiche permettono di eseguire in locale modelli linguistici fino a 1 trilione di parametri, portando capacità tipicamente da datacenter direttamente sulla scrivania degli sviluppatori. Le DGX Station possono inoltre essere utilizzate non solo come workstation standalone, ma anche come nodi "on-demand" accessibili in remoto da team di sviluppo, grazie alla compatibilità architetturale con le infrastrutture datacenter NVIDIA.

Dal punto di vista software, il sistema supporta un ampio ecosistema di strumenti e modelli, inclusi framework e piattaforme diffuse come Docker, Red Hat, JetBrains, Ollama, llama.cpp, ComfyUI e Weights & Biases, oltre a modelli avanzati come Nemotron, Qwen, Mistral e altre soluzioni di frontiera.

Il tutto ha però un costo energetico non trascurabile: NVIDIA indica un consumo massimo di circa 1.600 watt, rendendo necessarie configurazioni elettriche adeguate, soprattutto in ambito professionale.Le DGX Station saranno inizialmente disponibili tramite partner come ASUS, Dell, Gigabyte, MSI e Supermicro (con HP attesa successivamente), mentre NVIDIA non commercializzerà direttamente una propria versione. I preordini sono già partiti, ma le consegne sono previste nei prossimi mesi e i prezzi - non ancora ufficiali - si collocheranno con ogni probabilità in fascia decisamente elevata.

Wi-Fi 7 con il design di una vetta innevata: ecco il nuovo sistema mesh di Huawei

Wi-Fi 7 con il design di una vetta innevata: ecco il nuovo sistema mesh di Huawei Core Ultra 7 270K Plus e Core Ultra 7 250K Plus: Intel cerca il riscatto ma ci riesce in parte

Core Ultra 7 270K Plus e Core Ultra 7 250K Plus: Intel cerca il riscatto ma ci riesce in parte PC Specialist Lafité 14 AI AMD: assemblato come vuoi tu

PC Specialist Lafité 14 AI AMD: assemblato come vuoi tu I leader di Meta, NVIDIA e Google entrano nel consiglio tecnologico di Trump per guidare le politiche su AI e innovazione

I leader di Meta, NVIDIA e Google entrano nel consiglio tecnologico di Trump per guidare le politiche su AI e innovazione Dreame vs ECOVACS: 4 robot aspirapolvere super interessanti in offerta su Amazon, da 379 a 649

Dreame vs ECOVACS: 4 robot aspirapolvere super interessanti in offerta su Amazon, da 379 a 649 Xiaomi esagera: in sviluppo uno smartphone con batteria da 10.000 mAh

Xiaomi esagera: in sviluppo uno smartphone con batteria da 10.000 mAh Anche Enel potrebbe avere un suo operatore virtuale di telefonia mobile

Anche Enel potrebbe avere un suo operatore virtuale di telefonia mobile Il nuovo OnePlus Nord 6 con batteria da 9.000 mAh ha una data di lancio ufficiale

Il nuovo OnePlus Nord 6 con batteria da 9.000 mAh ha una data di lancio ufficiale iPhone 18 Pro, il Face ID sotto al display non funziona: la Dynamic Island resterà

iPhone 18 Pro, il Face ID sotto al display non funziona: la Dynamic Island resterà Aumenti in arrivo per ASUS: i computer potrebbero costare fino al 30% in più

Aumenti in arrivo per ASUS: i computer potrebbero costare fino al 30% in più L'esperimento BASE del CERN è riuscito a trasportare dell'antimateria

L'esperimento BASE del CERN è riuscito a trasportare dell'antimateria Afeela è morta: chiusa definitivamente la collaborazione tra Sony e Honda per gli EV premium

Afeela è morta: chiusa definitivamente la collaborazione tra Sony e Honda per gli EV premium Intel BOT altera i risultati, Geekbench invita a non fidarsi dei risultati delle CPU che lo supportano

Intel BOT altera i risultati, Geekbench invita a non fidarsi dei risultati delle CPU che lo supportano Intel e AMD faticano a soddisfare la domanda consumer: CPU introvabili e attese fino a sei mesi

Intel e AMD faticano a soddisfare la domanda consumer: CPU introvabili e attese fino a sei mesi Microsoft e NVIDIA insieme per dare una scossa allo sviluppo del nucleare: l'IA per accelerare i tempi

Microsoft e NVIDIA insieme per dare una scossa allo sviluppo del nucleare: l'IA per accelerare i tempi Ring rinnova l'intera gamma video: 4K su batteria, PoE e nuovo caricatore solare tra le novità

Ring rinnova l'intera gamma video: 4K su batteria, PoE e nuovo caricatore solare tra le novità Recensione Galaxy Buds4 Pro: le cuffie Samsung più belle e intelligenti

Recensione Galaxy Buds4 Pro: le cuffie Samsung più belle e intelligenti

6 Commenti

Gli autori dei commenti, e non la redazione, sono responsabili dei contenuti da loro inseriti - infodipende dai costi ma per uno studio sarebbe molto più bello avere una IA locale che lavora in locale senza spostare dati su server esterni e condividerli..

1.600W sono però una follia.. pensa se lavorasse 24/7 che costi anche solo a 1 kW medio.. 9 mila kWh/anno -> 2.700 euro di sola corrente elettrica + costo servizi..

1.600W sono però una follia.. pensa se lavorasse 24/7 che costi anche solo a 1 kW medio.. 9 mila kWh/anno -> 2.700 euro di sola corrente elettrica + costo servizi..

2700 euro annui a prestazioni ragionevoli costano quanto una subscription di media taglia per un paio di dipendenti. facciamo 3 va, stiamo larghi.

non è tutto sto costo

metti 6000 una tantum per l' acquisto e 5000 + 1 mese per il fine tuning e reinforcement aziendale a partire da un base model open source

se le prestazioni sono dignitose, e questo è tutto da vedere, a questi prezzi ne vendono a camionate

mettici pure poi che l'elettricità in giro tende a costare meno che non in italia

non è tutto sto costo

metti 6000 una tantum per l' acquisto e 5000 + 1 mese per il fine tuning e reinforcement aziendale a partire da un base model open source

se le prestazioni sono dignitose, e questo è tutto da vedere, a questi prezzi ne vendono a camionate

mettici pure poi che l'elettricità in giro tende a costare meno che non in italia

come ho detto deve essere interessante come soluzione ma non è indolore visto i costi non irrilevanti anche perchè non prendi una IA di questo tipo che SOSTITUIRE dei dipendenti ma per affiancarla ai dipendenti

è da folli usare le IA senza supervisione per cui sarebbe un maggior costo che si ipotizza porti ad una maggiore produttività e non un minor costo eliminando personale per pregare che non faccia cazzate...

piccolo esempio.. oggi ho chiesto il comune di nascita a copilot partendo dal codice fiscale.. anche un "bambino" sa come si fa e copilot ha sbagliato 3 volte il comune sparando a caso.. prima ha detto che era nata nel comune dove sono io.. forse partiva dal concetto che se io sono qui allora anche la persona di cui parlavo fosse nata qui.. poi ha sparato un comune a caso e credo che abbia preso il comune del sito della fattura che avevo aperto e poi finalmente ha deciso di fare il cotnrollo e ha preso un comune VICINO a quello giusto.. per inciso il comune giusto era Napoli.. non un comune sconosciuto e dal codice fiscale era ovvio visto che nel CF c'è il codice catastale del comune.

è solo uno dei mille mila esempi di errori banali che fanno le IA lasciate a se stesse.. anche per l'estrazione dei dati da fattura preferiamo sempre fare un secondo controllo umano per essere certi di lavorare sui dati corretti e non "molto simili al giusto" nonostante sia stato detto all'IA di non fare conteggi ma di usare i dati come sono in fattura senza elaborazioni..

si possono fare algoritmi migliori ? ma certo.. smetteresti di controllarli se il tuo stipendio dipendesse dagli errori ?.. io no..

certo non li regalano sti cosi. quello che voglio dire è che è un prezzo in linea con il costo che oggi giorno già la stragrande maggioranza delle software house sostiene (dico software house perché quelle conosco). Una piccola SH con 20 programmatori, 20-50K/anno li mette già in IA oggi, è contro quel budget che si fa il conto, non contro zero.

poi ovvio che dipende dal settore, dal tipo di lavoro che gli si dà e mille altre cose

Non parlo di sostituire nessuno o lasciare lagente AI pascolare libero senza supervisione. parlo solo di usare tool del genere da rete locale per fare quello che le IA attuali già fanno bene: pattern matching, produzione di testo, computer vision e sbobinamento audio.

se quel che perdi in prestazioni lo guadagni in riservatezza, per molti il gioco varrà la candela

analisi conversazionali call center e supporti vari, business intelligence su grosso aggregati di dati, automazione dei followup ticket/clienti & co, scrematura immagini mediche da segmentare, settori imbrigliati finanza/medicale/difesa, tanto ciarpame da risorse umane e via dicendo.

è pieno di cose da fare a medio-basso valore per il tempo che richiedono ma che tuttavia sono soggette a vincoli di riservatezza più o meno stringenti.

È letteralmente lo scenario duso degli agenti IA: fai un pre-training sui processi aziendali e poi con poco input lagente se la sbroglia più o meno, se ti richiede 10min tra correzioni e supervisione, lo misuri contro lalternativa di fare tutto a mano e contro quella di pagarsi un agente cloud, e vedi se conviene o meno. sicuro non ci puoi fare tutto, sicuro non sono né perfetti né autonomi, ma di scenari in cui convengono nonostante tutto ce ne sono comunque a bizzeffe

Devi effettuare il login per poter commentare

Se non sei ancora registrato, puoi farlo attraverso questo form.

Se sei già registrato e loggato nel sito, puoi inserire il tuo commento.

Si tenga presente quanto letto nel regolamento, nel rispetto del "quieto vivere".