AWS e Cerebras uniscono le forze: nuova architettura per accelerare l'inferenza AI nel cloud

AWS e Cerebras collaboreranno per portare nel cloud una nuova infrastruttura di inferenza AI basata su architettura disaggregata. Il sistema combinerà chip Trainium per l'elaborazione dei prompt e sistemi CS-3 per la generazione dei token. Obiettivo? Altissime prestazioni.

di Manolo De Agostini pubblicata il 15 Marzo 2026, alle 15:01 nel canale MercatoCerebrasAmazon Web ServicesAWS

Amazon Web Services ha annunciato una collaborazione con Cerebras Systems per sviluppare una nuova infrastruttura destinata ad accelerare l'inferenza dei modelli di intelligenza artificiale generativa nel cloud. La soluzione sarà integrata nella piattaforma Amazon Bedrock e sfrutterà una combinazione di processori Trainium sviluppati da Amazon e sistemi CS-3 basati sulla tecnologia wafer-scale di Cerebras.

L'obiettivo dichiarato è affrontare uno dei principali colli di bottiglia dell'AI moderna: la velocità con cui i modelli linguistici di grandi dimensioni riescono a generare risposte durante l'esecuzione, soprattutto in applicazioni interattive come assistenti di programmazione, chatbot avanzati o sistemi agentici.

Secondo AWS, la piattaforma sarà distribuita nei dat center dell'azienda e resa disponibile nei prossimi mesi attraverso Bedrock, mentre un'offerta commerciale più ampia basata su questa architettura è prevista nel corso della seconda metà del 2026.

Il progetto si basa su un approccio definito "inference disaggregation", che separa il processo di inferenza in due fasi distinte: Prefill, ovvero l'elaborazione del prompt inviato dall'utente e la preparazione del contesto per il modello

Le due operazioni presentano caratteristiche computazionali differenti. Il prefill è altamente parallelizzabile e richiede notevole potenza di calcolo, ma una banda di memoria moderata. Il decode, invece, è intrinsecamente seriale e dipende fortemente dalla larghezza di banda della memoria, perché ogni token deve essere generato uno dopo l'altro.

In molti casi proprio il decode rappresenta la parte più lenta dell'inferenza, soprattutto nei modelli di ragionamento che generano sequenze più lunghe mentre elaborano una risposta.

Per questo AWS e Cerebras hanno scelto di ottimizzare separatamente le due fasi: i processori Trainium si occupano del prefill, mentre i sistemi Cerebras CS-3 gestiscono la generazione dei token. Il collegamento tra le due componenti avviene tramite Elastic Fabric Adapter (EFA), una tecnologia di networking ad alta velocità utilizzata nei cluster HPC di AWS.

Tra i partner che hanno annunciato l'uso della piattaforma figurano Anthropic, che ha scelto AWS come principale infrastruttura per il training dei propri modelli, e OpenAI, che prevede di utilizzare capacità Trainium per supportare carichi di lavoro legati ai modelli di frontiera.

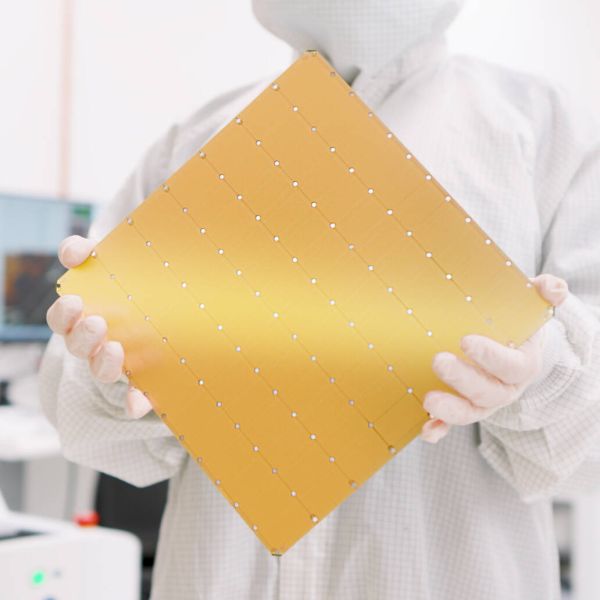

Dal lato Cerebras, il sistema CS-3 utilizza la tecnologia Wafer Scale Engine, un approccio che consiste nel realizzare un singolo chip di dimensioni simili a un wafer, per l'appunto. Questo design punta a ridurre la latenza nella comunicazione interna e a offrire una banda di memoria molto elevata, caratteristiche particolarmente utili durante la generazione sequenziale dei token.

Secondo l'azienda, il sistema può offrire una banda di memoria di gran lunga superiore a quella delle GPU tradizionali, elemento che diventa sempre più rilevante con l'aumento dei modelli di ragionamento e delle applicazioni agentiche.

AWS sostiene che la combinazione tra Trainium e CS-3 possa offrire prestazioni di inferenza fino a un ordine di grandezza superiore rispetto alle soluzioni attuali in alcuni scenari. Il vantaggio dovrebbe emergere soprattutto nelle applicazioni che richiedono interazioni rapide e iterative con l'utente, come gli strumenti di sviluppo software assistiti dall'AI.

AWS diventa il primo hyperscaler ad adottare ufficialmente la tecnologia Cerebras all'interno della propria infrastruttura cloud. Per Cerebras, che sta preparando un'IPO, la partnership con il principale provider di cloud computing rappresenta un'opportunità significativa per ampliare la diffusione della propria architettura e competere più direttamente con le soluzioni basate su GPU.

Wi-Fi 7 con il design di una vetta innevata: ecco il nuovo sistema mesh di Huawei

Wi-Fi 7 con il design di una vetta innevata: ecco il nuovo sistema mesh di Huawei Core Ultra 7 270K Plus e Core Ultra 7 250K Plus: Intel cerca il riscatto ma ci riesce in parte

Core Ultra 7 270K Plus e Core Ultra 7 250K Plus: Intel cerca il riscatto ma ci riesce in parte PC Specialist Lafité 14 AI AMD: assemblato come vuoi tu

PC Specialist Lafité 14 AI AMD: assemblato come vuoi tu Google risolve il problema della memoria negli LLM: TurboQuant fa girare gli stessi modelli con cinque volte meno RAM

Google risolve il problema della memoria negli LLM: TurboQuant fa girare gli stessi modelli con cinque volte meno RAM Un altro colpo alle auto elettriche: Panasonic taglia le batterie EV in favore di quelle per data center IA

Un altro colpo alle auto elettriche: Panasonic taglia le batterie EV in favore di quelle per data center IA Core Ultra 9 290K Plus: Intel conferma che non arriverà sul mercato

Core Ultra 9 290K Plus: Intel conferma che non arriverà sul mercato Addio connettori fusi? MSI promette di fermare tutto prima del disastro con GPU Safeguard+

Addio connettori fusi? MSI promette di fermare tutto prima del disastro con GPU Safeguard+ Basta brani fake su Spotify: la nuova funzione dà controllo totale agli artisti

Basta brani fake su Spotify: la nuova funzione dà controllo totale agli artisti OPPO Find X9 Ultra: come funziona il rivoluzionario zoom 10x Hasselblad

OPPO Find X9 Ultra: come funziona il rivoluzionario zoom 10x Hasselblad Prezzo diverso per giochi digitali e fisici: la nuova politica Nintendo divide i giocatori

Prezzo diverso per giochi digitali e fisici: la nuova politica Nintendo divide i giocatori DDR5 32GB a meno di 340: le Corsair Vengeance 6000MHz hanno buoni prezzi (visto il periodo) su Amazon

DDR5 32GB a meno di 340: le Corsair Vengeance 6000MHz hanno buoni prezzi (visto il periodo) su Amazon Harry Potter: HBO pubblica il primo trailer della serie TV e svela il nuovo volto di Hogwarts

Harry Potter: HBO pubblica il primo trailer della serie TV e svela il nuovo volto di Hogwarts Android 17 Beta 2 si allarga: la lista completa dei modelli (non solo Pixel) compatibili

Android 17 Beta 2 si allarga: la lista completa dei modelli (non solo Pixel) compatibili RDNA 4m: AMD evolve RDNA 3.5 con AI e FSR 4 per le prossime APU Ryzen?

RDNA 4m: AMD evolve RDNA 3.5 con AI e FSR 4 per le prossime APU Ryzen? Sunseeker ha un mostro per i Pro e un'intera gamma domestica: punta ai prati italiani

Sunseeker ha un mostro per i Pro e un'intera gamma domestica: punta ai prati italiani_160.jpg) Storica sentenza negli USA: Meta e Google ritenute responsabili della dipendenza da social e dei danni psicologici ai giovani

Storica sentenza negli USA: Meta e Google ritenute responsabili della dipendenza da social e dei danni psicologici ai giovani Musica generativa, arriva Lyria 3 Pro: ora Gemini compone brani completi

Musica generativa, arriva Lyria 3 Pro: ora Gemini compone brani completi

0 Commenti

Gli autori dei commenti, e non la redazione, sono responsabili dei contenuti da loro inseriti - infoDevi effettuare il login per poter commentare

Se non sei ancora registrato, puoi farlo attraverso questo form.

Se sei già registrato e loggato nel sito, puoi inserire il tuo commento.

Si tenga presente quanto letto nel regolamento, nel rispetto del "quieto vivere".