|

|

#1 |

|

Senior Member

Iscritto dal: Aug 2006

Messaggi: 14164

|

[Thread Ufficiale] NVIDIA G-SYNC: guida pratica all'uso

Visto che molti hanno dubbi/incertezze in merito ai corretti funzionamento ed impostazione del G-SYNC, ho ritenuto opportuno creare questo thread dedicato per discutere di questa tecnologia. Consigli e suggerimenti sono, ovviamente, ben accetti.

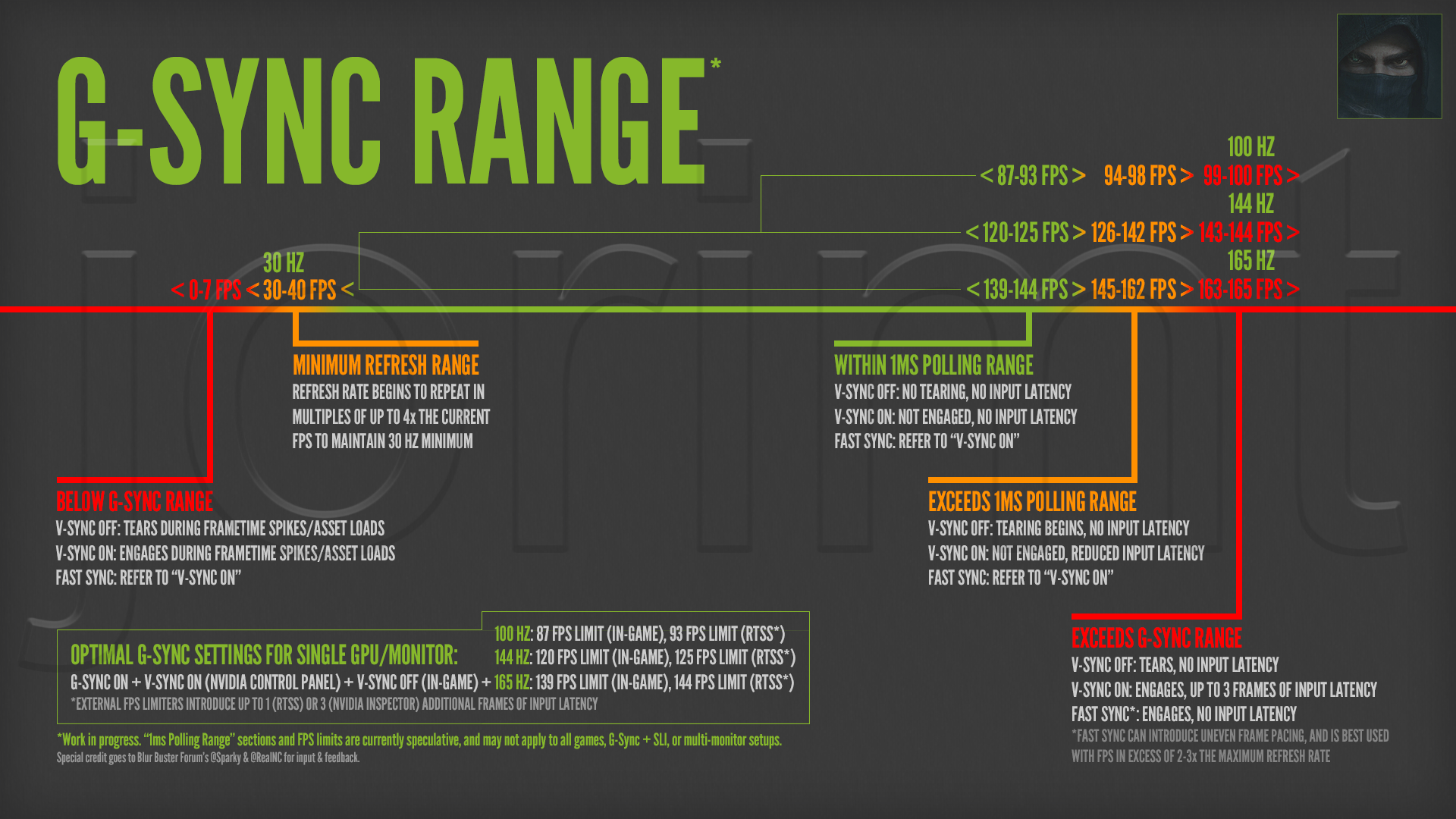

Indice dei contenuti 1) Cos'è 2) Come funziona 3) Come sfruttarlo 4) Come configurarlo 5) Pareri ed esperienza personale a) Riferimenti utili b) Liste di monitor G-SYNC sul mercato c) FAQ d) Installazione, aggiornamento e impostazione ottimale dei driver NVIDIA e) Differenze/analogie con AMD FreeSync f) Breve guida al V-SYNC e a tecniche "alternative" per eliminare/ridurre tearing/stuttering/input lag g) Breve guida alla calibrazione del monitor tramite Lagom test 1) Cos'è La tecnologia per monitor NVIDIA G-SYNC è una tecnica di "sincronizzazione adattiva" che elimina o quanto meno riduce notevolmente: a) L'input lag (ritardo di input). I monitor G-SYNC garantiscono un ritardo minimo tra comandi della tastiera e azioni su schermo. b) Tearing (strappo/tremolio dell'immagine). c) Stuttering (saltellamento/scattosità dell'immagine). Esempio di stuttering (percepibile, ovviamente, solo con un video). Esempio di tearing.  L'esperienza di gioco su PC diventa molto più fluida, veloce e reattiva. Infatti G-SYNC allinea dinamicamente la velocità di refresh del display al frame rate della GPU. Il refresh del monitor non rappresenta un limite e supporta velocità da 0 Hz fino al massimo consentito dal pannello del monitor. NVIDIA collabora con i produttori di pannelli per offrire sul mercato la più ampia gamma di pannelli ad alta velocità, da 60 Hz a 240 Hz. I monitor G-SYNC integrano un modulo hardware sviluppato ad hoc da NVIDIA che, oltre a gestire il G-SYNC in senso stretto, sostituisce nel funzionamento lo scaler della GPU (quando il monitor è collegato tramite DisplayPort, vedi più avanti). Tale chip, inoltre, gestisce un overdrive variabile che elimina l'effetto scia, prevedendo il frame successivo e regolando i parametri dell'overdrive stesso dello schermo del monitor.  Infine, G-SYNC HDR (High Dynamic Range) riproduce un'ampissima gamma di colori con una luminosità estremamente intensa per assicurare una grafica vivida. 2) Come funziona Sin dalla loro prima immissione sul mercato, i monitor hanno sempre avuto frequenze di aggiornamento (refresh rate) fisse - tipicamente di 60 Hz. Ma a causa della natura dinamica e variabile dei giochi per PC, le GPU renderizzano i frame a velocità variabile. Quando la GPU cerca di sincronizzarsi con il monitor, si verifica tearing persistente. L'attivazione del V-SYNC (Vertical-SYNC) permette di eliminare il tearing ma causa un aumento di latenza e stuttering. G-SYNC è in grado di eliminare questo compromesso, sincronizzando perfettamente il display con la GPU, a prescindere dal frame rate, restituendo un'esperienza videoludica di assoluto livello. Ma i quali sono i benefici del G-SYNC rispetto al V-SYNC? Col V-SYNC attivo, la GPU e il display sono sincronizzati così che la prima invia frame renderizzati al secondo ad una cadenza fissa (60 volte al secondo su monitor con refresh rate di 60 Hz). Sono due gli svantaggi associati all'uso del V-SYNC: 1) Stuttering, poiché la GPU potrebbe renderizzare frame a velocità inferiore di un frame ogni 1/60 secondi (o 60 FPS, frame per second). 2) Input lag, in quanto la risposta all'input è fissata e limitata a 1/60 secondi. I monitor con tecnologia G-SYNC risolvono questi svantaggi accettando e visualizzando a schermo i frame non appena questi sono renderizzati dalla GPU. Questo comporta un'esperienza di gioco più fluida e un input lag minimizzato. Il range di funzionamento del G-SYNC di qualsiasi monitor che supporta questa tecnologia è sempre compreso tra 30 Hz - massimo refresh rate del monitor (60, 75, 144, 165, 240 Hz, in base alle specifiche del monitor). Ma che succede quando la GPU si trova ad operare al di fuori di questo range? Sono due i casi possibili, ovviamente. a) La GPU è in grado di generare più FPS del massimo refresh rate del monitor. Si faccia riferimento al punto 4) del paragrafo 4 per una spiegazione esaustiva. b) La GPU genera meno di 30 FPS. In questo caso, il chip dedicato installato nel monitor provvede a far funzionare il display ad una frequenza di aggiornamento che può essere fino a 4 volte superiore agli FPS generati dalla GPU. Per esempio, se la GPU genera 25 FPS, il monitor si porterà a lavorare ad una frequenza di 50 Hz, re-visualizzando per 2 cicli lo stesso frame. Se la GPU genera 7 FPS, il monitor lavorerà a 28 Hz (x4). Per ovvi motivi, al di sotto di 7 FPS questo "escamotage" non funziona più. Chiaramente, questa modalità non è la panacea definitiva e non rende le immagini più fluide di quanto la GPU non sia in grado di fare, ma permette in ogni caso di evitare tearing e stuttering eccessivo. Va da sé che è consigliabile regolare meglio le impostazioni grafiche o aggiornare la propria GPU se quest'ultima non è in grado di lavorare a più di 30 FPS, in quanto il G-SYNC non è stato pensato per operare, di norma, in queste condizioni limite. 3) Come sfruttarlo Utilizzare il G-SYNC è molto semplice. L'hardware ed il software richiesti sono i seguenti: a) Una GPU NVIDIA GeForce GTX 650Ti BOOST (architettura Kepler) o superiore/più recente. b) Un monitor G-SYNC compatibile. c) Un cavo con supporto al protocollo DisplayPort (DP) 1.2. Generalmente è fornito col monitor; è sempre consigliabile utilizzare il cavo fornito dal produttore del monitor, o nel caso un cavo di buona qualità, specie per monitor con refresh rate elevato (>144 Hz). d) Windows 7, 8, 8.1 o 10. e) Driver R340.52 o più recenti. A questo punto è sufficiente collegare l'ingresso DP del monitor (generalmente nei monitor G-SYNC c'è un solo ingresso DP, quindi non ci si può sbagliare) con un'uscita DP della scheda video utilizzando il cavo a disposizione. Se nel sistema sono già installati driver NVIDIA, il G-SYNC dovrebbe risultare subito attivo. Per esserne certi, basta andare nel pannello di controllo dei driver NVIDIA e alla voce "Configura G-SYNC" verificare che vi sia una spunta su "Attiva G-SYNC per la modalità a schermo intero". Faccio notare che, sebbene con gli ultimi driver sia possibile sfruttare G-SYNC anche in modalità finestra, è in modalità schermo intero che la tecnologia restituisce le migliori performance.  Vale la pena verificare, inoltre, che la frequenza di aggiornamento (refresh rate) del monitor sia impostata correttamente al valore massimo supportato dal pannello. Per farlo, andare su "Cambia risoluzione" e verificare che risoluzione e refresh rate siano impostati correttamente in base alle specifiche del monitor.  Un'ulteriore conferma può consistere nel verificare l'OSD del monitor; generalmente i monitor G-SYNC indicano nel proprio menù OSD se la modalità G-SYNC è attiva o meno. 4) Come configurarlo La procedura riportata nel paragrafo 3 è sufficiente per utilizzare il G-SYNC senza problemi. Tuttavia, tramite il pannello di controllo dei driver NVIDIA, è possibile effettuare ulteriori configurazioni per adattare il funzionamento del G-SYNC alle proprie specifiche esigenze. Di seguito, i passaggi da effettuare sul pannello di controllo. 1) Nella prima voce "Configura impostazioni immagine con anteprima" selezionare "Usa le impostazioni avanzate dell'immagine 3D" è premere "Applica".  2) Su "Configura impostazioni 3D", "Impostazioni globali", verificare che "Tecnologia monitor" sia impostata su "G-SYNC".  3) Su "Configura impostazioni 3D", "Impostazioni globali", verificare che la "Frequenza di aggiornamento preferita" sia impostata su "La più alta disponibile" (vedi figura sopra). 4) A questo punto, ci si deve soffermare sulla voce "Configura impostazioni 3D", "Impostazioni globali", "Sincronizzazione verticale". Sebbene questa voce possa lasciare intendere una configurazione del V-SYNC che poco ha a che fare col G-SYNC, in realtà essa permette di gestire il comportamento del monitor nel caso in cui gli FPS generati dalla GPU siano superiori al refresh rate massimo del monitor, ovvero al limite superiore di operatività del G-SYNC (che, vale la pena ricordare, è sempre compreso nel range 30 Hz - massimo refresh rate del monitor). A titolo di esempio, considerando un monitor G-SYNC con refresh rate massimo di 144 Hz, le impostazioni qui discusse si applicano nel momento in cui la GPU è in grado di elaborare più di 144 FPS. Fatta questa dovuta premessa, le possibilità che si hanno sono le seguenti (ovviamente il G-Sync deve risultare attivo). Si faccia riferimento alla figura sopra. a) V-SYNC attivo. Vuol dire che la GPU non genererà mai più FPS di quelli corrispondenti al massimo refresh rate del monitor (es., mai più di 144 FPS per un monitor con refresh rate massimo di 144 Hz). Fintanto che gli FPS sono inferiori al massimo refresh rate del monitor, il G-SYNC lavora come previsto. Non si hanno tearing né stuttering, in nessun caso. Nel caso in cui la GPU fosse in grado di generare un numero di FPS superiore al massimo refresh rate del monitor, il G-SYNC viene disattivato e si attiva il classico V-SYNC. Questo può portare ad avere un aumento di input lag, nel senso che la GPU potrebbe potenzialmente generare un maggior numero di FPS che, di conseguenza, andrebbero a ridurre ulteriormente l'input lag. Non che a 144 FPS (o in generale agli FPS corrispondenti al massimo refresh rate del monitor) l'input lag sia alto, tutt'altro, ma alcuni giocatori potrebbero comunque desiderare il massimo beneficio possibile da questo punto di vista. La modalità appena descritta è utile per non far lavorare la GPU più del dovuto, facendole generare inutilmente frame che il monitor non sarebbe comunque in grado di visualizzare. In questo modo, ovviamente, si risparmia energia e le temperature della GPU sono più basse nel momento in cui GPU e monitor lavorano, rispettivamente, a 144 FPS/Hz. b) V-SYNC disattivato. La GPU lavora sempre al 100% (durante elaborazione 3D, ovviamente, non in generale), generando il massimo numero possibile di FPS in ogni scena. Fintanto che gli FPS generati sono inferiori del massimo refresh rate del monitor, il G-SYNC risulta attivo e lavora come previsto, eliminando tearing e stuttering. L'input lag è ridotto. Quando gli FPS sono superiori al massimo refresh rate del monitor, il G-SYNC si disattiva, non si ha stuttering ma si avrà tearing. L'input lag è ridotto al minimo possibile per ogni scena renderizzata. E' un'impostazione utile solo per chi vuole il minor input lag possibile, in ogni condizione, al prezzo di avere tearing, però. c) Veloce (FastSync attivo). La GPU lavora sempre al 100% (durante elaborazione 3D, ovviamente, non in generale), generando il massimo numero possibile di FPS in ogni scena. Fintanto che gli FPS generati sono inferiori del massimo refresh rate del monitor, il G-SYNC risulta attivo e lavora come previsto, eliminando tearing e stuttering. L'input lag è ridotto. Quando gli FPS sono superiori al massimo refresh rate del monitor, il G-SYNC si disattiva ed entra in gioco la modalità NVIDIA cosiddetta "FastSync". Quando quest'ultima è attiva, si continua a non avere stuttering né tearing, l'input lag è ridotto ma non come nel caso b). Ha senso se si gioca online e si vuole avere basso input lag, senza però perdere i vantaggi di zero tearing. Più o meno combina i vantaggi delle impostazioni a) e b). Potrebbe dare problemi con alcuni giochi, quindi è da provare caso per caso. Nota bene: in ogni caso, il V-SYNC va sempre disattivato nelle opzioni di qualsiasi gioco ed è sempre preferibile giocare in modalità schermo intero. L'immagine seguente riassume un po' tutte le considerazioni svolte sinora (nota: ulteriori approfondimenti a seguire).  Fatto questo, non vi resta altro da fare che far partire il vostro gioco preferito e godere dei vantaggi di questa tecnologia! Se avete programmi come la combo MSI Afterburner/RivaTuner attivi, potete verificare tramite le informazioni OSD se quanto riportato nel precedente punto 4) risulta rispettato o meno. Buon divertimento! 5) Pareri ed esperienza personale In questo paragrafo conclusivo, volevo cercare di descrivere "a parole" l'esperienza che ci si può aspettare da un monitor con G-SYNC attivo, visto che immagini/video non sono di certo sufficienti per comprenderne appieno il potenziale. Sono necessarie due premesse, in ogni caso. 1) La percezione di tearing/stuttering/input lag è del tutto soggettiva. Alcuni potrebbero notare questi "difetti" immediatamente, altri affatto, altri solo in determinate circostanze. L'esperienza che riporto di seguito è personale e, dunque, non generalizzabile per chiunque. 2) L'unico modo incontrovertibile per capire davvero come funziona il G-SYNC è provarlo di persona, con i propri occhi. Fatte queste dovute premesse, posso cercare di descrivere il salto di qualità che ho avuto passando da un "classico" monitor a refresh rate fisso a 60 Hz ad uno G-SYNC con refresh rate massimo di 165 Hz (Dell S2417DG). Nei giochi, la cosa che ho notato immediatamente è una sensazione di fluidità incredibile, unita alla totale assenza di scie. Questo, si badi bene, vale in generale, sia a FPS elevati che non (ovviamente sempre con un certo margine al di sopra di 30 FPS). Per fare un paragone rapido ed efficace, posso affermare senza problemi che 60 FPS con G-SYNC attivo "sembrano" decisamente più fluidi dei classici 60 FPS "cappati" col V-SYNC. Completamente un'altra storia. In gioco tutto diventa più chiaro e facilmente identificabile. Nei titoli più frenetici, si ha maggiore consapevolezza di quanto sta accadendo, rendendo l'esperienza molto più coinvolgente. Inoltre, anche variazioni di FPS considerevoli (per esempio, un passaggio repentino da più di 100 FPS a 60 o meno FPS) non sono affatto evidenti, e spesso è possibile accorgersene solo usando software che mostrano gli FPS in OSD. Anche rispetto al caso di V-SYNC disattivato o di "stratagemmi" come giocare in finestra senza bordi (che consente di non avere né tearing, né stuttering, né aumento di input lag anche senza refresh varaibile), il miglioramento nel mio caso è stato assolutamente evidente. Personalmente, utilizzare una delle due tecniche appena citate non mi ha mai dato una buona sensazione di fluidità, probabilmente perché i miei occhi non "digeriscono" bene il disallineamento tra FPS generati ed Hz visualizzati. Ho sempre ritenuto la soluzione migliore attivare il V-SYNC e giocare con FPS costanti pari al refresh rate del monitor. Ma come detto poco sopra, anche in questo caso il G-SYNC si è rivelato migliore, dal mio punto di vista. Concludo parlando dell'input lag. Personalmente, non sono mai stato molto sensibile a questa problematica, quindi non saprei dare un parere in merito. Probabilmente il fatto di non giocare online non mi ha mai fatto preoccupare troppo di tale "problematica". a) Riferimenti utili Panoramica sul G-SYNC FAQ NVIDIA Tecnologie associate al G-SYNC Video esplicativi (nota: per capire bene come funziona il G-SYNC si consiglia di visionare coi propri occhi la tecnologia in funzione, si veda il paragrafo 5 per alcune informazioni a riguardo) Monitor G-SYNC HDR Il famoso "test del pendolo", per vedere il G-SYNC all'opera (nota: restituisce un'idea precisa solo su monitor G-SYNC!) b) Liste di monitor G-SYNC sul mercato https://www.144hzmonitors.com/list-of-g-sync-monitors/ https://www.blurbusters.com/gsync/li...sync-monitors/ Annunciati monitor 4K 144 Hz HDR con G-SYNC: https://www.hwupgrade.it/news/perife...cio_75794.html c) FAQ D: Che aumento di prestazioni posso aspettarmi dalla tecnologia G-SYNC? R: Il G-SYNC assicura che ogni frame renderizzato dalla GPU sia visualizzato con perfetta sincronia dal monitor, fino al suo refresh rate massimo, ma non aumenta in alcun modo la velocità con cui la GPU è in grado di renderizzare ciascun frame. D: Come lavora il G-SYNC in caso di configurazioni SLI (multi GPU NVIDIA)? R: Il G-SYNC viene effettivamente gestito dalla GPU connessa al monitor compatibile. Le configurazioni SLI lavorano esattamente come configurazioni a GPU singola. D: Il G-SYNC funziona con tutti i giochi? R: Sì. Tuttavia, alcuni (per fortuna rari) giochi potrebbero manifestare problemi con G-SYNC attivo, pertanto in questi casi è consigliabile disattivare tale tecnologia. NVIDIA assicura che giochi problematici in tal senso verranno gestiti automaticamente dai driver grafici, portando alla disattivazione automatica del G-SYNC per tali giochi. D: Qual è l'impatto del G-SYNC sulla latenza di input? R: Diversamente dal V-SYNC, il G-SYNC ha un impatto notevolmente inferiore sulla latenza di input, e questo lo rende un'ottima scelta per sparatutto in prima persona e giochi online competitivi. Tuttavia, se si desidera avere il minor input lag possibile, si faccia riferimento al punto 4) del paragrafo 4. D: Quali sono i requisiti hardware/software per G-SYNC? R: Oltre ad un monitor compatibile, occorre un cavo DisplayPort 1.2 connesso direttamente alla GPU. G-SYNC funziona a partire da una NVIDIA GeForce GTX 650Ti BOOST o superiore/più recente. I sistemi operativi supportati sono Windows 7, 8, 8.1 e 10. Occorrono driver dalla versione R340.52 o più recenti. D: I monitor G-SYNC funzionano con le GPU della concorrenza (ovvero, AMD)? R: Sì, ma tutti i vantaggi associati alla tecnologia G-SYNC sono persi. Il monitor si comporterà come un "classico" monitor a frequenza di aggiornamento fissa (pari alla massima supportata dal pannello). D: Quali sono i requisiti minimi per notebook G-SYNC? R: Il notebook deve essere esplicitamente G-SYNC compatibile, ovvero deve adottare un pannello apposito e rispettare i requisiti che seguono. GPU compatibili: GeForce GTX 980, 980M, 970M or 965M (le configurazioni SLI di queste GPU sono supportate). Windows 7, 8, 8.1 and 10. Driver R352.06 o più recenti. d) Installazione, aggiornamento e impostazione ottimale dei driver NVIDIA Ritengo possa essere utile una breve guida su come installare, aggiornare e configurare al meglio i driver NVIDIA. Di seguito, alcune informazioni e consigli utili. a) Installazione 1) Scaricare i driver dal sito ufficiale NVIDIA, selezionando in modo opportuno GPU e sistema operativo in possesso. 2) Installare i driver. Personalmente, io installo solo driver GPU, PhysX ed audio (se sfruttate gli altoparlanti del monitor e il chip integrato sulla scheda video). Non installo i driver per il 3D virtuale né GeForce Experience, che non gradisco. b) Aggiornamento 1) Scaricare l'ultima versione di DDU, Display Driver Uninstaller, scompattando la relativa cartella compressa. 2) Disinstallare i driver Nvidia dall'elenco dei programmi installati. 3) Riavviare il PC in modalità provvisoria. 4) Eseguire DDU. 5) Selezionare "Clean and restart". 6) Seguire il precedente punto a).  c) Impostazione ottimale Si da per scontato che ogni impostazione sia a default, così come da installazione pulita dei driver. Di seguito si danno impostazioni "globali" che hanno un peso pressoché nullo sulle performance e che quindi possono essere attivate senza problemi di sorta. Per ulteriori informazioni (es. DSR, MFAA, ecc.), rimando a guide dedicate. 1) Aprire il pannello di controllo dei driver Nvidia. 2) Su "Regola le impostazioni dell'immagine con anteprima" selezionare "Usa le impostazioni dell'immagine 3D avanzate", cliccare su "Applica". 3) Su "Gestisci le impostazioni 3D", "Impostazioni globali", modificare le voci che seguono. 3.1) "Filtro anisotropico": "16X" 3.2) "Filtro struttura - Qualità": "Alta qualità" 3.3) "Modalità di gestione dell'alimentazione": "Adattivo". A differenza di "Potenza ottimale", "Adattivo" lesina meno sul risparmio energetico della GPU, evitando eventuali indesiderati cali di frequenza su GPU/VRAM con conseguenti cali indesiderati di FPS durante i giochi. "Prestazioni massime" è sconsigliato, quanto meno sulla pagina delle "Impostazioni globali", poiché può portare ad avere frequenze inutilmente elevate su GPU/VRAM anche in assenza di carichi grafici significativi. Consiglio di non modificare altri parametri, in quanto eventuali modifiche possono portare ad eventuali instabilità e/o performance scarse. e) Differenze/analogie con AMD FreeSync (basato sul thread ufficiale dell'utente Bivvoz) Premetto che la seguente sezione non vuole essere in alcun modo esaustiva, per qualsivoglia tipo di approfondimento rimando all'ottimo thread ufficiale creato dal buon Bivvoz. FreeSync è una tecnologia proprietaria AMD che, sostanzialmente, assolve agli stessi scopi del G-SYNC NVIDIA. Il FreeSync comunica con un hardware basato su uno standard open (Adaptive Sync) che sfrutta un segnale della connessione DisplayPort (successivamente introdotto anche su HDMI) chiamato "vblank" per variare la frequenza di aggiornamento del monitor e sincronizzarla al frame rate della GPU. Ovviamente, proprio come per G-SYNC, serve un monitor FreeSync compatibile e una GPU AMD recente. A differenza di G-SYNC, che funziona sempre nel range 30 Hz - refresh rate massimo del monitor, ogni monitor con supporto al FreeSync ha un range ben definito di frequenze di lavoro. Per esempio, alcuni monitor con supporto al FreeSync hanno un refresh rate massimo di 144 Hz, ma garantiscono il funzionamento del FreeSync solo in range come 48-90 Hz. E' dunque bene informarsi accuratamente, leggendo recensioni, schede tecniche o pareri di altri utenti, riguardo quale sia la frequenza effettivamente "coperta" dal FreeSync del monitor a cui si è interessati. Al di fuori del range supportato, ci sono due possibilità tra cui scegliere: tornare ad avere tearing o passare all'attivazione del V-SYNC. Attivando il V-SYNC in presenza di FreeSync, si pone un limite massimo sopra cui il frame rate non può salire, pari alla frequenza massima di FreeSync supportata dal monitor. In questo caso, il V-SYNC si attiverà anche se si scende sotto la frequenza minima supportata dal FreeSync, ma almeno a questo si può ovviare con LFC (Low Framerate Compensation). LFC è una funzione adottata successivamente da FreeSync che entra in funzione automaticamente in presenza di un monitor compatibile che abbia frequenza massima di supporto FreeSync pari a 2.5 volte quella minima di supporto. Un esempio tipico è 30-75 Hz. Questa funzionalità permette di restare sincronizzati anche in presenza di frame rate inferiori alla frequenza minima supportata dal FreeSync, semplicemente raddoppiando la frequenza e ripetendo due volte lo stesso frame. Per esempio, a 25 FPS il monitor lavorerà a 50 Hz ripetendo ogni frame due volte. Pertanto, il funzionamento è analogo a quanto proposto da NVIDIA con G-SYNC, ma a differenza di quest'ultimo non è sempre garantito e va verificato monitor per monitor. AMD sta attualmente lavorando ad una evoluzione di FreeSync: FreeSync 2. Quest'ultimo non sarà un vero e proprio successore di FreeSync e non andrà a sostituirlo, sarà più che altro una versione più avanzata che si affiancherà a FreeSync e avrà delle caratteristiche aggiuntive. La caratteristica principale riguarderà l'HDR, introducendo una tecnologia che riduce l'input lag tipica del tone mapping HDR. La seconda novità è che LFC dovrà essere sempre garantito. FreeSync 2 è più restrittivo di Freesync, pertanto richiede caratteristiche da monitor premium con conseguenti e probabili costi superiori. Ricapitolando, pro e contro di FreeSync rispetto a G-SYNC sono i seguenti. Pro - Si basa su uno standard aperto, dunque qualsiasi produttore può adottarlo senza costi di licenza. - Il punto di cui sopra si traduce in monitor immessi sul mercato senza ulteriore "sovrapprezzo" rispetto a versioni analoghe senza FreeSync. Questo porta ad avere monitor più convenienti delle controparti G-SYNC, a parità di altre caratteristiche (ma questo vale esattamente solo per monitor che hanno range di supporto frequenze completi, vedi anche sotto). Tipicamente, un monitor G-SYNC "equivalente" alla sua controparte FreeSync può costare 100/150 EUR in più. Contro - Essendo uno standard aperto, ogni produttore è libero di implementare il FreeSync come meglio crede. Questo porta ad avere sul mercato monitor con range radicalmente diversi e variabili l'un l'altro, quindi l'eventuale acquirente deve informarsi correttamente prima di procedere all'acquisto. - LFC non è sempre garantito (deve essere verificata la regola riportata sopra). FreeSync 2 rimuoverà questa eventuale mancanza. - FreeSync non supporta l'overdrive variabile. f) Breve guida al V-SYNC e a tecniche "alternative" per eliminare/ridurre tearing/stuttering/input lag In questa appendice, vorrei cercare di discutere delle varie tipologie di V-SYNC e di metodi alternativi per eliminare/ridurre tearing/stuttering/input lag. Due premesse: a) il taglio sarà volutamente "empirico", senza scendere in tecnicismi; b) l'analisi sarà riferita, in particolare, alle tecnologie NVIDIA, ma specifico fin da subito che anche per AMD ci sono tecniche analoghe (rimando a guide specifiche per chi fosse interessato). f1) V-SYNC con doppio buffering La metodologia più vecchia e semplice di V-SYNC, ormai soppiantata dal triplo buffering (anche se alcuni giochi, disgraziatamente, continuano ad implementarla). Quando attivo, nella pratica accade questo: finché la GPU è potenzialmente in grado di generare un numero di FPS superiore al refresh rate nominale del monitor (esempio tipico, 60 Hz), gli FPS mostrati a schermo coincidono numericamente con gli Hz del pannello (es. 60 Hz -> 60 FPS, 120 Hz -> 120 FPS, etc.). Ovviamente non c'è tearing, non c'è stuttering, viene aggiunta un po' di latenza di input. Ma che succede nel caso in cui la GPU non è in grado di generare un numero di FPS almeno pari al refresh rate nominale del pannello? Una cosa "terribile" per noi videogiocatori: gli FPS mostrati a schermo vengono dimezzati rispetto al refresh rate nominale. Facciamo un esempio. Monitor con refresh rate nominale di 60 Hz, V-SYNC con doppio buffering attivo, GPU che in una data scena non riesce a generare 60 FPS ma, supponiamo, "solo" 59 FPS. Accade questo: la GPU genera, effettivamente, solo 30 FPS, ovvero un valore numerico pari alla metà del refresh rate nominale del monitor. Questo avverrà fintanto che la GPU non sarà in grado di generare, potenzialmente, almeno 60 FPS in una data scena. Se questa condizione viene soddisfatta, gli FPS mostrati a schermo tornano ad essere effettivamente 60, sincronizzati con i 60 Hz del monitor. E che succede se, malauguratamente, la GPU in una data scena non riesce a produrre neanche 30 FPS? Semplice... Gli FPS si dimezzano di nuovo, passando a 15. La situazione tornerà alla "normalità" (60 FPS) solo nel momento in cui la GPU sarà effettivamente in grado di generare almeno 60 FPS. L'esempio appena esposto può essere generalizzato a monitor con refresh rate nominali differenti (es. 120 Hz -> 60 FPS, poi 30 FPS, ...; 100 Hz -> 50 FPS, poi 25 FPS, ...). Risulta chiaro che gli eventuali "saltelli" di FPS (il vero e proprio stuttering) rendono l'esperienza videoludica di pessimo livello. f2) V-SYNC con triplo buffering In caso di funzionamento nominale, il principio di funzionamento è identico al V-SYNC con doppio buffering. La differenza si ha proprio nel momento in cui la GPU non riesce a generare un numero di FPS almeno pari al refresh rate del monitor. In questo caso, gli FPS effettivamente visualizzati coincidono con quelli effettivamente producibili dalla GPU. Se quest'ultima genera 59 FPS, su schermo si vedranno 59 FPS. Tutto bene, quindi? Non esattamente. Infatti, nel momento in cui non vi è più il match tra FPS ed Hz del refresh rate, si avverte immediatamente un rallentamento dell'azione a schermo (si veda il primo video linkato in questo post per farsi un'idea). Tale rallentamento non è fastidioso come un vero e proprio saltellamento (stuttering), ma di certo non rende piacevole il gameplay se si protrae a lungo. Inoltre, rispetto al V-SYNC con doppio buffering, la modalità a triplo buffering aumenta ulteriormente l'input lag. Nota: l'impostazione "Triplo buffering" presente sul pannello di controllo dei driver Nvidia non vale per i giochi sviluppati in DirectX, quindi è inutile andarla a modificare. Valeva, in principio, solo per giochi sviluppati in OpenGL. Parlo al passato perché non so se, ad oggi, tale impostazione continua ad essere effettivamente valida. f3) Modalità finestra senza bordi Negli ultimi tempi, molti giochi consentono di scegliere, oltre alla modalità schermo intero e finestra, anche una modalità chiamata "finestra senza bordi". Posto che il V-SYNC funziona solo in modalità schermo intero, che succede utilizzando la finestra senza bordi (o la semplice finestra)? Semplicemente, la GPU lavorerà sempre al massimo in ogni scena, generando il massimo numero possibile di FPS, come se il V-SYNC fosse disattivato. Dunque si ha tearing? No, il tearing risulterà assente perché il gioco riprodotto in finestra sarà sincronizzato in frequenza con il refresh rate impostato sul pannello di controllo del sistema operativo. Abbiamo dunque trovato la panacea di tutti i mali? Purtroppo, la risposta è di nuovo negativa. Infatti ci sono diversi svantaggi associati a questa modalità: a) Non tutti i giochi la prevedono, dunque non è sempre utilizzabile. b) Spesso è meno stabile e può dare problemi rispetto allo schermo intero. Inoltre, rispetto a quest'ultima modalità, le performance sono un po' ridotte. c) Nel caso di refresh rate nominali "bassi" (es. 60 Hz) e di GPU relativamente potente, quest'ultima potrebbe ritrovarsi a generare inutilmente più frame di quelli effettivamente visualizzati a schermo, con un inutile dispendio energetico e conseguente aumento di temperature. La problematica si presenta in modo analogo nel caso di schermo intero senza V-SYNC. Risolvibile tramite limitatori di FPS (che alcuni giochi integrano direttamente). d) L'immagine resta comunque "tremolante" in quanto gli FPS non sono perfettamente sincronizzati al refresh rate del monitor, di conseguenza la sensazione di fluidità restituita non è comparabile. f4) Sincronizzazione verticale adattiva NVIDIA Da non confondere col protocollo Adaptive Sync, questa modalità opzionale di V-SYNC è prerogativa delle recenti GPU NVIDIA e può essere attivata globalmente (sconsigliato) o in modo specifico per ogni gioco/applicazione 3D. Si trova su "Configura impostazioni 3D", "Impostazioni globali", "Sincronizzazione verticale". In caso di monitor G-SYNC, non è selezionabile fintanto che il G-SYNC risulta attivo (in questo caso, la voce funziona in modo diverso; si faccia riferimento al punto 4) del paragrafo 4). Come si comporta questa modalità? L'algoritmo funziona in questo modo: fintanto che la GPU è potenzialmente in grado di generare più FPS del refresh rate del monitor, è attivo il classico V-SYNC, quindi non si ha stuttering né tearing. Quando la GPU non è in grado di generare un numero di FPS almeno pari al refresh rate del monitor, il V-SYNC si disattiva. Pertanto, anche in questo caso ci continua a non avere stuttering (né rallentamenti). Si può avere, però, occasionale tearing.* Secondo l'esperienza del sottoscritto, è una tecnica valida nel caso di giochi con V-SYNC interno "buggato" (nel senso che non fa funzionare a dovere il buffering triplo). Ha, tuttavia, i suoi intrinseci svantaggi, tra cui occasionale tearing anche quando c'è corrispondenza tra FPS e refresh rate del monitor. Nota bene: per garantire il corretto funzionamento di tale modalità, il V-SYNC va disattivato all'interno del gioco in esame. Inoltre, dal pannello di controllo si può anche impostare una modalità "dimezzata" che, appunto, dimezza la frequenza di sincronizzazione del pannello (es., per un pannello con refresh rate a 60 Hz, gli FPS generati sono al massimo 30). *Colgo subito l'occasione per sfatare il mito secondo cui sia ha tearing solo quando gli FPS sono superiori al refresh rate del monitor. Non è vero, per niente. Fonte: esperienza empirica. g) Breve guida alla calibrazione del monitor tramite Lagom test Sul sito http://www.lagom.nl/lcd-test/ è riportata una procedura per calibrare un monitor in modo non professionale, ovvero senza la necessità di sonda colorimetrica. Il cosiddetto Lagom test prevede diverse regolazioni, ma sono 4 in particolare le pagine su cui soffermarsi per la calibrazione: contrasto, livello del nero, saturazione bianco, calibrazione gamma. Gli altri non sono interessanti, nel senso che sono semplici verifiche, non ti permettono di calibrare il monitor. Per effettuare la calibrazione, si possono usare le impostazioni OSD del monitor oppure il pannello di controllo della scheda video - che in genere consente un controllo più granulare. Col mio monitor ho usato le impostazioni colore del pannello di controllo Nvidia, regolando ogni componente RGB (contrasto e gamma) separatamente. Si può anche regolare, in modo più approssimativo, l'intero canale RGB. Un altro metodo rapido - e spesso efficace - è usare la brillantezza digitale (ma senza esagerare, altrimenti i colori vengono snaturati). Tornando al Lagom test. In merito al contrasto, semplicemente verifica che i rettangoli di colore siano tutti perfettamente visualizzati, anche quelli più estremi a destra e sinistra (in fondo vedi immagini di esempio che ti fanno capire quali impostazioni dovrebbero essere corrette e quali no). In merito alla calibrazione gamma, test più importante in assoluto per avere colori "reali" e un'immagine non sbiadita o troppo scura, devi regolare la gamma delle componenti RGB fino a che, in ogni barra di colore, le colonne interne "sfumano" (si confondono, ovvero non sei più in grado di distinguerle) intorno al valore 2.2. Praticamente, devi fare così: regoli la gamma del rosso finché la prima barra rossa non sfuma a 2.2. Poi regoli il verde finché la seconda barra verde non sfuma a 2.2. Poi il blu. Le colonne più importanti sono le prime 4, perché rappresentano il 48% della luminanza totale. In genere le colonne rimanenti risultano ben sfumate se le prime 4 sono a posto. Se hai un monitor TN, considera che questa tecnologia tende inevitabilmente a mostrare una gamma più bassa nella parte superiore dello schermo (colori più sbiaditi) e una più alta nella parte inferiore (colori più scuri). In questo caso, per calibrare bene il monitor, devi guardarlo perpendicolarmente ad una certa distanza, e fare in modo che il centro delle colonne (2.2) sia a metà altezza dello schermo. Questa regolazione, se fatta come si deve, cambia la qualità dei colori del monitor dal giorno alla notte! Sul mio Dell TN la differenza è abissale, calibrato per bene sembra migliore dell'IPS che uso a lavoro. Per quanto riguarda, infine, livello del nero e saturazione del bianco, semplicemente regola il contrasto finché non vedi distintamente tutti i quadrati, specie quelli neri (gli ultimi bianchi potresti far fatica a visualizzarli, in ogni caso, ma non è così importante). Fatto questo torna alla calibrazione gamma e verifica che le colonne siano rimaste "confuse" a 2.2., altrimenti regola nuovamente la gamma RGB.  Il contenuto di questo post è rilasciato con licenza Creative Commons Attribution-Noncommercial-Share Alike 2.5. Il contenuto di questo post è rilasciato con licenza Creative Commons Attribution-Noncommercial-Share Alike 2.5.

__________________

Ryzen 9600X / ASUS TUF Gaming B850M-Plus / Corsair 2x16 GB DDR5 6000 MHz CL30 / RTX 5070 FE / Crucial P5 Plus 1 TB / Crucial MX500 1 TB / Seasonic Focus GX-750 / Dell S2417DG / Edifier R1280T / Synology DS220+ / Pixel 6 Ultima modifica di bagnino89 : 09-05-2018 alle 08:55. |

|

|

|

|

|

#2 |

|

Senior Member

Iscritto dal: Aug 2006

Messaggi: 14164

|

Post di servizio

__________________

Ryzen 9600X / ASUS TUF Gaming B850M-Plus / Corsair 2x16 GB DDR5 6000 MHz CL30 / RTX 5070 FE / Crucial P5 Plus 1 TB / Crucial MX500 1 TB / Seasonic Focus GX-750 / Dell S2417DG / Edifier R1280T / Synology DS220+ / Pixel 6 Ultima modifica di bagnino89 : 27-11-2017 alle 14:04. |

|

|

|

|

|

#3 |

|

Bannato

Iscritto dal: Nov 2013

Messaggi: 6463

|

Bellissimo articolo che spiega tutto, tranne però che tipo di monitor è adatto a sfruttare il G-sync, che caratteristiche deve avere?

Ad esempio come si comporterebbe se messo su una TV full HD moderna che in teoria dovrebbe funzionare bene anche come monitor? |

|

|

|

|

|

#4 | |

|

Senior Member

Iscritto dal: Jun 2003

Città: Prov. Milano

Messaggi: 45760

|

Quote:

Lato AMD invece ci sono i monitor freesync, più "universali" in quanto la tecnologia AMD va più a braccetto con lo standard di riferimento VESA, cioè l'adaptive-sync. Al momento non mi pare che le tv supportino nemmeno l'adaptive-sync. @bagnino89: bel lavoro! Ti lascio QUESTO link, magari dacci un'occhiata, a partire da quella immagine riassuntiva nel post 131

__________________

Lian-Li 011 EVO/ Evga 1000W GT/ 9700K+Galahad 360/ Asus Strix Z390-F/ Corsair 32GB 3200MHz/ RTX3080 FTW3 Ultra/ AOC AG352UCG6+Nano AmbientPX/ Aquaero 6/ P5Plus 1TB+970EvoPlus 1TB+MX500 2TB+vari/ Sound Blaster X3+Edifier S350DB+ATH-AG1X & Aurvana SE/ Corsair Strafe rgb+Dark Core Pro SE Ultima modifica di TigerTank : 27-11-2017 alle 12:54. |

|

|

|

|

|

|

#5 | |

|

Bannato

Iscritto dal: Nov 2013

Messaggi: 6463

|

Quote:

esistono an TV usabili come monitor che siano affidabili come un monitor? |

|

|

|

|

|

|

#6 | |

|

Bannato

Iscritto dal: Nov 2013

Messaggi: 6463

|

Quote:

Anni fa esistevano gli appositi e buoni Monitor/TV mentre ora sembrano essere spariti. |

|

|

|

|

|

|

#7 | |||

|

Senior Member

Iscritto dal: Aug 2006

Messaggi: 14164

|

Quote:

La risposta alla tua domanda è spiegata chiaramente da TigerTank nel post di seguito. Mi permetto di dire che G-SYNC è una tecnologia proprietaria Nvidia, che non è possibile integrare "a posteriori" su monitor/TV. In realtà, agli albori del G-SYNC, c'erano alcuni monitor che consentivano l'installazione di un chip compatibile, ma la cosa è nata e morta lì. Ad oggi, G-SYNC esiste solo su monitor certificati da NVIDIA. Nulla vieterebbe a quest'ultima di stringere accordi con produttori di TV per implementare la tecnologia anche su questi, ma non credo si abbia l'interesse di farlo, da ambo le parti (sia NVIDIA che i produttori). Per quanto riguarda le TV, vedo più probabile l'adozione di un "generico" Adaptive Sync, che si possa implementare anche su HDMI (solitamente le TV non hanno ingressi DisplayPort). Tra l'altro, la nuova Xbox sembra supportare l'Adaptive Sync, quindi credo che tra non molto si inizierà a muovere qualcosa sulle TV in tal senso. Quote:

Quote:

Comunque, in generale sono contento che ci sia interesse sull'argomento.

__________________

Ryzen 9600X / ASUS TUF Gaming B850M-Plus / Corsair 2x16 GB DDR5 6000 MHz CL30 / RTX 5070 FE / Crucial P5 Plus 1 TB / Crucial MX500 1 TB / Seasonic Focus GX-750 / Dell S2417DG / Edifier R1280T / Synology DS220+ / Pixel 6 |

|||

|

|

|

|

|

#8 |

|

Senior Member

Iscritto dal: Sep 2012

Messaggi: 23859

|

Ottimo lavoro caro

__________________

Lian-Li PC-O11 Dynamic Seasonic Prime TX-850 AMD Ryzen 5900X ARCTIC Liquid Freezer II 360 MSI X570S UNIFY-X MAX Crucial Ballistix 3600 MHz (2x16GB) EVGA GeForce RTX 2080 SUPER XC ULTRA Samsung 980 Pro 500GB Sabrent Rocket 4.0 1TB LG 27GP850 |

|

|

|

|

|

#9 |

|

Senior Member

Iscritto dal: Sep 2012

Messaggi: 23859

|

Io sono sempre più tentato di acquistare questo monitor: Acer Predator XB271HU , qualcuno per caso lo ha e mi sa dire come si comporta con il G-SYNC e tutto ad esso collegato?

__________________

Lian-Li PC-O11 Dynamic Seasonic Prime TX-850 AMD Ryzen 5900X ARCTIC Liquid Freezer II 360 MSI X570S UNIFY-X MAX Crucial Ballistix 3600 MHz (2x16GB) EVGA GeForce RTX 2080 SUPER XC ULTRA Samsung 980 Pro 500GB Sabrent Rocket 4.0 1TB LG 27GP850 |

|

|

|

|

|

#10 |

|

Senior Member

Iscritto dal: May 2007

Città: Milano

Messaggi: 7103

|

ottimamente

__________________

Apple Watch Ultra + iPhone 15 Pro Max + Rog Ally + Legion Go |

|

|

|

|

|

#11 |

|

Senior Member

Iscritto dal: Jun 2010

Città: Trento

Messaggi: 2261

|

ho da quasi 2 anni un monitor aoc g2460pg 1080p 144hz con g-sync usato con una gtx 970 e non tornerei mai indietro

__________________

ALIMENTATORE Seasonic FOCUS PX-750 Platinum - MOBO Asus Prime Z690-P WIFI D4 - GPU Msi 3080 Suprim X - CPU Intel 12600k - DISSI Deepcool Castle 240EX A-RGB - CASE Corsair 4000D Airflow - RAM 2x16gb ddr4 Crucial Ballistix 3600mhz c16 - SSD WD SN850 + Samsung 860 qvo 2tb - MONITOR Asus ROG SWIFT PG279Q - TASTIERA msi Vigor GK50 - MOUSE Logitech G402 |

|

|

|

|

|

#12 | |

|

Senior Member

Iscritto dal: Jun 2003

Città: Prov. Milano

Messaggi: 45760

|

Idem con il mio in firma....credo che cambierei solo con un futuro 4K gsync over 60Hz, salvo scimmie irresistibili per un 21:9 1440p.

Quote:

Come 16:9 c'era l'AOC Agon AG271QG che veniva meno di 700€. Asus e Acer viaggiano più alti.

__________________

Lian-Li 011 EVO/ Evga 1000W GT/ 9700K+Galahad 360/ Asus Strix Z390-F/ Corsair 32GB 3200MHz/ RTX3080 FTW3 Ultra/ AOC AG352UCG6+Nano AmbientPX/ Aquaero 6/ P5Plus 1TB+970EvoPlus 1TB+MX500 2TB+vari/ Sound Blaster X3+Edifier S350DB+ATH-AG1X & Aurvana SE/ Corsair Strafe rgb+Dark Core Pro SE Ultima modifica di TigerTank : 27-11-2017 alle 20:19. |

|

|

|

|

|

|

#13 |

|

Senior Member

Iscritto dal: Jun 2003

Città: Prov. Milano

Messaggi: 45760

|

Sì, appunto era ottimo quando stava su amazon a parecchio meno di 700...ora sta solo da terzi ben oltre tale cifra.

__________________

Lian-Li 011 EVO/ Evga 1000W GT/ 9700K+Galahad 360/ Asus Strix Z390-F/ Corsair 32GB 3200MHz/ RTX3080 FTW3 Ultra/ AOC AG352UCG6+Nano AmbientPX/ Aquaero 6/ P5Plus 1TB+970EvoPlus 1TB+MX500 2TB+vari/ Sound Blaster X3+Edifier S350DB+ATH-AG1X & Aurvana SE/ Corsair Strafe rgb+Dark Core Pro SE |

|

|

|

|

|

#14 |

|

Senior Member

Iscritto dal: Jan 2002

Città: Asti

Messaggi: 944

|

ottima tecnologia, con il Dell S2417DG mi trovo decisamente bene

diciamo scheda video a parte.. ma ci sto lavorando

__________________

AMD Ryzen 7 9800x3d | Asus Prime X870 | PC FOCUS GX-850 | 32Gb Ram DDR5 6400Mhz | Nvidia RTX 4080 | Dell S2417DG | Xbox Live: Tanz79 |

|

|

|

|

|

#15 | |

|

Senior Member

Iscritto dal: Sep 2012

Messaggi: 23859

|

Quote:

L'unica cosa è il pannello TN. Rispetto ad un IPS la qualità dell'immagine (imho, correggetemi se sbaglio) è nettamente inferiore. Per il resto penso siamo li li

__________________

Lian-Li PC-O11 Dynamic Seasonic Prime TX-850 AMD Ryzen 5900X ARCTIC Liquid Freezer II 360 MSI X570S UNIFY-X MAX Crucial Ballistix 3600 MHz (2x16GB) EVGA GeForce RTX 2080 SUPER XC ULTRA Samsung 980 Pro 500GB Sabrent Rocket 4.0 1TB LG 27GP850 |

|

|

|

|

|

|

#16 |

|

Senior Member

Iscritto dal: May 2007

Città: Milano

Messaggi: 7103

|

Ha i colori più freddi ... non e inferiore!

E cmq se giochi solo tn e meglio perché ha una latenza inferiore Sent from my iPhone using Tapatalk

__________________

Apple Watch Ultra + iPhone 15 Pro Max + Rog Ally + Legion Go |

|

|

|

|

|

#17 | |

|

Senior Member

Iscritto dal: Jun 2010

Città: Trento

Messaggi: 2261

|

Quote:

Inviato dal mio SM-G930F utilizzando Tapatalk

__________________

ALIMENTATORE Seasonic FOCUS PX-750 Platinum - MOBO Asus Prime Z690-P WIFI D4 - GPU Msi 3080 Suprim X - CPU Intel 12600k - DISSI Deepcool Castle 240EX A-RGB - CASE Corsair 4000D Airflow - RAM 2x16gb ddr4 Crucial Ballistix 3600mhz c16 - SSD WD SN850 + Samsung 860 qvo 2tb - MONITOR Asus ROG SWIFT PG279Q - TASTIERA msi Vigor GK50 - MOUSE Logitech G402 |

|

|

|

|

|

|

#18 | ||

|

Senior Member

Iscritto dal: Aug 2006

Messaggi: 14164

|

Quote:

Quote:

Purtroppo ogni tipologia di LCD (TN, IPS, VA) ha pregi e difetti. Gli IPS hanno di certo colori più accurati e ottimi angoli di visione, ma sono una lotteria col glow. I TN sono più "una garanzia" da questo punto di vista, oltre a costare decisamente meno (specie quelli con G-SYNC).

__________________

Ryzen 9600X / ASUS TUF Gaming B850M-Plus / Corsair 2x16 GB DDR5 6000 MHz CL30 / RTX 5070 FE / Crucial P5 Plus 1 TB / Crucial MX500 1 TB / Seasonic Focus GX-750 / Dell S2417DG / Edifier R1280T / Synology DS220+ / Pixel 6 |

||

|

|

|

|

|

#19 | |

|

Senior Member

Iscritto dal: May 2007

Città: Milano

Messaggi: 7103

|

Quote:

Non cadiamo nel baratro della generalizzazione please

__________________

Apple Watch Ultra + iPhone 15 Pro Max + Rog Ally + Legion Go |

|

|

|

|

|

|

#20 |

|

Senior Member

Iscritto dal: Aug 2006

Messaggi: 14164

|

Ragazzi non entriamo nel merito di chi è meglio (o meno peggio, per come la vedo io) tra TN, IPS e VA, altrimenti non ne usciamo vivi. Tra l'altro non è questo lo scopo principale del thread.

Piuttosto, ritenete ci sia altro da aggiungere/correggere/modificare? Nei prossimi giorni conto di approfondire il discorso HDR.

__________________

Ryzen 9600X / ASUS TUF Gaming B850M-Plus / Corsair 2x16 GB DDR5 6000 MHz CL30 / RTX 5070 FE / Crucial P5 Plus 1 TB / Crucial MX500 1 TB / Seasonic Focus GX-750 / Dell S2417DG / Edifier R1280T / Synology DS220+ / Pixel 6 |

|

|

|

|

| Tutti gli articoli | Tutte le news | Tutti i download |

| Strumenti | |

|

|

Tutti gli orari sono GMT +1. Ora sono le: 04:19.