AMD dubbiosa sull'ingresso di NVIDIA nel mercato x86

Il CEO di AMD, Dirk Meyer, crede che NVIDIA non avrŕ molte possibilitŕ di riuscire ad entrare nel mercato di processori x86

di Andrea Bai pubblicata il 12 Marzo 2009, alle 12:26 nel canale ProcessoriNVIDIAAMD

Il sito web BusinessWeek ha pubblicato un'intervista a Dirk Meyer, CEO di AMD, il quale ha espresso il proprio parere su alcuni dei temi piů caldi che in questo momento toccano da vicino l'azienda di SunnyVale.

Una delle parti piů interessanti dell'intervista, nella quale vengono fatti cenni al mutamento del metodo di lavoro a seguito della cessione delle fabbriche produttive e viene ribadita la perplessitŕ che AMD ha nei confronti dei sistemi netbook, č la risposta in cui Meyer esprime il proprio parere in merito al possibile ingresso di NVIDIA nel mercato di processori x86.

Meyer ha dichiarato: "Sono un po' dubbioso sulle capacitŕ di NVIDIA di poter realizzare un chip x86 partendo da zero. Solamente le barriere di proprietŕ intellettuale sono enormi. Non č qualcosa che si puň azionare come un interruttore della luce. E, tra le altre cose, dovrŕ pagare Intel per questo". NVIDIA, infatti, non dispone di una licenza d'uso del set di istruzioni x86 e nel caso dovesse decidere di entrare in questo segmento di mercato si troverŕ costretta a contrattare con il colosso dei processori oppure acquisire una societŕ che attualmente abbia i diritti di sviluppo, produzione e commercializzazione dei processori x86, tenendo ben presente, tuttavia, che queste licenze potrebbero comprendere alcune clausole di non trasferibilitŕ a terzi. In altri termini se NVIDIA decidesse di acquisire una societŕ che detiene licenze x86, potrebbe non avere comunque la possibilitŕ di utilizzarle e, in tal caso, dovrŕ comunque andare incontro ad una fase di trattativa (o di confronto legale) con Intel e/o con altri eventuali detentori di diritti sulla proprietŕ intellettuale.

Meyer sottolinea inoltre come l'interesse di NVIDIA nel segmento delle soluzioni SoC (come l'attuale Tegra o, nel caso dovesse concretizzarsi, il System-on-Chip x86) sia una cartina al tornasole di quanto, nell'attuale scenario, sia necessaria l'implementazione di CPU e GPU in un singolo pezzo di silicio. Ed č proprio sulla base di questa considerazione che nel corso del 2006 AMD ed ATI hanno deciso di procedere con le operazioni di fusione che hanno portato ad un'unica realtŕ.

"Non sono sorpreso dall'interesse di NVIDIA nel mercato x86. Conferma l'idea che abbiamo avuto quando abbiamo acquisito ATI Technologies qualche anno fa. Credo sia abbastanza ironico che Jen-Hsun Huang (CEO di NVIDIA), che č un ottimo amico, sottolineasse il fatto che NVIDIA fosse rimasta l'unica compagnia indipendente a realizzare GPU come se fosse una cosa positiva. Dal mio punto di vista non lo č."

Sony FE 16-25mm F2.8 G: meno zoom, più luce

Sony FE 16-25mm F2.8 G: meno zoom, più luce  Motorola edge 50 Pro: design e display al top, meno il prezzo! Recensione

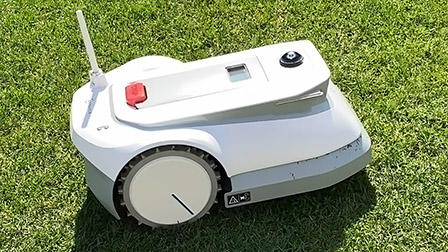

Motorola edge 50 Pro: design e display al top, meno il prezzo! Recensione Ecovacs Goat G1-800, mettiamo alla prova il robot tagliaerba facile ed efficace

Ecovacs Goat G1-800, mettiamo alla prova il robot tagliaerba facile ed efficace Boston Dynamics presenta l'evoluzione dell'androide Atlas: ora è completamente elettrico

Boston Dynamics presenta l'evoluzione dell'androide Atlas: ora è completamente elettrico Scaricati gli ultimi dati dal drone NASA Ingenuity, potrebbe essere un ''arrivederci''

Scaricati gli ultimi dati dal drone NASA Ingenuity, potrebbe essere un ''arrivederci'' Take-Two: dopo l'acquisizione di Gearbox arrivano altri 550 licenziamenti

Take-Two: dopo l'acquisizione di Gearbox arrivano altri 550 licenziamenti NASA Dragonfly: la missione con il drone verso Titano è confermata, partenza nel 2028

NASA Dragonfly: la missione con il drone verso Titano è confermata, partenza nel 2028 TV Sony: ora al top di gamma ci sono i Mini LED e spariscono i QD-OLED!

TV Sony: ora al top di gamma ci sono i Mini LED e spariscono i QD-OLED! NVIDIA dice definitivamente addio a Turing con le nuove schede RTX A400 e A1000

NVIDIA dice definitivamente addio a Turing con le nuove schede RTX A400 e A1000 Ghost of Tsushima: ecco i requisiti PC del primo gioco con l'overlay di PlayStation Network

Ghost of Tsushima: ecco i requisiti PC del primo gioco con l'overlay di PlayStation Network La prima edizione di Coderful porta il mondo dello sviluppo frontend a Catania il 28 giugno

La prima edizione di Coderful porta il mondo dello sviluppo frontend a Catania il 28 giugno Netflix, è polemica per il presunto uso di immagini generate dall'IA in un documentario

Netflix, è polemica per il presunto uso di immagini generate dall'IA in un documentario Call of Duty Vanguard: un flop per Activision…che ha venduto 30 milioni di copie

Call of Duty Vanguard: un flop per Activision…che ha venduto 30 milioni di copie Le ricariche con corrente modulata potrebbero aiutare le batterie agli ioni di litio a durare più a lungo

Le ricariche con corrente modulata potrebbero aiutare le batterie agli ioni di litio a durare più a lungo Ci sarebbe la Cina dietro gli "attacchi mercenari" segnalati da Apple: l'analisi di BlackBerry

Ci sarebbe la Cina dietro gli "attacchi mercenari" segnalati da Apple: l'analisi di BlackBerry Microsoft Copilot for Security è ora disponibile per tutte le aziende

Microsoft Copilot for Security è ora disponibile per tutte le aziende Il Tribunale si schiera dalla parte di Audi nella disputa legale con Nio a proposito dei nomi di ES6, ES7 e ES8

Il Tribunale si schiera dalla parte di Audi nella disputa legale con Nio a proposito dei nomi di ES6, ES7 e ES8

16 Commenti

Gli autori dei commenti, e non la redazione, sono responsabili dei contenuti da loro inseriti - infoPersonalmente, faccio il tifo per il RISC! ^^

È difficile credere che al tempo dei 939 AMD sia stata a godersi il successo (che poi intel vendev tanto... le sapete ste cose). Intel ora dovrà imparare a migliorare il suo "quad nativo con MC-Hub integrato" nel senso aumentare l'IPC, il througput, e diminuirre le latenze. Forse AMD ha un vantaggio in questo e magari fra 3 o 4 anni sarà di nuovo sopra intel lato CPU.

Si dice ma non credo vero al 100%, che intel mira solo ad aumentare i core. Anche se fra 5 anni moti software saranno tutti multithreading(a parte gli algoritmi che non sono paralellizzabili eccc... la conosciamo tutti questa storia inutile ripeterla), non credo che per i deskptop sarà vantaggiorso avere 16 core, IMHO 4 bastano anche x gli smanettoni. Ora le CPU mobile,desktop, server sono prese dallo stesso progetto, in futuro questo cambierà. Per i server e workstation 16,32,64 core vanno bene, quindi si dovrà dividere la linea server/workstation(x workstation intendo cose tipo dipartimento di fisica non videoediting del fotografo vicino casa che fa i filmini dei matrimoni[con tutto il rispetto è un professionista e uno dei migliori nel suo campo, e usa un dual xeon a 6 core ovvero 12 core]).

Finita la corsa ai MHz, è iniziata quella ai core, ma in ambito desktop ci vuole altro ora, e il GPGPU ha lo stesso difetto: non velocizza ciò che è scalare(non parallelizzabile). Gli ssd fino a un certo punto, un'applicazione che non usa l'hd dopo che l'hai aperta in un nanosecondo sta tutta in ram e non si avvantaggia + dell'SSD. Ci vuole una nuova invenzione.... ma panso che per CPU e I/O fotoniche (credo si chiamano ottici), cose con nanotubi in carbonio e computer quantistici ci saranno i miei nipotini bimbiminkia che ciattano con MSN 80000.

Voi che ne pensate cosa potrà aumentare la potenza delle CPU come quando si passava dai 333MHz ai 1000MHz in 18 mesi(non ricordo ma quello si che era progresso e ci sbalordiva, ricordo ai tempi del dos quando vidi il primo Petnium che arrivò nella mia città allora non c'era nemmeno win95, ma dos6 e win3.1(ambiente operativo allora e non os) e 16MB di RAM col dos erano inutili a meno di un'applicazione scritta ad hoc, per dire gli sprechi o specchi x le allodole ci sono sempre stati)

PS OT chi si ricorda il geoso (qualcosa di simile non ricordo bene) un ambiante operativo x commodore64 con mouse e tutto in bianco e nero io l'ho visto tra 89 e il 91, poteva benissimo essere i giro da molto prima all'epoca il riciclo tecnlogico consumer non era come oggi nel 90 c'era già l'amiga500

Io credo che il futuro passi per multi-core specializzati, non general purpose come quelli attuali (che peraltro non credo spariranno). E l'integrazione della gpu, così come l'idea di Fusion, sono secondo me uno dei passi necessari.

Diciamo pure che il Cell stesso, in qualche modo, con i suoi diversi tipi di core, ne è la testimonianza.

Posso immaginare una cpu Amd/Intel 8core con un paio (o quattro) general purpose, uno dedicato alla virgola mobile, uno o due stile gpu, uno alla fisica ecc. Ovviamente il tutto è fattibile se e solo se i produttori di software si impegnano a sfruttare le nuove potenzialità. E visto quanto ci stanno mettendo per i 64bit o per i multicore beh, non sono molto ottimista...

credo che il salto prestazionale lo vedremo con l'abbandono definitivo della piattaforma 32 bit con tutte le sue problematiche di compatibilità all'indietro etc.

poi bisogna ricordarsi che con il web 2 non avrà molta importanza l'hardware dei clients, l'aspetto decisivo sarà il consumo e le dimensioni ( system on a chip )

AMD è stata lungimirante, può competere con Intel.

e ricordatevi che nell'ambito workstation e thin client la Matrox è ancora molto competitiva.

Nvidia tranne per i pc per bambinoni e le workstation rischia il ridimensionamento.

che lascia intendere come sia necessaria una licenza solo per la compatibilita' al set di istruzioni x86, mi lascia perplesso. Un set di istruzioni rientra nell'ambito dei brevetti industriali, e non nel diritto d'autore. La durata massima per cui sono rinnovabili tali brevetti e' 20 anni, per cui un eventuale proprieta' intellettuale sul solo set sarebbe gia' scaduta da tempo.

La mia sensazione e' che con "licenza x86" si intenda la possibilita' di avere accesso ad un pacchetto di brevetti circuitali piu' recenti, in modo da evitare di sobbarcarsi il design di un progetto cosi' complesso partendo da zero. Da questo punto di vista, la licenza non e' strettamente necessaria per la compatibilita' x86, e' solo una facilitazione.

Devi effettuare il login per poter commentare

Se non sei ancora registrato, puoi farlo attraverso questo form.

Se sei già registrato e loggato nel sito, puoi inserire il tuo commento.

Si tenga presente quanto letto nel regolamento, nel rispetto del "quieto vivere".